Webスクレイピングで取得したデータをどのように保存するかは、開発の初期段階で意外と重要な設計判断になります。

特に「SQLiteにするべきか、それともCSVで十分か」という問題は、多くの人が一度は迷うポイントです。

一見するとCSVはシンプルで扱いやすく、Excelなどでも開けるため便利に思えます。

しかしデータ量が増えたり、後から検索・集計・更新といった操作が必要になった瞬間、その単純さが制約に変わることがあります。

一方でSQLiteは軽量なデータベースでありながら、SQLによる柔軟なクエリが可能で、構造化データの扱いに強みがあります。

本記事では、以下の観点から両者を比較していきます。

- データの扱いやすさ

- 拡張性と保守性

- パフォーマンスと運用コスト

スクレイピングデータは「集めて終わり」ではなく、「後からどう使うか」が本質です。

そのため保存形式の選択は単なる技術的好みではなく、データ活用の方向性そのものに直結します。

SQLiteとCSV、それぞれの特性を正しく理解することで、無駄な再設計を避け、より安定したデータパイプラインを構築できるようになります。

- スクレイピングデータ保存はSQLiteとCSVどっちが最適か?基本概念から整理

- CSVファイルでスクレイピングデータを保存するメリットと限界

- SQLiteの特徴とデータベースとしての強み|検索・更新・構造化管理

- スクレイピングデータ保存設計:CSV運用とSQLite運用のパターン比較

- データ量で選ぶ保存形式|小規模・中規模・大規模スクレイピングの最適解

- Pythonで実践するSQLiteスクレイピングデータ保存とCSV連携の基本

- CSVとSQLiteのパフォーマンス比較|検索速度・運用コストの違い

- よくある失敗例:CSV運用の限界とSQLiteへ移行すべきタイミング

- SQLiteとCSVの最適な使い分けまとめ|スクレイピングデータ保存の結論

スクレイピングデータ保存はSQLiteとCSVどっちが最適か?基本概念から整理

スクレイピングで取得したデータをどのように保存するかは、単なる実装の選択ではなく、その後のデータ活用のしやすさを左右する重要な設計判断になります。

特に代表的な選択肢として挙がるのがCSVとSQLiteですが、この2つは「同じ保存形式」に見えて、内部の思想や適用領域は大きく異なります。

まずCSVは、カンマ区切りのテキストファイルとしてデータをそのまま保存する非常にシンプルな形式です。

特別なライブラリがなくても扱え、Excelやスプレッドシートでも簡単に開けるため、初学者や小規模なデータ収集には向いています。

一方で、構造的な制約が少ない反面、データの整合性や検索性能には限界があります。

SQLiteは軽量なリレーショナルデータベースでありながら、SQLによる高度なクエリ操作が可能です。

ファイル単体で動作するためサーバー構築が不要であり、ローカル環境でも本格的なデータベース機能を利用できます。

スクレイピングデータのように「後から分析することが前提」のケースでは特に強みを発揮します。

両者の違いを整理すると、以下のようになります。

| 観点 | CSV | SQLite |

|---|---|---|

| 構造 | なし(フラット) | テーブル構造 |

| 検索性 | 低い | 高い |

| 拡張性 | 低い | 高い |

| 導入コスト | 非常に低い | 低い |

この比較から分かる通り、CSVは「とりあえず保存する」用途に適しており、SQLiteは「保存後に活用する」用途に向いています。

つまり、どちらが優れているかではなく、目的によって最適解が変わるというのが本質です。

例えば、以下のようなケースではCSVが合理的です。

- 単発のデータ収集

- データ量が数千行以下

- Excelでの手動分析が前提

逆にSQLiteが適しているのは次のようなケースです。

- 定期的なスクレイピングでデータが蓄積される

- 条件検索やフィルタリングを頻繁に行う

- Pythonなどで自動処理パイプラインを構築する

特にスクレイピングでは、初期はCSVで十分でも、データ量が増えるにつれて検索速度や管理の煩雑さが問題になります。

その段階でSQLiteへ移行する設計も現実的な選択肢です。

また、概念的な違いとして重要なのは「データの扱い方」です。

CSVはファイルベースのストレージであり、基本的には逐次読み書きしかできません。

一方SQLiteはインデックスを持ち、必要なデータだけを高速に抽出できます。

この差は、データ量が増えたときに顕著に現れます。

最終的に重要なのは、「今の規模」ではなく「将来の利用方法」を想定して選択することです。

スクレイピングデータは単なるログではなく、分析や機械学習の前段階データになることも多いため、保存形式の選択は後工程の効率を大きく左右します。

CSVファイルでスクレイピングデータを保存するメリットと限界

CSVファイルはスクレイピングデータの保存先として最もシンプルで、実装コストが極めて低いという特徴があります。

プログラミングの観点から見ても、追加のミドルウェアやデータベースサーバーを必要とせず、標準ライブラリだけで読み書きが完結する点は大きな利点です。

特に小規模なデータ収集やプロトタイピング段階では、この軽量性が強力に作用します。

まずメリットを整理すると、CSVは構造が単純であるためデータの可搬性が高く、どの環境でもほぼ確実に開けます。

Pythonであればcsvモジュールを使うだけで処理でき、追加依存が不要です。

また、人間が直接ファイルを開いて確認できるため、デバッグのしやすさという観点でも優れています。

具体的な利点は次の通りです。

- 導入コストがゼロに近い

- Excelなどで即座に閲覧可能

- 形式が単純で学習コストが低い

- スクリプトからの書き込みが容易

一方で、CSVは構造化データを扱うには限界があります。

最大の問題は「データベースとしての機能を持たない」点です。

検索、フィルタリング、更新といった操作は基本的に自前実装となり、データ量が増えるほど処理効率が悪化します。

例えば、スクレイピング結果から特定条件のデータだけを抽出する場合でも、毎回ファイル全体を読み込む必要があります。

この仕様は小規模データでは問題になりませんが、数万行を超えると顕著にパフォーマンスが低下します。

以下はCSV運用における代表的な制約です。

| 観点 | 問題点 |

|---|---|

| 検索性能 | 全件走査が基本 |

| データ整合性 | 型制約がない |

| 同時アクセス | 基本的に弱い |

| 拡張性 | 構造変更が困難 |

また、スクレイピングではデータの重複や欠損が発生しやすいですが、CSVには制約がないため、これらを防ぐ仕組みを自前で実装する必要があります。

例えばユニーク制約のようなものは存在しないため、重複チェックも逐次処理になります。

簡単な例として、CSVにデータを書き込む処理は以下のようになります。

import csv

data = ["title", "price", "url"]

with open("data.csv", "a", newline="", encoding="utf-8") as f:

writer = csv.writer(f)

writer.writerow(data)

このように実装自体は非常にシンプルですが、データ量が増えると「追記は簡単だが検索が重い」という構造的な問題が顕在化します。

さらに重要なのは、CSVは「状態を持たないファイル」であるという点です。

つまり、データ間の関係性を表現できず、複雑な分析や集計処理には向いていません。

後からJOIN的な処理を行おうとすると、すべて手続き的に処理する必要があり、コードの複雑性が急激に増します。

このためCSVは、次のような用途に限定すると合理的です。

- 一時的なデータ保存

- 小規模スクレイピング結果の確認

- 他ツールへの受け渡し用フォーマット

逆に言えば、「データを育てていく」という用途には不向きです。

スクレイピングのように継続的にデータが増え、後から分析や再利用を行う前提では、CSV単体では限界が早期に訪れます。

結論としてCSVは、軽量で扱いやすいがスケーラビリティに欠ける保存形式です。

初期段階では非常に有効ですが、データ活用を視野に入れる場合は、どこかのタイミングでSQLiteなどへの移行を検討する必要があります。

SQLiteの特徴とデータベースとしての強み|検索・更新・構造化管理

SQLiteは軽量ながら本格的なリレーショナルデータベース機能を備えており、スクレイピングデータのように継続的に蓄積・分析されるデータとの相性が非常に良い選択肢です。

特に重要なのは「単なる保存形式」ではなく、「データ操作のためのエンジン」であるという点です。

この違いが、CSVとの決定的な差になります。

SQLiteはファイルベースで動作するため、サーバーを立てる必要がなく、導入コストが低いにもかかわらず、SQLによる高度な操作が可能です。

これにより、データの検索・更新・集計を効率的に行うことができます。

スクレイピングデータは後から分析用途に回されることが多いため、この柔軟性は大きな利点になります。

まずSQLiteの強みを整理すると以下のようになります。

- SQLによる高速な検索と条件抽出

- インデックスによるパフォーマンス最適化

- データ整合性(型制約や制約条件)の保持

- 複数テーブルによる構造化管理

これらはCSVでは基本的に実現できない機能です。

特にインデックスの存在は重要で、データ量が増えた際の検索速度に大きな差を生みます。

例えばスクレイピングで取得した商品データを扱う場合、SQLiteでは以下のようなクエリで即座に条件抽出が可能です。

SELECT title, price

FROM products

WHERE price < 1000;

このような操作が高速に実行できる理由は、SQLite内部でB-tree構造のインデックスが利用されているためです。

CSVではこのような最適化が存在しないため、毎回全件スキャンが必要になります。

さらにSQLiteは「更新処理」に強いという特徴もあります。

CSVでは特定行の更新はファイル全体の再書き込みが必要になりますが、SQLiteでは行単位での更新が可能です。

UPDATE products

SET price = 800

WHERE id = 10;

この違いは運用フェーズに入ると非常に大きな差となります。

スクレイピングではデータの修正や補完が発生することも多く、そのたびにCSVを再生成するのは現実的ではありません。

またSQLiteはスキーマによる構造管理が可能です。

これにより、データの型や制約を明確に定義できます。

| 項目 | CSV | SQLite |

|---|---|---|

| 型制約 | なし | あり |

| NULL制御 | 弱い | 強い |

| 関係性管理 | 不可 | 可能 |

この構造化の恩恵は、データの信頼性を担保する点で非常に重要です。

スクレイピングデータは外部サイト依存であるため、欠損や形式揺れが発生しやすく、SQLiteの制約機能はデータ品質の維持に役立ちます。

さらにSQLiteはトランザクション処理をサポートしており、複数の操作を一括で安全に実行できます。

これにより途中で処理が失敗してもデータ破損を防ぐことができます。

スクレイピング用途においては、以下のような特徴が特に重要です。

- データ量増加に耐えられるスケーラビリティ

- 分析・集計を前提とした設計

- Pythonなどのバックエンドとの親和性

特にPythonとの相性は良く、標準ライブラリのsqlite3で簡単に統合できます。

これによりスクレイピングから保存、分析までを一貫して実装可能です。

総合的に見るとSQLiteは「保存するための形式」ではなく、「データを扱うための軽量データベース」として設計されており、スクレイピングのような継続的データ処理において非常に合理的な選択肢となります。

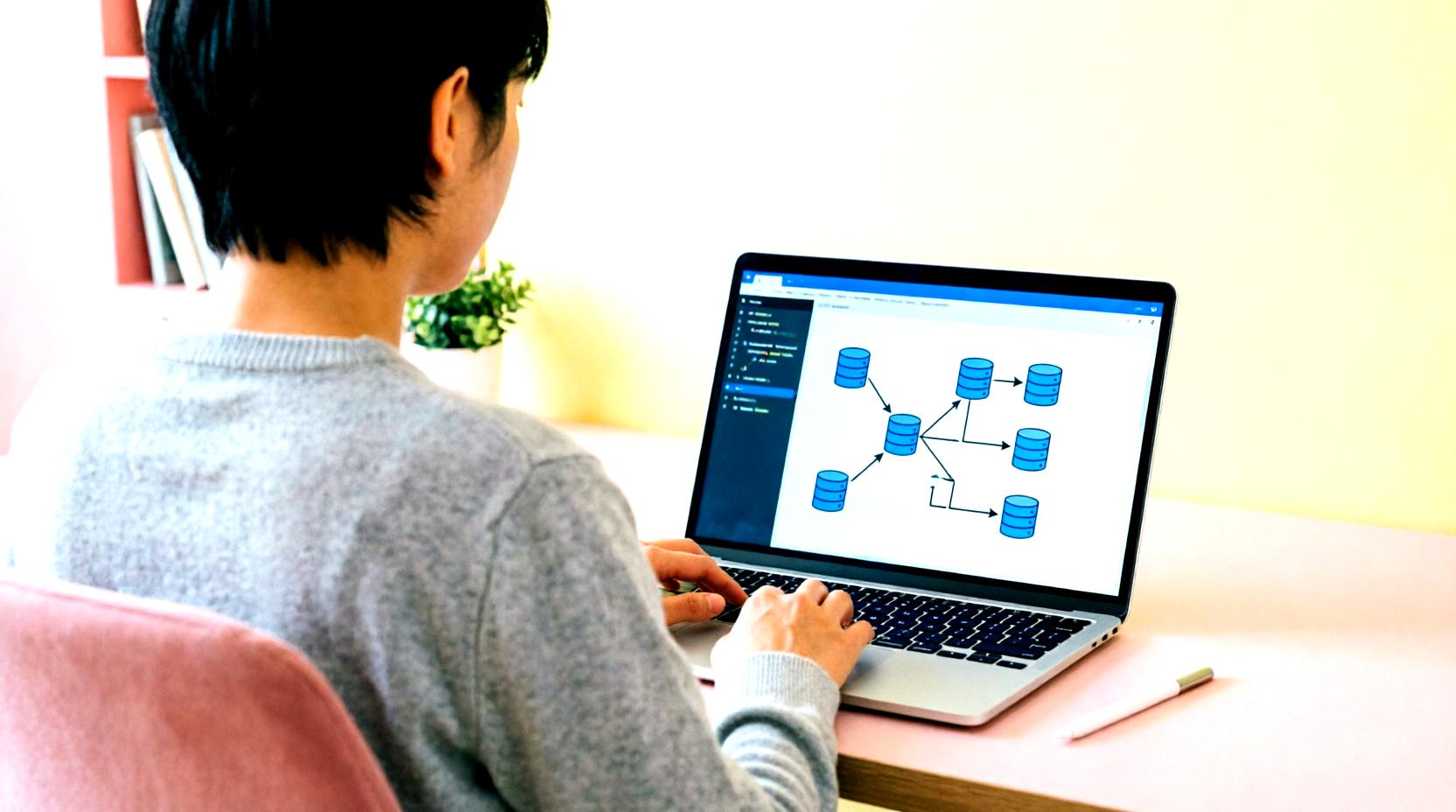

スクレイピングデータ保存設計:CSV運用とSQLite運用のパターン比較

スクレイピングデータの保存設計を考える際、CSVとSQLiteのどちらを採用するかは単なる技術選定ではなく、データパイプライン全体の設計思想に直結します。

特に重要なのは「データをどう扱うか」ではなく「データをどう育てるか」という視点です。

この観点から見ると、両者は明確に異なる運用パターンを持っています。

まずCSV運用は「フラットファイル中心の単純構成」です。

スクレイピング結果を逐次追記し、必要に応じて別プロセスで分析するという流れになります。

このモデルは実装が簡単で、初期段階では非常に有効です。

しかし、処理が増えるにつれてスクリプトが肥大化しやすく、データ整合性の担保も困難になります。

一方SQLite運用は「データベース中心の構造化パイプライン」です。

取得したデータをそのままテーブルに格納し、検索・更新・集計をSQLで直接行う設計になります。

これによりデータ処理の責務が明確に分離され、保守性が大幅に向上します。

両者の違いを整理すると以下のようになります。

| 観点 | CSV運用 | SQLite運用 |

|---|---|---|

| 構造 | ファイル単体 | テーブル構造 |

| 処理方式 | スクリプト依存 | SQL中心 |

| データ整合性 | 弱い | 強い |

| 拡張性 | 低い | 高い |

| 保守性 | 低い | 高い |

CSV運用の典型的なパターンは「収集と分析が分離している構成」です。

スクレイピングスクリプトがCSVを書き出し、その後別のスクリプトやExcelで分析を行います。

この構成はシンプルですが、データ量が増えるとファイル管理が複雑化し、バージョン管理の問題も発生します。

SQLite運用では「収集・保存・分析が一体化」されます。

例えばスクレイピング後すぐにSQLでフィルタリングし、必要なデータだけを抽出することが可能です。

この即時性はデータパイプラインの効率を大きく改善します。

実務的な観点から見ると、以下のような設計パターンが一般的です。

- CSV単独運用:小規模・短期・検証用途

- CSV+変換処理:中規模・バッチ処理型

- SQLite中心運用:中〜大規模・継続収集型

特に「CSV+SQLite併用パターン」は現実的な選択肢として有力です。

初期収集はCSVで行い、一定量を超えた段階でSQLiteへインポートする設計です。

この方法は柔軟性と拡張性のバランスが良く、実務でもよく採用されます。

SQLite中心の設計では、以下のようなメリットが顕著になります。

- データの一元管理が可能

- 重複排除や制約をDB側で処理できる

- 分析クエリがそのまま再利用可能

- スクリプトの責務が単純化される

例えばスクレイピング後に重複排除を行う場合、SQLiteでは次のような設計が可能です。

CREATE UNIQUE INDEX idx_url ON products(url);

これによりデータの一意性をDBレベルで保証できます。

CSVではこのような制約は存在しないため、アプリケーション側で冗長なチェック処理が必要になります。

また運用面でも違いは明確です。

CSVはファイル単位で管理されるため、データが増えるとバックアップや分割管理が必要になります。

一方SQLiteは単一ファイルで完結しながらも内部で最適化されるため、運用負荷が低いという利点があります。

最終的に重要なのは「どのフェーズのデータか」という視点です。

- 試作・検証フェーズ:CSVが合理的

- 成長・運用フェーズ:SQLiteが合理的

- 分析・機械学習フェーズ:SQLiteが有利

スクレイピングデータは時間とともに価値が増す性質を持つため、初期設計でSQLiteを採用するか、段階的に移行するかはプロジェクトの性質に依存します。

しかし設計思想としては、SQLiteを中心に据えた方が長期的な拡張性は高くなる傾向があります。

データ量で選ぶ保存形式|小規模・中規模・大規模スクレイピングの最適解

スクレイピングデータの保存形式を選定する際、最も実務的な判断軸の一つが「データ量」です。

CSVとSQLiteのどちらが優れているかという議論は抽象的になりがちですが、実際にはデータ規模によって最適解は明確に分かれます。

コンピューターサイエンス的に言えば、これはアルゴリズム選択と同様に「入力サイズ依存の設計問題」として扱うべきです。

まず小規模スクレイピングでは、CSVが圧倒的に合理的です。

数百〜数千行程度であれば、ファイル読み書きのオーバーヘッドも無視でき、Excelやスプレッドシートとの親和性も高いまま維持できます。

この段階では複雑なデータベース設計を行うよりも、迅速な検証と反復が重要になります。

一方で中規模データ(数万行程度)になると状況が変わります。

CSVでは検索や集計に時間がかかり始め、ファイル分割や前処理スクリプトが必要になるケースが増えます。

この段階でSQLiteを導入するかどうかが、システムの拡張性を大きく左右します。

大規模データ(数十万〜数百万行)では、SQLiteの優位性が明確になります。

インデックスによる高速検索やトランザクション制御により、データ操作の安定性と速度が両立されます。

CSVではこの規模になると実用的な検索はほぼ不可能に近くなります。

以下にデータ量別の最適解を整理します。

| データ規模 | 推奨形式 | 理由 |

|---|---|---|

| 小規模(〜5,000行) | CSV | シンプルで即時利用可能 |

| 中規模(5,000〜100,000行) | CSV+SQLite併用 | 段階的移行が現実的 |

| 大規模(100,000行〜) | SQLite | 検索性能と整合性が重要 |

このように、保存形式の選択は静的ではなく、データ成長に応じて動的に変化するべき設計要素です。

小規模フェーズでは、CSVの「軽さ」が最大の武器になります。

スクレイピングの検証段階では、データ構造が頻繁に変わるため、柔軟に編集できるCSVは非常に扱いやすい存在です。

しかしこの利便性はスケールとともに制約へと変化します。

中規模フェーズでは、データの「再利用性」が重要になります。

この段階でSQLiteを導入すると、検索クエリによるフィルタリングや部分更新が可能になり、データ処理の効率が飛躍的に向上します。

特にPythonとの組み合わせでは、分析処理と保存処理を同一プロセスで扱える点が大きなメリットです。

大規模フェーズでは、もはやCSVは現実的な選択肢ではありません。

ファイルサイズの増大によりI/O負荷が増加し、単純な読み込みでもボトルネックが発生します。

SQLiteはインデックス構造によりこの問題を回避し、一定の性能を維持できます。

また重要なのは「将来のデータ成長をどう見積もるか」です。

初期段階では小規模でも、スクレイピングは継続的にデータを蓄積するため、数ヶ月後には中規模を超えるケースが多くあります。

このため、設計時点で以下のような判断が求められます。

- 短期プロジェクト:CSV固定

- 中期プロジェクト:CSV+SQLite移行設計

- 長期プロジェクト:SQLite前提設計

さらに実務では、データ量だけでなくアクセスパターンも重要です。

例えば「書き込み主体」なのか「読み取り主体」なのかによっても最適解は変わります。

SQLiteは読み取り最適化に強く、CSVは書き込みの単純性に強いという特性があります。

最終的に言えるのは、保存形式の選択は単なる技術比較ではなく、データのライフサイクル設計そのものだという点です。

スクレイピングのように成長前提のデータでは、初期の選択が後工程の負債になる可能性があるため、データ量を基準にした段階的設計が最も合理的です。

Pythonで実践するSQLiteスクレイピングデータ保存とCSV連携の基本

スクレイピングの実装において、Pythonは非常に相性の良い言語です。

標準ライブラリだけでCSVとSQLiteの両方を扱うことができるため、外部依存を最小限に抑えながらデータパイプラインを構築できます。

ここでは実務的な観点から、CSVとSQLiteを組み合わせたデータ保存の基本構成について整理します。

まずCSVは、スクレイピング結果の「一次保存先」として利用されることが多いです。

理由は単純で、書き込みが軽量かつ実装が容易だからです。

特に試作段階では、データ構造が頻繁に変わるため、柔軟性の高いCSVは非常に扱いやすい選択肢になります。

一方SQLiteは「二次保存・分析用ストレージ」として利用されるケースが一般的です。

CSVに蓄積したデータをSQLiteにインポートすることで、検索や集計処理を高速化し、分析フェーズに移行できます。

この役割分担が重要です。

典型的な構成は以下のようになります。

- スクレイピング → CSVへ追記

- 定期バッチ → CSVをSQLiteへ取り込み

- 分析処理 → SQLiteからSQLで抽出

このように段階を分けることで、処理の責務が明確になります。

まずCSVへの書き込みは非常にシンプルです。

以下は基本的な実装例です。

import csv

data = ["title", "price", "url"]

with open("scraping.csv", "a", newline="", encoding="utf-8") as f:

writer = csv.writer(f)

writer.writerow(data)

この段階では、データは単なるフラットファイルとして保存されます。

重要なのは「後でSQLiteに移行する前提で構造を統一しておくこと」です。

次にSQLiteへの取り込みです。

Python標準ライブラリのsqlite3を使用することで、簡単にデータベース操作が可能です。

import sqlite3

import csv

conn = sqlite3.connect("data.db")

cur = conn.cursor()

cur.execute("""

CREATE TABLE IF NOT EXISTS products (

title TEXT,

price INTEGER,

url TEXT

)

""")

with open("scraping.csv", encoding="utf-8") as f:

reader = csv.reader(f)

for row in reader:

cur.execute("INSERT INTO products VALUES (?, ?, ?)", row)

conn.commit()

conn.close()

この構成により、CSVの柔軟性とSQLiteの構造化能力を組み合わせることができます。

実務上、このハイブリッド構成にはいくつかの明確な利点があります。

まず、スクレイピング処理が軽量化されます。

データ取得時点では単純にCSVへ追記するだけなので、処理負荷が低く安定します。

次に、分析フェーズではSQLiteに集約することで、SQLによる高速なクエリが可能になります。

またこの構成は「失敗に強い」という特徴も持ちます。

スクレイピングは外部サイト依存のため途中でエラーが発生しやすいですが、CSVに逐次保存しておくことでデータ損失を防ぐことができます。

その後SQLiteへの取り込みは再実行可能なバッチ処理として設計できます。

さらに発展させると、以下のような設計も可能です。

- CSVはログ用途として保持

- SQLiteは分析・検索専用

- 必要に応じてデータを再生成可能な構造

このように「冪等性」を意識した設計にすることで、データパイプラインの信頼性が大幅に向上します。

重要なのは、CSVとSQLiteを対立構造で捉えないことです。

実際には競合関係ではなく、それぞれ異なる役割を持つ補完関係にあります。

CSVは入力バッファ、SQLiteは永続ストレージ兼分析基盤という位置づけが最も合理的です。

結果として、Pythonを用いたスクレイピング設計では「CSVで集めてSQLiteで活用する」という二段構えが、最もバランスの良い実装パターンになります。

CSVとSQLiteのパフォーマンス比較|検索速度・運用コストの違い

スクレイピングデータの保存方式を評価する際、単なる機能比較だけでなく「パフォーマンス」と「運用コスト」という観点は極めて重要です。

特にCSVとSQLiteは一見すると単純な保存形式の違いに見えますが、内部的なデータ処理モデルが異なるため、性能特性には明確な差が存在します。

まず検索速度の観点から見ると、SQLiteは圧倒的に有利です。

理由はインデックス構造とクエリエンジンを持っているためであり、必要なデータだけを効率的に抽出できます。

一方CSVは構造を持たないため、検索時には基本的に全件走査が必要になります。

この違いはデータ量が増えるほど顕著になります。

例えば10万行のデータから特定条件を抽出する場合、SQLiteではインデックスが適用されればO(log n)に近い効率で検索可能ですが、CSVではO(n)の線形探索となり、処理時間に大きな差が生じます。

次に運用コストの観点を整理すると、CSVとSQLiteは性質が逆転する部分もあります。

CSVは初期コストがほぼゼロであり、導入や学習も非常に簡単です。

しかしデータ量が増えると、手動スクリプトや前処理の管理コストが増大します。

SQLiteは初期設計こそ必要ですが、運用フェーズでは大幅にコストを削減できます。

特に以下のような点で差が出ます。

- データ整合性チェックをDB側で担保できる

- 重複排除や更新処理が容易

- 分析クエリの再利用が可能

- ファイル分割管理が不要

これらはCSVではすべてアプリケーション側で実装する必要があります。

パフォーマンスとコストの違いを整理すると次のようになります。

| 観点 | CSV | SQLite |

|---|---|---|

| 検索速度 | 遅い(全件走査) | 高速(インデックス利用) |

| 書き込み速度 | 非常に高速 | 高速(制約あり) |

| スケーラビリティ | 低い | 高い |

| 運用コスト | 増加しやすい | 安定しやすい |

特に興味深いのは「書き込み性能」ではCSVが優れている点です。

単純な追記であればファイルIOのみで済むため、非常に軽量です。

しかしこれは検索や更新のコストを犠牲にしているトレードオフでもあります。

SQLiteはトランザクション処理やインデックス更新が発生するため、単純な追記速度ではCSVに劣る場合があります。

しかしこのコストは、後続の検索・更新処理の高速化によって十分に回収されます。

運用面では、データ量の増加に伴ってコスト差がより明確になります。

CSVではファイル分割やバージョン管理が必要になり、データ整合性の確認も手作業に依存するケースが増えます。

一方SQLiteは単一ファイルで完結しながらも、内部的に最適化されているため管理負荷が低いという特徴があります。

また、実務的には「検索頻度」が重要な判断軸になります。

データを一度書き込んで終わりであればCSVでも問題ありませんが、頻繁に検索・抽出・分析を行う場合はSQLiteが圧倒的に効率的です。

例えば以下のようなユースケースではSQLiteが明確に有利です。

- ダッシュボード用データの生成

- 定期レポート作成

- 条件付きフィルタリング

- 重複チェック付きデータ蓄積

一方でCSVが適しているのは以下のようなケースです。

- 一時的なログ保存

- 軽量なデータ受け渡し

- 外部ツールとの互換性重視

結論として、CSVとSQLiteの違いは単なる性能差ではなく、「どの処理にコストを払うか」という設計思想の違いです。

CSVは書き込み最適化型、SQLiteは読み取り最適化型と捉えると理解が明確になります。

したがってスクレイピングのようにデータが成長し、かつ再利用される前提のシステムでは、SQLiteの方が長期的なパフォーマンスと運用効率の両面で優位に立つケースが多いです。

よくある失敗例:CSV運用の限界とSQLiteへ移行すべきタイミング

スクレイピングにおいてCSVは手軽な保存手段として広く使われますが、運用が長期化すると設計上の限界が顕在化しやすい形式でもあります。

特に「最初はCSVで十分だったのに、気づいたら破綻していた」というケースは非常に多く、これはデータ量の増加と処理要件の複雑化が原因です。

まず典型的な失敗として挙げられるのは、CSVを「データベースの代替」として使い続けてしまうケースです。

初期段階では問題がなくても、条件検索や重複チェック、更新処理が増えるにつれてスクリプトが複雑化し、結果として保守不能なコードになります。

次に多いのが、ファイル分割の乱用です。

データ量が増えた際にCSVを日付やカテゴリごとに分割する設計は一見合理的ですが、後から横断検索が必要になった瞬間に破綻します。

複数ファイルを読み込んで統合処理を行う必要が生じ、パフォーマンスと実装コストの両方が悪化します。

さらに、データ整合性の問題も頻出です。

CSVには型制約やユニーク制約が存在しないため、重複データや不正な値が混入しても防ぐ仕組みがありません。

その結果、分析フェーズでデータクレンジングに多大な工数が発生します。

よくある失敗パターンを整理すると以下のようになります。

- CSVを長期間の主データストアとして使用する

- データ増加後に検索性能の低下が顕著になる

- ファイル分割によりデータ統合が困難になる

- 重複・欠損の制御がアプリケーション依存になる

これらの問題はすべて、CSVが「構造を持たないストレージ」であることに起因しています。

一方でSQLiteへの移行は、こうした問題を根本的に解決する手段になります。

SQLiteはテーブル構造を持ち、インデックスや制約を利用できるため、データの整合性と検索性能を同時に担保できます。

では、どのタイミングでSQLiteへ移行すべきかという判断基準が重要になります。

実務的には以下のような兆候が現れた段階が移行の目安です。

- CSVの行数が数万を超え、検索処理が遅くなった

- 複数CSVを横断して処理する必要が出てきた

- データの更新や修正が頻繁に発生している

- 分析用スクリプトが複雑化し始めた

これらの兆候は、CSVが単なる「保存形式」から「運用ボトルネック」に変わったサインといえます。

SQLiteへの移行は単純なデータ移動ではなく、設計の再構築を意味します。

例えばCSVでは暗黙的に扱っていたデータ型を明示化し、テーブル設計として定義する必要があります。

このプロセスにより、データの意味構造が明確になります。

また移行時には以下のような設計改善が可能になります。

| 項目 | CSV運用 | SQLite移行後 |

|---|---|---|

| データ整合性 | 手動管理 | 制約で自動保証 |

| 検索処理 | 全件走査 | インデックス検索 |

| 更新処理 | ファイル再生成 | 行単位更新 |

| 分析処理 | スクリプト依存 | SQLクエリ化 |

特に重要なのは「分析処理のSQL化」です。

これにより、データ処理ロジックとデータ保存構造が分離され、保守性が大幅に向上します。

また、移行後の運用ではCSVを完全に廃止する必要はありません。

むしろログ用途やバックアップ用途として併用するケースも多く、SQLiteを中心とした構造にCSVを補助的に組み合わせる設計が現実的です。

結論として、CSV運用は短期的には非常に効率的ですが、データ量や処理要件の増加に対してスケールしにくいという本質的な制約を持っています。

そのため、一定の規模や複雑性を超えた段階ではSQLiteへの移行が合理的な選択になります。

これは単なる技術移行ではなく、データ設計の成熟プロセスそのものと捉えるべきです。

SQLiteとCSVの最適な使い分けまとめ|スクレイピングデータ保存の結論

スクレイピングデータの保存先としてCSVとSQLiteのどちらを選ぶべきかという問いは、一見すると単純な二択のように見えますが、実際には「データのライフサイクル設計」に関わる本質的な問題です。

ここまでの議論を踏まえると、両者は優劣で比較するものではなく、役割分担によって最適化されるべき技術要素だと整理できます。

まずCSVは「軽量な一次データストレージ」として非常に優秀です。

スクレイピング直後の生データを素早く保存する用途では、実装の簡潔さと依存の少なさが大きなメリットになります。

特に開発初期や検証フェーズでは、データ構造が頻繁に変化するため、柔軟性の高いCSVは合理的な選択です。

一方でSQLiteは「構造化された二次データベース」として機能します。

データが蓄積され、検索・分析・更新といった操作が発生する段階では、SQLによる操作性とインデックスによる高速処理が重要になります。

この段階ではCSVの単純さはむしろ制約となり、SQLiteの構造化能力が価値を持ちます。

両者の役割を整理すると以下のようになります。

- CSV:収集・一時保存・検証用データ

- SQLite:分析・検索・永続管理用データ

- ハイブリッド:CSVで収集しSQLiteで活用

この役割分担を理解することが、スクレイピング設計の第一歩になります。

さらに重要なのは「データの成長を前提とした設計」です。

スクレイピングは一度きりの処理ではなく、継続的にデータが蓄積されるプロセスです。

そのため初期段階の軽量性だけでなく、将来的な拡張性を考慮する必要があります。

比較の観点を再整理すると次のようになります。

| 観点 | CSV | SQLite |

|---|---|---|

| 初期コスト | 非常に低い | 低い |

| 拡張性 | 低い | 高い |

| 検索性能 | 低い | 高い |

| 保守性 | 低い | 高い |

この表からも分かる通り、短期的にはCSVが有利ですが、中長期的にはSQLiteが圧倒的に有利です。

実務的には、以下のような判断基準が有効です。

- 小規模・単発スクレイピング:CSV単独運用

- 中規模・継続収集:CSV+SQLite併用

- 大規模・分析前提:SQLite中心設計

特に「CSVからSQLiteへの移行可能性を設計に含める」ことが重要です。

初期段階でCSVを採用しても、後からSQLiteに移行できるようにデータ構造を統一しておけば、システム全体の柔軟性が大きく向上します。

またSQLiteを中心に据える場合でも、CSVを完全に排除する必要はありません。

むしろログ用途や外部連携用途として併用することで、システムの冗長性と可搬性を確保できます。

最終的な結論としては、SQLiteとCSVの選択は二者択一ではなく「階層構造としての設計問題」です。

CSVは入口、SQLiteは中核という役割を持たせることで、スクレイピングデータの保存・活用フローは最も合理的な形になります。

したがって、最適解は単一の形式ではなく、データのフェーズに応じて適切に使い分ける設計にあります。

これにより、開発初期のスピードと運用後の安定性を両立することが可能になります。

コメント