AI開発といえばPythonが事実上の標準になっている現状には、単なる流行以上の明確な理由があります。

機械学習やディープラーニングの分野では、アルゴリズムの設計だけでなく、データ処理・実験・可視化・プロトタイピングまでを高速に回す必要があり、その要求に対してPythonの設計思想が極めて相性が良いからです。

特に重要なのは、開発スピードとエコシステムの成熟度です。

Python自体は実行速度よりも開発効率を重視した言語ですが、その弱点を補う形でC/C++実装の高速な数値計算ライブラリが周辺に集約されています。

代表的な要素を整理すると以下の通りです。

- NumPyやSciPyによる高速な数値計算基盤

- PyTorchやTensorFlowなどの機械学習フレームワークの充実

- pandasによるデータ処理の容易さ

- Jupyter Notebookによる実験環境の標準化

これらがすべてPythonインターフェースで統一されているため、研究者やエンジニアは低レベル実装を意識せずにアルゴリズム開発へ集中できます。

また、AI分野では試行錯誤のサイクルが非常に速く、コードの可読性や再現性も重要になります。

その点でもPythonは文法がシンプルで、チーム開発や論文ベースの再現実装にも適しています。

結果として「AI開発=Python」という構図が自然に形成されていきました。

本記事では、この構図が偶然ではなく、言語設計・ライブラリ戦略・研究文化の三つが重なった結果であることを、もう少し深掘りしていきます。

なぜAI開発はPythonなのか:歴史と普及の背景

AI開発の現場でPythonが標準言語として定着している背景には、単なる偶然ではなく、技術史・研究文化・言語設計が複合的に絡み合った構造的な理由があります。

結論から言えば、Pythonは「AIのために作られた言語」ではありませんが、「AI開発の要求に最も適応した言語」だったという位置づけになります。

まず歴史的な観点から見ると、機械学習や統計解析の初期段階ではCやFortran、あるいはMatlabが主流でした。

しかしこれらの言語は計算性能には優れる一方で、実験的なアルゴリズム開発や迅速な試行錯誤には向いていませんでした。

特にAI研究では以下のような要件が重要になります。

- 仮説検証のサイクルを高速に回せること

- データ前処理から学習・評価までを一貫して記述できること

- 可読性が高く再現性が確保できること

この要求に対してPythonは非常に自然に適合しました。

次に普及の決定的要因となったのが、2000年代後半以降に急速に整備された科学計算エコシステムです。

NumPyやSciPyの登場により、Pythonは単なるスクリプト言語から「数値計算のフロントエンド」として機能するようになりました。

内部ではCやFortranの高速処理を利用しながら、ユーザーはPythonのシンプルな構文で操作できる構造が確立されたのです。

ここで重要なのは、Python自体が高速である必要はなかったという点です。

むしろ「高速な実装を隠蔽するインターフェース」としての役割が重視されました。

この設計思想がAI分野と極めて相性が良く、後に登場するTensorFlowやPyTorchも同様のアーキテクチャを採用しています。

さらに、研究コミュニティの文化的要因も無視できません。

AI研究は論文ベースで進化するため、再現性と共有性が非常に重要です。

Pythonはコードの可読性が高く、他者の実装を理解しやすいという特性を持っています。

これにより、世界中の研究者が同じコードベースを共有しやすくなり、結果としてエコシステムが加速度的に拡大しました。

また教育分野でもPythonの採用が進みました。

大学のデータサイエンス講義やオンライン学習環境において、複雑な文法を持つ言語よりもPythonの方が学習コストが低く、AI分野への参入障壁を下げる効果がありました。

整理すると、PythonがAI開発の標準になった要因は以下の3点に収束します。

| 要因 | 内容 | 影響 |

|---|---|---|

| 技術的要因 | C/C++による高速処理を裏側に持つ構造 | 性能と簡易性の両立 |

| 研究的要因 | 再現性と可読性の高さ | 論文文化との適合 |

| 教育的要因 | 学習コストの低さ | 人材流入の増加 |

この3つが同時に成立したことで、Pythonは単なるプログラミング言語を超えて「AI開発の共通基盤」としての地位を確立しました。

現在では、PyTorchやTensorFlowといった主要フレームワークがPythonを第一言語として採用しているため、新規参入者も自然とPythonを選択する構造が固定化されています。

結果として、言語選択の自由度があるにもかかわらず、実質的にPython一強の状態が続いているのです。

つまりAI開発におけるPythonの地位は、技術的優位性だけではなく、歴史的経緯とコミュニティ形成の積み重ねによって成立したものだと言えます。

機械学習ライブラリがPythonに集中する技術的理由

機械学習ライブラリがPythonに集中している現象は、単なる言語の人気ではなく、ソフトウェアアーキテクチャの設計原理に基づいた合理的な帰結です。

特に重要なのは、計算性能を担う低レイヤーと、開発者が触れる高レイヤーを明確に分離するという構造です。

この分離が成立したことで、Pythonは「実行基盤」ではなく「制御インターフェース」としての役割を獲得しました。

AI開発では、行列計算やテンソル演算といった計算負荷の高い処理が中心になりますが、それらをすべてPythonで実装するのは現実的ではありません。

そのため、内部実装をCやC++に委譲しつつ、ユーザーはPythonで操作するという設計が主流になりました。

この構造がライブラリの集中を加速させています。

低レイヤー実装とPythonラッパー構造

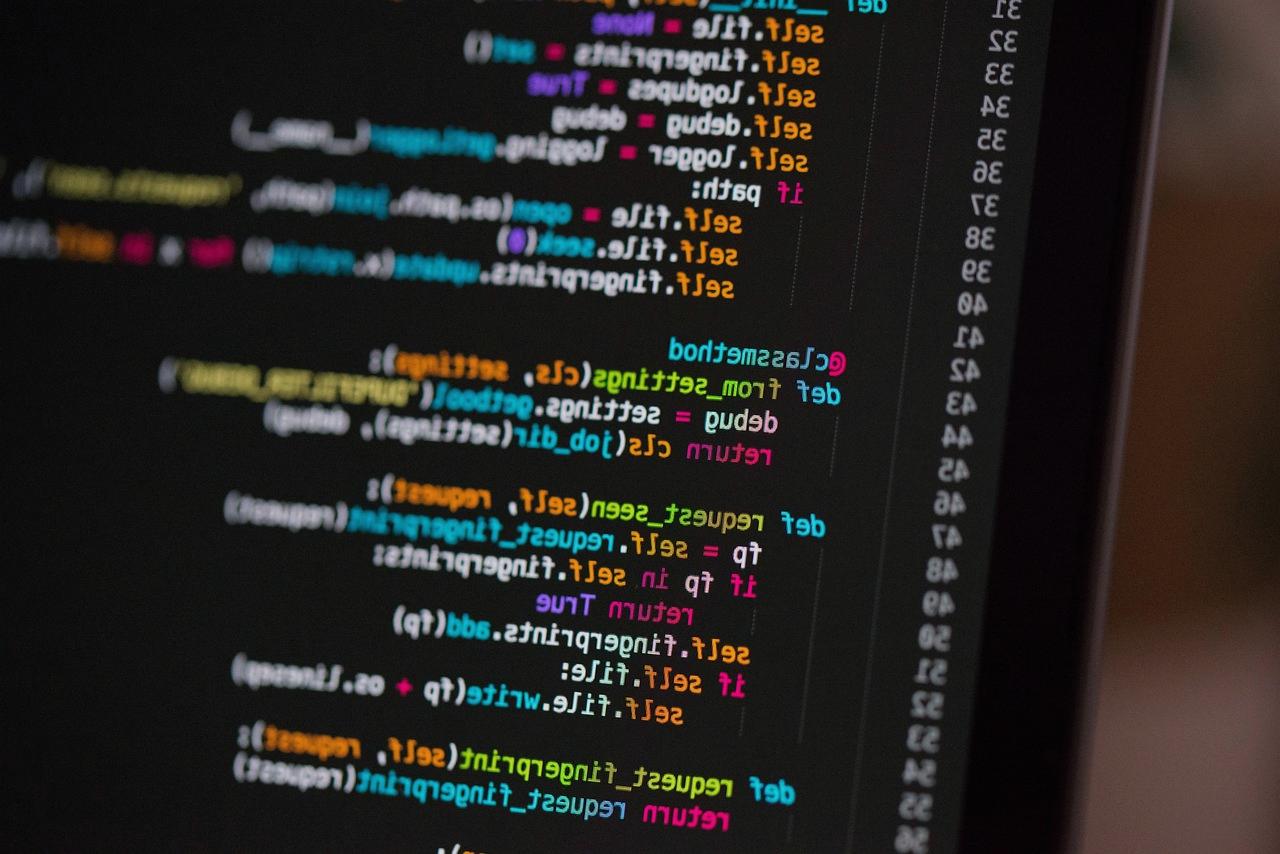

機械学習ライブラリの多くは、内部に高速なC/C++実装を持ち、それをPythonから呼び出す形で設計されています。

例えば行列演算や最適化アルゴリズムなどのコア部分はネイティブコードで実行され、Python側はその制御インターフェースとして機能します。

この設計の本質は「責務の分離」にあります。

計算処理は低レイヤーで最適化し、ユーザー体験や実験的操作はPythonで担うことで、性能と開発効率の両立が可能になります。

実際のコード構造は次のようなイメージになります。

import numpy as np

a = np.array([1, 2, 3])

b = np.array([4, 5, 6])

c = np.dot(a, b)

print(c)

このコード自体はPythonですが、np.dotの内部ではCで実装された高速な行列演算が呼び出されています。

つまり、開発者はPythonの文法だけを扱いながら、実際には低レイヤーの最適化恩恵を受けている構造です。

この「見せ方と実体の分離」が、Pythonを機械学習のフロントエンドとして成立させている根本要因です。

C/C++連携による高速化の仕組み

機械学習ライブラリが高性能である理由は、Python単体の性能ではなく、C/C++との緊密な連携構造にあります。

特にNumPyやPyTorchでは、計算のボトルネックとなる部分をすべてネイティブコードに移譲し、Pythonはオーケストレーションのみを担当します。

この仕組みを整理すると以下のようになります。

| 層 | 使用技術 | 役割 |

|---|---|---|

| Python層 | Python | API制御・実験記述 |

| バインディング層 | Cython / pybind11 | PythonとC++の橋渡し |

| コア層 | C/C++ | 高速数値計算 |

この構造により、Pythonの柔軟性とC++の性能を同時に利用できます。

特に深層学習ではGPUとの連携も重要であり、CUDAなどの低レイヤー技術がさらに下層に組み込まれています。

また、この設計は開発者体験にも大きな影響を与えています。

アルゴリズム研究者はC++の複雑なメモリ管理を意識する必要がなく、Pythonレベルで実験を繰り返すことができます。

その結果、研究速度と実装速度の両方が飛躍的に向上しました。

このように、機械学習ライブラリのPython集中は単なる言語選好ではなく、階層的アーキテクチャの必然的帰結として理解することが重要です。

NumPy・Pandasが支えるデータ処理の標準化

AI開発においてPythonが中心的な役割を担う理由の一つに、NumPyとPandasによるデータ処理基盤の標準化があります。

機械学習は本質的にデータ駆動型の領域であり、モデルそのものよりも入力データの整形や前処理が成果を左右するケースが多く存在します。

そのため、データ処理の効率性と一貫性は極めて重要な要素になります。

NumPyとPandasはこの課題に対して、異なるレイヤーで補完関係を築いています。

NumPyは数値計算の低レイヤー基盤として高速な配列処理を提供し、Pandasはそれをより抽象化したデータ構造として扱うことで、分析作業を直感的に行えるようにしています。

この二層構造が、Pythonをデータ分析の事実上の標準へと押し上げました。

行列計算とベクトル演算の最適化

NumPyの本質は、多次元配列(ndarray)を中心とした高速な数値計算にあります。

特に行列計算やベクトル演算は、機械学習アルゴリズムの根幹を支える処理であり、その効率性は全体の性能に直結します。

例えば単純な内積計算であっても、Pythonのネイティブループでは性能が不足しますが、NumPyを用いることでC言語レベルで最適化された処理を利用できます。

import numpy as np

a = np.array([1, 2, 3, 4])

b = np.array([5, 6, 7, 8])

result = np.dot(a, b)

print(result)

このコードの見た目は非常にシンプルですが、内部ではSIMD命令やメモリアクセス最適化が行われており、純粋なPython実装とは比較にならない性能を発揮します。

さらに重要なのは、NumPyがベクトル化思考を開発者に強制する点です。

ループ処理ではなく配列演算として問題を捉えることで、アルゴリズム設計そのものが効率的な形へと誘導されます。

データ分析パイプラインの構築効率

PandasはNumPyを基盤としながら、より現実的なデータ構造、すなわち表形式データを扱うためのライブラリです。

CSVやSQLデータベースから取得したデータをそのまま扱えるため、データサイエンスにおける前処理工程を大幅に簡略化します。

特にAI開発では、データの欠損処理、型変換、フィルタリングといった操作が頻繁に発生します。

Pandasはこれらを統一的なAPIで扱えるように設計されており、パイプライン構築の複雑性を大幅に削減します。

例えば以下のような処理は典型的です。

import pandas as pd

df = pd.read_csv("data.csv")

df = df.dropna()

df["value"] = df["value"] * 2

print(df.head())

このような記述によって、データの読み込みから加工までを短いコードで表現できます。

また、Pandasの強みは単なる簡便さではなく、処理の連鎖性にあります。

データの抽出、変換、集約といった一連の処理を直列的に記述できるため、分析パイプライン全体の可読性が向上します。

| 機能領域 | NumPy | Pandas |

|---|---|---|

| データ構造 | 多次元配列 | 表形式データ |

| 主用途 | 数値計算 | データ分析 |

| 最適化対象 | 行列演算 | 集計・加工 |

このように役割が明確に分離されているため、AI開発者は「どちらを使うべきか」を迷う必要がほとんどありません。

結果として、データ処理の標準フローがPythonエコシステム内で自然に形成され、機械学習ライブラリとの統合もスムーズに進む構造が成立しています。

NumPyとPandasの存在は単なる便利ツールではなく、AI開発におけるデータ処理の共通言語として機能している点が本質的に重要です。

PyTorchとTensorFlowのエコシステム比較

機械学習フレームワークの中でも、PyTorchとTensorFlowは長らく二大勢力として並立してきました。

両者は同じディープラーニングという領域を扱いながらも、設計思想と最適化の方向性が異なっており、その違いが利用シーンの分化を生み出しています。

AI開発においてPythonが中心である理由の一端も、このフレームワークの構造的進化と密接に関係しています。

両者の違いを理解するためには、単なるAPIの差ではなく「実行モデル」と「開発プロセスの設計思想」を見る必要があります。

PyTorchは動的計算グラフを採用し、TensorFlowは静的計算グラフを中心に発展してきました。

この違いが、研究用途と本番環境という役割分担を生み出しています。

研究用途に強いPyTorchの特徴

PyTorchの最大の特徴は、動的計算グラフによる直感的なプログラミングモデルにあります。

これはコードをそのまま実行しながら計算グラフが構築される方式であり、デバッグ性と柔軟性に優れています。

研究開発の現場では、アルゴリズムの仮説検証が頻繁に行われるため、コードの変更が即座に反映されることが重要です。

PyTorchはPythonのネイティブな制御構文と自然に統合されるため、複雑なモデル構築でも直感的に記述できます。

import torch

import torch.nn as nn

x = torch.tensor([1.0, 2.0, 3.0])

y = x * 2 + 1

print(y)

このように、通常のPythonコードとほぼ同じ感覚でテンソル演算が記述できるため、研究者はアルゴリズム設計そのものに集中できます。

またPyTorchは、研究コミュニティとの親和性が高く、新しい論文実装が最も早く反映される傾向があります。

このスピード感は、AI研究の進化速度と一致しており、結果として学術分野でのデファクトスタンダードとなりました。

本番運用に強いTensorFlowの構造

TensorFlowは当初から本番環境でのスケーラビリティを強く意識して設計されています。

静的計算グラフを採用することで、事前に最適化された実行計画を構築できる点が大きな特徴です。

この構造は分散処理やモバイルデバイスへの展開において特に有効です。

TensorFlowの特徴を整理すると以下のようになります。

| 観点 | TensorFlowの特徴 | 影響 |

|---|---|---|

| 実行モデル | 静的計算グラフ | 最適化容易 |

| デプロイ | モバイル・サーバー対応 | 本番向け |

| エコシステム | TensorFlow Serving等 | 運用重視 |

特にTensorFlow Servingのような推論専用サーバーは、モデルをそのままAPIとして公開できる仕組みを提供しており、企業のAIプロダクション環境に適しています。

また、TensorFlowはKerasとの統合により高レベルAPIも整備され、かつての複雑な記述性は大幅に改善されました。

これにより、研究と本番のギャップは徐々に縮小していますが、それでも内部構造の思想は「安定した大規模運用」に最適化されています。

重要なのは、PyTorchとTensorFlowの優劣ではなく、設計目標の違いです。

前者は柔軟性と実験速度、後者は安定性とスケーラビリティを重視しており、AI開発のライフサイクルの異なる段階を補完し合う関係にあります。

結果として、Pythonエコシステムは単一のフレームワークに依存するのではなく、複数の設計思想を統合した柔軟な基盤として発展しているのです。

Jupyter NotebookがAI研究開発を加速する理由

AI研究開発の現場において、Jupyter Notebookは単なる実行環境を超えた「思考と実装の統合空間」として機能しています。

従来のスクリプトベース開発では、コードを書く・実行する・結果を確認するというプロセスが分断されていましたが、Jupyterはこの流れを一つのインターフェース上で完結させることで、試行錯誤の速度を劇的に向上させています。

特に機械学習のように実験的要素が強い領域では、この即時性が研究効率に直結します。

モデルの変更やデータの前処理をその場で確認しながら進められるため、仮説検証のサイクルが短縮される点が本質的な価値です。

インタラクティブ実行環境の利点

Jupyter Notebookの最大の特徴は、セル単位でコードを実行できるインタラクティブ性にあります。

これにより、プログラム全体を一度に実行する必要がなく、部分的な検証が容易になります。

例えばデータ前処理の段階では、以下のようにステップごとに処理結果を確認しながら進めることが可能です。

import pandas as pd

df = pd.read_csv("dataset.csv")

df.head()

このような段階的実行により、データの異常値や欠損の検出を即座に行うことができます。

従来のスクリプト型開発ではログ出力やデバッグが必要だった工程が、視覚的かつ即時的に確認できる点は大きな利点です。

また、JupyterはPythonカーネルと密接に連携しているため、変数の状態を保持したまま実験を続けることができます。

これにより、モデルの調整やパラメータ変更を繰り返しながら最適解を探索するプロセスが効率化されます。

再現性と共有性の高さ

AI研究において再現性は極めて重要な要素です。

同じコードとデータを用いて同じ結果が得られることは、研究の信頼性を担保する基盤となります。

Jupyter Notebookはコード、実行結果、説明文を一体化して保存できるため、この要件に非常に適しています。

さらにNotebook形式はそのまま共有可能であり、GitHubなどのプラットフォームを通じて容易に配布できます。

これにより、研究者間での知識共有が加速し、アルゴリズムの改善速度も向上します。

また、JupyterはMarkdownによるドキュメント記述も可能であり、コードと説明が同一文書内に共存します。

この構造により、以下のような利点が生まれます。

| 観点 | 効果 | 影響 |

|---|---|---|

| 再現性 | 実行環境ごと保存 | 実験結果の検証容易化 |

| 共有性 | ファイル単位で共有可能 | 研究コラボレーション促進 |

| 可読性 | 説明とコードの統合 | 理解コスト削減 |

特にAI分野では、複雑なモデル構造や前処理工程が多いため、単なるコードファイルよりも説明付きNotebookの方が圧倒的に理解しやすくなります。

さらに近年では、クラウド環境と組み合わせることで、ブラウザ上でそのままGPU計算を実行できるようになり、ローカル環境に依存しない開発スタイルが一般化しています。

この流れは研究開発のハードルを下げるだけでなく、教育用途にも大きな影響を与えています。

結果としてJupyter Notebookは、単なる実行環境ではなく、AI開発における思考・実験・共有を統合する中核的インフラとして機能していると言えます。

VSCode・GitHub Copilotが変えるPython開発体験

PythonによるAI開発が標準化していく中で、開発環境そのものも大きく進化しています。

その中心にあるのがVSCodeとGitHub Copilotの組み合わせです。

従来のエディタは単なるコード記述ツールでしたが、現在では「コード生成・補完・解析」を統合した知的な開発環境へと変化しています。

この変化は、Python開発の生産性を質的に引き上げています。

特にAI開発では、試行錯誤の頻度が非常に高く、短時間で複数の実装パターンを検証する必要があります。

そのため、手動入力の負荷を減らしつつ、コードの品質を維持する仕組みが重要になります。

VSCodeとCopilotの連携はこの課題に対して極めて合理的な解を提供しています。

AI補完によるコーディング効率化

GitHub Copilotは、LLMベースのコード補完ツールとして、開発者の意図を自然言語や既存コードから推測し、次に書くべきコードを提案します。

Pythonとの相性が良い理由は、構文の単純さとライブラリの統一性にあります。

例えば以下のような関数は、意図を少し書くだけで自動補完されることがあります。

def preprocess_data(df):

# 欠損値処理と正規化を行う

pass

このコメントだけで、CopilotはPandasを用いたデータ前処理コードを提案することが可能です。

これにより、開発者は細かいAPIの記述ではなく、アルゴリズム設計に集中できます。

さらに重要なのは、単なる補完ではなく「文脈理解」に基づいた提案が行われる点です。

変数名や既存コードの構造を解析し、プロジェクト全体に整合する形でコードが生成されるため、従来のスニペットツールとは本質的に異なります。

デバッグとリファクタリング支援

VSCodeはデバッグ環境としても非常に強力であり、Python開発においてはブレークポイント、変数監視、ステップ実行などの機能が統合されています。

これにより、AIモデルの挙動を逐次的に追跡することが可能になります。

特に機械学習では、数値の変化やテンソルの形状ミスがバグの原因になることが多いため、視覚的なデバッグ支援は重要です。

VSCodeでは以下のような情報をリアルタイムで確認できます。

| 機能 | 内容 | 効果 |

|---|---|---|

| 変数ウォッチ | 実行中の値確認 | バグ特定の迅速化 |

| ステップ実行 | 行単位の実行 | ロジック検証 |

| コールスタック | 関数呼び出し追跡 | 構造理解 |

さらにCopilotはリファクタリングにも影響を与えています。

冗長なコードや非効率な処理を検出し、よりPythonicな書き方へと改善案を提示することが可能です。

これにより、コード品質の維持コストが大幅に低下します。

結果として、VSCodeとGitHub Copilotの組み合わせは単なる開発支援ツールではなく、Python開発における「認知負荷の外部化装置」として機能しています。

開発者は実装詳細から解放され、より上位の設計判断に集中できるようになります。

この変化はAI開発のスピードそのものを押し上げる重要な要因になっています。

Pythonが遅いと言われる理由とC拡張の裏側

PythonはAI開発の標準言語として広く利用されていますが、一方で「遅い言語である」という評価も根強く存在します。

この評価は半分正しく、半分は誤解に基づいています。

重要なのは、Python単体の実行速度ではなく、どのような設計思想のもとで性能問題が回避されているかという点です。

AI開発におけるPythonは、計算そのものを担うのではなく、計算を「指示する役割」に特化しています。

この構造を理解しないまま表面的な実行速度だけを見ると、「遅い言語」という印象が強調されてしまいます。

しかし実際には、内部でC/C++による高速処理が行われており、システム全体としては十分な性能を発揮しています。

インタプリタ型言語の性能課題

Pythonが遅いとされる主な理由は、そのインタプリタ型言語としての実行モデルにあります。

Pythonコードは逐次的に解釈されながら実行されるため、コンパイル済み言語と比較するとオーバーヘッドが発生します。

特に問題となるのはループ処理や逐次的な数値計算です。

例えば純粋なPythonで大規模な配列演算を行う場合、各要素に対してPythonレベルの処理が介在するため、パフォーマンスが大幅に低下します。

result = []

for i in range(1000000):

result.append(i * 2)

このような処理は直感的には単純ですが、内部的にはPythonオブジェクトの生成とメモリアクセスが繰り返されるため、C言語などと比較して非効率になります。

この構造的制約が「Pythonは遅い」という評価の根拠になっていますが、AI開発ではこの問題を別のレイヤーで解決しています。

Cythonやネイティブ拡張の役割

Pythonの性能問題を解決するために導入されているのが、C拡張やCythonといった技術です。

これらはPythonコードとC/C++コードの橋渡しを行い、計算負荷の高い部分をネイティブコードに委譲します。

この仕組みにより、Pythonは「制御層」として動作し、実際の計算は低レイヤーで処理されます。

NumPyやPyTorchも同様の設計を採用しており、内部では高度に最適化されたC/CUDAコードが動作しています。

| 技術 | 役割 | 効果 |

|---|---|---|

| Cython | PythonとCの中間層 | 静的コンパイルによる高速化 |

| ctypes / cffi | Cライブラリ呼び出し | 既存資産の活用 |

| ネイティブ拡張 | C/C++直接統合 | 最大限の性能 |

例えばCythonを用いると、Python風の記述を維持しながらコンパイル最適化を行うことができます。

# Cython風の例

cpdef int add(int a, int b):

return a + b

このようなコードはCレベルに変換されるため、通常のPython関数と比較して大幅な高速化が可能になります。

重要なのは、Python単体で性能を追求するのではなく、システム全体として性能を担保する設計思想です。

AI開発では計算部分を外部化し、Pythonは高レベル制御に徹することで、柔軟性と性能の両立を実現しています。

この構造を理解すると、「Pythonは遅い」という評価が単純な誤解であり、むしろ適切に設計された分散的アーキテクチャの一部であることが明確になります。

AWS・GCPなどクラウド環境とPythonの親和性

AI開発の実務において、Pythonが圧倒的な支持を得ている理由の一つに、AWSやGCPといったクラウドプラットフォームとの高い親和性があります。

現代の機械学習システムはローカル環境だけで完結することはほとんどなく、データ収集から学習、推論、デプロイまでがクラウド中心に構築されるケースが一般的です。

その中でPythonは事実上の共通言語として機能しています。

クラウド環境では、スケーラビリティと自動化が極めて重要です。

Pythonはその両方に適した設計を持ち、各種クラウドサービスのSDKも充実しているため、インフラ操作からAIモデルの運用まで一貫して記述することが可能です。

サーバーレスとPythonの相性

サーバーレスアーキテクチャは、インフラ管理を意識せずにコードを実行できる仕組みであり、AWS LambdaやGoogle Cloud Functionsが代表的な実装です。

このモデルとPythonの相性は非常に高く、軽量な実行環境とシンプルな構文がその理由です。

Pythonは起動コストが低く、短時間実行の関数型処理に適しています。

そのため、イベントドリブンな処理やAPIバックエンドとして頻繁に利用されます。

例えばAWS Lambdaでは以下のようなシンプルな関数で処理を記述できます。

def lambda_handler(event, context):

return {

"statusCode": 200,

"body": "Hello from Python Lambda"

}

このように、インフラ設定を意識せずにロジックだけを記述できる点は、開発速度の向上に直結します。

また、Pythonは標準ライブラリや外部SDKが充実しているため、データベース接続やAPI通信も容易に実装できます。

さらにサーバーレス環境ではスケーリングが自動化されているため、Pythonの実行効率の制約が問題になりにくく、むしろ開発の柔軟性が重視されます。

機械学習APIとクラウド統合

クラウド環境におけるもう一つの重要な要素は、機械学習APIとの統合です。

AWS SageMakerやGoogle AI Platformのようなサービスは、モデルのトレーニングからデプロイまでを一元管理できる仕組みを提供していますが、その中心インターフェースとしてPythonが採用されています。

これは単なる偶然ではなく、Pythonがデータ処理からモデリング、評価まで一貫して記述できる言語であるためです。

特にscikit-learnやPyTorchとの連携により、ローカルで開発したコードをほぼそのままクラウド環境へ移行できます。

| クラウドサービス | Python連携 | 主な用途 |

|---|---|---|

| AWS SageMaker | boto3 / SDK | モデル学習・デプロイ |

| Google Vertex AI | Python SDK | 機械学習パイプライン |

| Azure ML | azureml-sdk | 実験管理・運用 |

このように、主要クラウドベンダーはすべてPythonファーストの設計思想を採用しており、結果としてAI開発の標準インターフェースがPythonに収束しています。

また、クラウド統合の本質は単なるAPI呼び出しではなく、分散システムとしてのワークフロー管理にあります。

Pythonはその記述性の高さから、データ取得、前処理、学習、推論といった一連のパイプラインをコードとして明示的に表現できます。

結果として、Pythonはクラウド時代のAI開発において「実行言語」であると同時に「オーケストレーション言語」としても機能しており、その役割は今後さらに拡大していくと考えられます。

まとめ:AI開発においてPythonが標準となった本質

AI開発の現場でPythonが標準言語として定着した背景を総合的に整理すると、その本質は単一の技術的優位性ではなく、複数のレイヤーが相互に補完し合った結果であると理解できます。

言語仕様、ライブラリエコシステム、研究文化、そしてクラウドや開発環境の進化が同じ方向に収束したことで、Pythonは「選ばれた言語」ではなく「選ばざるを得ない言語」へと変化しました。

まず重要なのは、PythonがAI専用に設計された言語ではないにもかかわらず、結果的にAI開発の要求に最も適合していたという点です。

機械学習では高速な数値計算、柔軟なプロトタイピング、再現性の確保が同時に求められますが、Pythonはその上位層として機能し、計算そのものはC/C++やGPUライブラリに委譲する設計を採用しました。

この分業構造が成立したことで、開発者は複雑な低レイヤーを意識せずにアルゴリズム設計に集中できるようになりました。

また、NumPyやPandasのような基盤ライブラリの存在も決定的でした。

これらは単なる便利ツールではなく、データ処理の共通インターフェースとして機能し、AI開発における事実上の標準APIとなりました。

さらにPyTorchやTensorFlowといったフレームワークがPythonを第一言語として採用したことで、エコシステム全体がPython中心に再編される構造が固定化されました。

ここで重要なのは、個々の技術要素ではなく、それらが形成した「一貫した開発体験」です。

データ取得から前処理、モデル構築、学習、評価、デプロイまでがすべてPythonで統一されているため、開発者は異なる言語間のコンテキストスイッチを行う必要がありません。

この統一性が生産性を大きく押し上げています。

さらに、Jupyter NotebookやVSCode、GitHub Copilotといった開発環境の進化も無視できません。

これらは単なる補助ツールではなく、Pythonを中心とした開発フローを前提に設計されており、試行錯誤の速度とコード品質の両立を可能にしています。

特にAI支援による補完機能は、コード記述そのものの意味を変えつつあります。

クラウド環境との統合も本質的な要素です。

AWSやGCP、Azureといった主要プラットフォームはPython SDKを標準として提供しており、AIモデルの学習からデプロイまでをシームレスに接続できます。

この結果、ローカル開発と本番環境の差異が縮小し、Pythonは分散システム全体の制御言語としても機能するようになりました。

これらの要素を統合すると、Pythonの優位性は単なる「書きやすさ」や「ライブラリの豊富さ」に還元できるものではないことが分かります。

むしろ本質は、以下のような構造的特性にあります。

| 観点 | 内容 | 意味 |

|---|---|---|

| 言語設計 | シンプルで高可読性 | 参入障壁の低下 |

| 実行構造 | C/C++とのハイブリッド | 性能と柔軟性の両立 |

| エコシステム | ライブラリの集中 | 標準化の進行 |

| 開発環境 | Jupyter・VSCode統合 | 実験速度の向上 |

| クラウド統合 | SDK標準化 | 運用までの一貫性 |

このように見ると、Pythonは単なるプログラミング言語ではなく、AI開発における「統合レイヤー」として機能していることが分かります。

最終的に重要なのは、PythonがAI開発の中心であり続けている理由が、個別の技術的優位性ではなく、エコシステム全体の整合性にあるという点です。

今後新しい言語やフレームワークが登場したとしても、この統合構造を再現できない限り、Pythonの地位が大きく揺らぐ可能性は低いと考えられます。

コメント