近年、生成AIの進化によってコードは「書くもの」から「生成されるもの」へと急速に変化しています。

いわゆるバイブコーディングと呼ばれる潮流では、開発者は自然言語で意図を伝えるだけで、AIが実装を補完する世界が現実になりつつあります。

しかしその一方で、生成されるコードの品質や安全性は必ずしも保証されておらず、従来以上に言語レベルでの制約や検証の重要性が増しています。

特に以下のような課題は顕著です。

- 型安全性の欠如によるランタイムエラーの増加

- 不正なメモリアクセスや競合状態の潜在的混入

- AIが文脈を誤解した際の脆弱なロジック生成

こうした背景の中で、Rustという言語は改めて注目されています。

Rustはコンパイル時に所有権や借用を厳密にチェックすることで、実行前に多くのバグを排除する設計思想を持っています。

この性質は、AIが生成した不確実なコードに対しても強力な安全弁として機能します。

また、ガベージコレクションに依存しないメモリ安全性の担保は、予測不能なコード生成と非常に相性が良い特性でもあります。

さらに重要なのは、AI時代においては「正しく動くこと」だけでなく「壊れない前提で組めること」が価値になる点です。

Rustはその思想を言語レベルで強制するため、開発者の意図と生成コードのズレを構造的に抑え込む役割を果たします。

本記事では、バイブコーディング時代においてRustがどのような立ち位置を持ち得るのか、そして「AIがコードを書く時代」において言語そのものがどのように安全性を担保し得るのかを論理的に整理していきます。

バイブコーディングとは何か:AI生成コード時代の開発スタイルの変化

バイブコーディングとは、従来のように開発者が逐次コードを設計・実装するのではなく、自然言語による意図の提示を起点としてAIがコード生成を担い、人間はその結果をレビュー・修正・統合するという新しい開発スタイルを指します。

この変化は単なる生産性向上の話にとどまらず、ソフトウェア開発の認知モデルそのものを変えつつあります。

従来の開発では「設計 → 実装 → テスト」という直線的なプロセスが中心でした。

しかしバイブコーディングでは、この境界が曖昧になります。

開発者は設計と実装の中間に位置し、AIとの対話を通じてコードを“探索的に生成する”形へと移行します。

このとき重要になるのは、正確なコードを書く能力以上に、曖昧な要求を構造化された指示へと変換する能力です。

例えば単純なAPI実装であっても、従来であれば以下のような明示的なコード設計が必要でした。

fn fetch_user(id: u64) -> Result<User, Error> {

// DBアクセス処理

}

しかしバイブコーディングでは「ユーザーIDからユーザー情報を安全に取得するAPIをRustで作って」といった自然言語が入力となり、AIが複数の実装候補を生成します。

この段階で開発者の役割は、実装そのものではなく「どの生成結果がシステム全体の整合性に適合するか」を判断することにシフトします。

この変化を整理すると、従来型とバイブコーディングの差異は次のように捉えられます。

| 観点 | 従来型開発 | バイブコーディング |

|---|---|---|

| 主体 | 人間中心 | 人間+AI協調 |

| プロセス | 明示的設計と実装 | 自然言語による生成駆動 |

| 価値 | 実装能力 | 指示設計能力 |

| ボトルネック | コーディング速度 | 意図の明確性 |

このように、開発のボトルネックはコードを書く速度ではなく、要求の曖昧さをどれだけ排除できるかへと移行しています。

つまり、仕様定義能力そのものがエンジニアリングスキルの中心に再配置されていると言えます。

さらに重要なのは、AIが生成するコードは確率的であるという点です。

同じ入力でも異なる実装が返る可能性があるため、従来のような決定論的な開発フローは成立しにくくなっています。

この不確実性は開発の柔軟性を高める一方で、品質保証の難易度を上げる要因にもなります。

そのためバイブコーディングでは、単に生成されたコードを受け入れるのではなく、構造的に安全性を担保できる枠組みが不可欠になります。

この文脈において、後続で議論するRustのような静的型システムや所有権モデルは、AI時代の不確実性を制御するための重要な技術基盤として位置付けられることになります。

結論として、バイブコーディングとは単なる開発効率化のトレンドではなく、開発者の役割が「コードを書く人」から「生成空間を設計する人」へと変化する構造的な転換点です。

この変化を正しく理解することが、AI時代のソフトウェア設計において極めて重要になります。

LLMによるコード生成の現実:精度・安全性・再現性の課題

大規模言語モデル(LLM)によるコード生成は、開発現場に劇的な効率改善をもたらした一方で、その内部には本質的な不確実性が存在しています。

特に精度・安全性・再現性という三つの観点は、実運用において常に問題の中心にあります。

生成AIは統計的パターンに基づいてコードを出力するため、構文的には正しく見えるコードであっても、論理的に誤っているケースが少なくありません。

まず精度の問題について考えると、LLMは入力されたプロンプトの意図を完全に形式化する能力を持っているわけではありません。

そのため、同じ要求であっても微妙に異なる実装が生成されることがあり、これがバグの温床になります。

特にアルゴリズムの正確性が要求される領域では、この揺らぎは致命的になり得ます。

例えば単純なフィボナッチ関数であっても、生成結果は一様ではありません。

fn fib(n: u32) -> u32 {

match n {

0 => 0,

1 => 1,

_ => fib(n - 1) + fib(n - 2),

}

}

このような再帰実装は正しく見えますが、LLMは最適化や計算量の観点を必ずしも考慮しないため、非効率なコードが生成されることも頻繁にあります。

実運用ではメモ化や反復処理が必要になるケースも多く、生成結果をそのまま採用することは危険です。

次に安全性の問題です。

LLMはセキュリティコンテキストを完全に理解しているわけではないため、SQLインジェクションやバッファオーバーフローといった脆弱性を含むコードを生成する可能性があります。

これは特にWebアプリケーションやシステムレベルの開発において重大なリスクとなります。

| 観点 | 問題の本質 | 影響 |

|---|---|---|

| 精度 | 意図の曖昧な解釈 | ロジックエラー |

| 安全性 | セキュリティ理解の欠如 | 脆弱性混入 |

| 再現性 | 出力の確率的変動 | テスト困難 |

そして最も見落とされがちなのが再現性の問題です。

同じプロンプトを与えても、モデルの状態や温度パラメータによって異なるコードが生成されるため、CI/CDパイプラインに組み込んだ際の挙動が安定しないことがあります。

これは従来のソフトウェア工学における「決定論的ビルド」という前提を揺るがす要因です。

この問題は特にチーム開発において顕著です。

ある開発者が生成したコードと別の開発者が生成したコードが一致しない場合、レビューコストが増大し、設計の一貫性が損なわれます。

結果として、AIによる生産性向上がそのまま品質向上につながるとは限らないという現実が浮かび上がります。

重要なのは、LLMを「完全なコード生成器」として扱うのではなく、「不確実性を含む提案システム」として捉えることです。

この前提に立つことで、生成コードに対する検証プロセスや型システムの重要性が明確になります。

特にRustのようなコンパイル時検証を持つ言語は、この不確実性を構造的に抑制する役割を果たすため、AI時代の開発において重要な意味を持つことになります。

RustがAI生成コードに強い理由:所有権と静的型付けの本質

RustがAI生成コード時代において特に注目される理由は、その言語設計が単なる性能志向ではなく、「安全性をコンパイル時に証明する」という明確な思想に基づいている点にあります。

これは生成AIがもたらす確率的で不完全なコード出力と非常に相性が良い特性です。

まず理解すべきは、AIが生成するコードは基本的に「それっぽく動く可能性が高いコード」であって、「正しさが保証されたコード」ではないという点です。

このギャップを埋める仕組みが言語側に存在しなければ、実行時エラーや未定義動作がシステム全体に波及する危険性があります。

Rustはこの問題に対して、所有権モデルと静的型システムを組み合わせることで、実行前に多くの論理的不整合を排除する設計を採用しています。

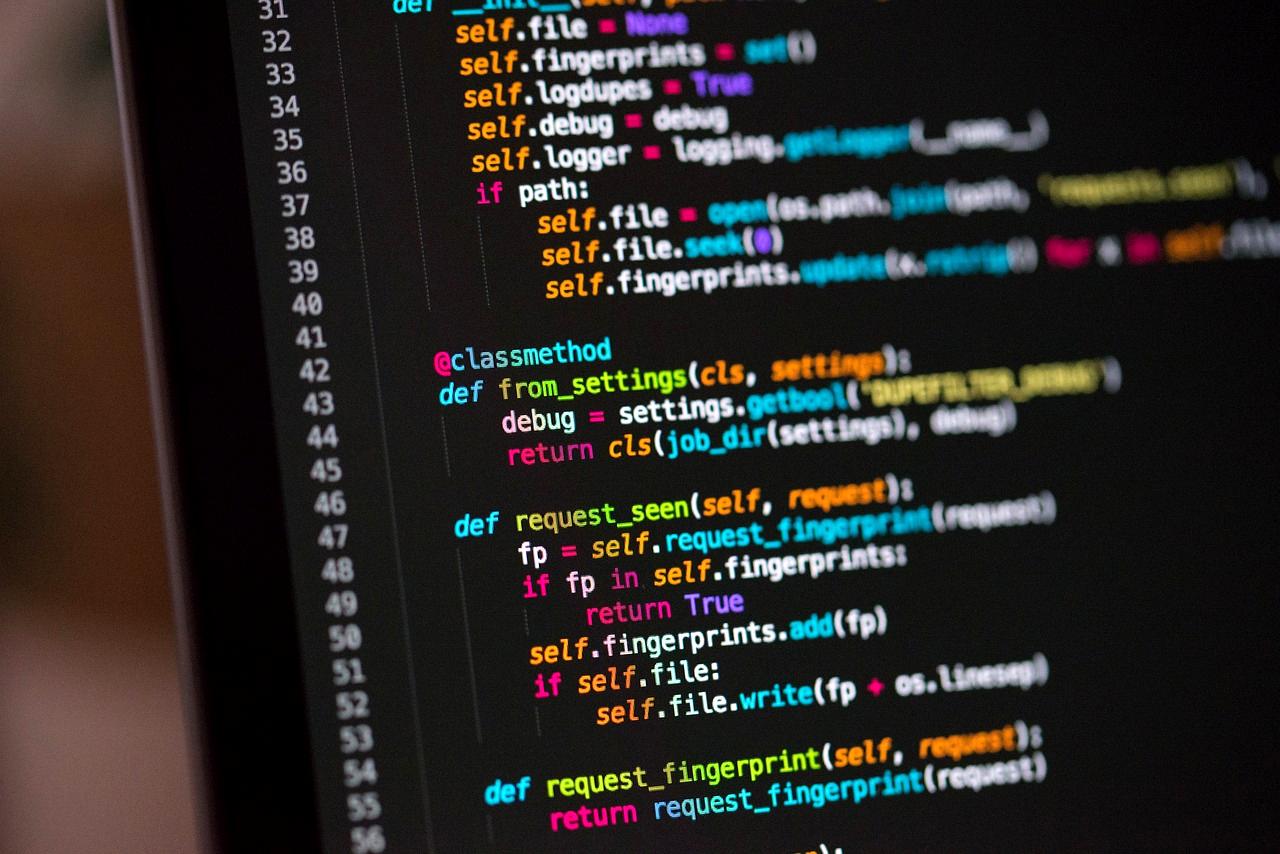

所有権の概念はRustの中核です。

これはメモリのライフサイクルをコンパイル時に追跡する仕組みであり、二重解放やダングリングポインタといった典型的なメモリエラーを原理的に排除します。

AIが生成したコードにおいて、メモリ管理の意図が曖昧であっても、コンパイラが強制的に整合性を要求するため、結果として安全性が担保されます。

例えば以下のようなコードはRustでは明確に制約されます。

fn borrow_example(s: &String) -> &str {

&s[..]

}

このような借用のルールは、AIが生成したコードに潜在する「所有権の曖昧さ」を構造的に排除します。

つまり、開発者が細部を意識しなくても、言語レベルで整合性が強制されるのです。

さらに静的型付けの厳密性も重要な要素です。

Rustの型システムは単なる値の分類ではなく、プログラムの意味的制約を表現するための仕組みとして機能します。

これにより、AIが生成したコードにおける「型の不一致」や「意図しない変換」がコンパイル時点で検出されます。

この特性を整理すると、Rustの強みは次のように構造化できます。

| 要素 | 機能 | AI生成コードへの影響 |

|---|---|---|

| 所有権 | メモリ管理の明示化 | ランタイムエラーの排除 |

| 静的型付け | 型整合性の保証 | 意図しない動作の抑制 |

| コンパイラ検証 | 厳密な事前チェック | 不完全コードの拒否 |

重要なのは、Rustが「人間の注意力」に依存しない設計になっている点です。

従来の言語では、正しさの多くが開発者の経験やレビューに依存していました。

しかしAI生成コードでは、その前提自体が崩れています。

つまり、コードの出所が人間であることを前提にできない以上、言語側が防波堤になる必要があります。

この観点で見ると、Rustは単なる安全な言語ではなく、「不完全な入力を前提とした防御的言語設計」と言えます。

AIが生成するコードは常に揺らぎを持ちますが、その揺らぎを吸収しつつ、実行可能な形に収束させる役割をRustは担っています。

結果として、RustはAI時代において「コードの正しさを後付けで検証する言語」ではなく、「正しさの条件を事前に制約する言語」として機能します。

この構造的な違いこそが、AI生成コードとの親和性を決定づけている本質です。

メモリ安全性とコンパイル時検証が防ぐバグの本質

ソフトウェアバグの中でも特に深刻なものは、実行時にのみ顕在化するメモリ関連の問題です。

バッファオーバーフロー、ダングリングポインタ、二重解放といったエラーは、システムクラッシュやセキュリティ脆弱性に直結するため、従来の開発では常に警戒すべき領域でした。

しかし生成AIがコードを大量に生成するようになった現在、この問題の性質はさらに複雑化しています。

なぜなら、コードの「意図」が曖昧なまま拡張されるケースが増え、メモリ管理の責任境界がより不明瞭になっているためです。

Rustがこの問題に対して提供する解決策は、コンパイル時にメモリ安全性を証明するという設計思想です。

これは単なる静的解析ではなく、プログラムの実行前に「メモリの所有関係が破綻していないこと」を保証する仕組みです。

この保証は所有権、借用、ライフタイムという三つの概念によって構成されています。

所有権は、あるデータに対して同時に一つの明確な責任者しか存在できないというルールです。

この制約により、曖昧な参照関係が排除されます。

借用は一時的な参照を安全に行うための仕組みであり、読み取り専用や可変参照の制御を通じて競合状態を防ぎます。

そしてライフタイムは、参照が有効である期間を明示的に管理することで、無効なメモリアクセスを根本から排除します。

この三要素が連動することで、Rustコンパイラはプログラムの安全性を数学的制約として検証します。

つまり、バグが「起きないこと」を実行前に証明する構造になっているのです。

例えば以下のようなコードは、ライフタイムの制約により安全性が保証されます。

fn longest<'a>(x: &'a str, y: &'a str) -> &'a str {

if x.len() > y.len() { x } else { y }

}

この関数は一見単純ですが、返却される参照の有効範囲が明示されているため、コンパイラは不正なメモリアクセスを防ぐことができます。

AIが生成するコードでは、このようなライフタイムの概念が省略されがちですが、Rustではそれが許されません。

ここで重要なのは、メモリ安全性が「実行時の保護」ではなく「コンパイル時の制約」として扱われている点です。

この違いは本質的であり、従来のガベージコレクション型言語との最大の差異でもあります。

| 観点 | 従来言語 | Rust |

|---|---|---|

| メモリ管理 | 実行時GC | コンパイル時検証 |

| バグ検出タイミング | 実行時 | コンパイル時 |

| 予測可能性 | 低い | 高い |

AI生成コードとの関係で見ると、この設計は極めて重要です。

生成AIはしばしば「動くコード」を優先し、「安全なコード」を保証しません。

そのため、メモリ安全性が言語レベルで保証されていない場合、生成されたコードは表面的には正しく見えても、潜在的な危険性を含むことになります。

Rustはこの問題に対して、生成されたコードをそのまま受け入れるのではなく、コンパイラによって強制的に正しさを検証する構造を提供します。

これにより、AIの曖昧性がシステムの不安定性に直結することを防ぎます。

結論として、メモリ安全性とコンパイル時検証は単なる安全機能ではなく、AI時代における「不確実なコードを確定的な実行可能状態へ収束させるための数学的フィルタ」として機能しています。

この構造こそが、Rustが生成AI時代において重要視される根本的理由の一つです。

Python・JavaScriptとの比較で見えるAI時代の言語リスク

AIによるコード生成が一般化した現在、プログラミング言語の選択は単なる好みや開発効率の問題ではなく、「生成されたコードをどの程度信頼できるか」という構造的な問題へと変化しています。

この観点で見ると、PythonやJavaScriptのような動的型付け言語と、Rustのような静的型付けかつ厳密な安全性モデルを持つ言語との間には、AI時代特有のリスク差が明確に存在します。

まずPythonとJavaScriptの特徴として挙げられるのは、柔軟性の高さです。

型定義が緩く、実行時に型が決定されるため、プロトタイピングやAI生成コードとの相性は非常に良いと言えます。

しかしその柔軟性は裏を返すと「誤ったコードでも一見動作してしまう」という性質を持ちます。

これはAI生成コードにおいて特に危険であり、見た目上は正しいが論理的には誤っているコードが実行段階まで潜り込む原因になります。

例えばPythonでは次のようなコードが典型です。

def add(a, b):

return a + b

この関数は直感的には正しく見えますが、AIが生成する場合、aとbの型が想定外であっても実行時までエラーが検出されません。

文字列結合として動作する場合もあれば、数値演算として動作する場合もあり、文脈依存の挙動が潜在的なバグを生みます。

JavaScriptも同様に暗黙的型変換の問題を抱えています。

function add(a, b) {

return a + b;

}

このコードは数値演算にも文字列結合にもなり得るため、AIが生成したコードの意図と実行結果が乖離する可能性があります。

特にフロントエンドやAPI連携のような複雑な文脈では、この曖昧性がバグの原因として蓄積されます。

これに対してRustは、型の厳密性によってこの曖昧性を構造的に排除します。

PythonやJavaScriptが「動くことを優先する言語」であるのに対し、Rustは「正しいことを証明しない限り動かない言語」です。

この違いはAI生成コードとの相性において極めて重要です。

| 観点 | Python | JavaScript | Rust |

|---|---|---|---|

| 型安全性 | 動的 | 動的 | 静的・厳密 |

| AI生成コード適性 | 高いが危険 | 高いが危険 | 中程度だが安全 |

| バグ検出タイミング | 実行時 | 実行時 | コンパイル時 |

AI時代において特に問題となるのは「コードの信頼境界が曖昧になること」です。

PythonやJavaScriptでは、生成されたコードがそのまま実行されるため、誤ったロジックがそのまま本番環境に到達する可能性があります。

一方Rustでは、コンパイラが厳密な制約を課すため、AIが生成したコードであっても一定の安全基準を満たさなければ実行可能状態にはなりません。

重要なのは、AIが生成するコードの品質が言語の性質に依存するという点です。

柔軟性の高い言語ほど生成は容易ですが、その分だけ実行時リスクが増大します。

逆にRustのような厳格な言語では、生成の難易度は上がるものの、実行前に不正なコードが排除されるため、結果としてシステム全体の安定性が向上します。

結論として、PythonやJavaScriptはAI時代において「生成しやすいが検証が弱い言語」であり、Rustは「生成は難しいが検証が強い言語」です。

この差は単なる技術的特徴ではなく、AIを前提としたソフトウェア設計におけるリスク管理戦略そのものを左右する要素になっています。

CursorやGitHub CopilotとRust開発の相性と実践的ワークフロー

AI支援開発ツールであるCursorやGitHub Copilotは、バイブコーディング時代における開発体験を大きく変えつつあります。

特にRustのような静的型付けかつコンパイル時検証が厳格な言語との組み合わせは、一見すると相性が悪いように思われがちですが、実際には非常に構造的な補完関係が成立しています。

その理由は明確で、AIツールは「仮説生成」に強く、Rustは「仮説検証」に強いという役割分担が可能だからです。

CursorやGitHub Copilotは、関数の雛形やアルゴリズムの候補を高速に提示しますが、その正しさまでは保証しません。

一方Rustはコンパイラによって厳密な制約検証を行うため、生成されたコードの曖昧性を即座にフィードバックとして返すことができます。

この相互作用が開発ループを高速化しつつ品質を担保する構造を生みます。

実際の開発フローを考えると、この組み合わせは次のような循環構造になります。

まず開発者が自然言語で意図を記述し、CursorやCopilotがRustコードを生成します。

その後コンパイラが所有権や型の整合性を検証し、エラーが発生すればその情報をもとにAIが再生成を行います。

このプロセスは人間の手動修正を最小化しつつ、構造的に安全なコードへと収束していきます。

特にRustにおいて重要なのは、コンパイラエラーの情報が非常にリッチであるという点です。

これはAIにとって極めて有用なフィードバック信号となります。

単なる「エラーがある」という情報ではなく、「どのライフタイムが破綻しているか」「どの型が不整合か」といった具体的な構造情報が得られるため、AIはより精度の高い修正コードを生成できます。

例えば以下のようなフィードバックループが成立します。

fn process(data: &String) -> usize {

data.len()

}

このコードに対してAIが誤った借用を含めた場合でも、Rustコンパイラは明確なエラーを返します。

そのエラーを入力として再度AIが修正案を生成することで、コードは短いサイクルで収束していきます。

このようなワークフローを整理すると、AIとRustの関係は以下のように構造化できます。

| 要素 | Cursor / Copilot | Rustコンパイラ | 人間 |

|---|---|---|---|

| 役割 | 仮説生成 | 検証 | 意図定義 |

| 強み | 速度と多様性 | 厳密性 | 文脈理解 |

| 弱み | 正確性保証なし | 柔軟性なし | スケール限界 |

この三者関係において特に重要なのは、人間が詳細なコードを書く役割から解放される一方で、「意図の設計者」としての役割が強化される点です。

つまり、AIとRustの間における人間の役割は、コードそのものではなく制約条件の設計に移行しています。

さらに実務的な観点では、RustのビルドエラーがそのままAIへの修正プロンプトとして機能する点も重要です。

従来の開発ではエラー修正は人間が行う必要がありましたが、バイブコーディング環境ではエラーそのものがAIの入力データになります。

この変化により、開発ループは「生成→検証→修正」の閉じたシステムとして自動化されます。

結果として、CursorやGitHub Copilotは単なるコード補完ツールではなく、Rustの厳密な型システムと組み合わさることで「半自動的な形式検証付きコード生成エンジン」として機能します。

この構造こそが、AI時代における実践的な開発ワークフローの中核になりつつあります。

クラウド・インフラ領域で進むRust採用とAIコード生成の親和性

クラウドおよびインフラ領域におけるRustの採用は、ここ数年で着実に広がっています。

その背景には、単なるパフォーマンス志向ではなく、システムの安全性と予測可能性を重視する設計思想への回帰があります。

特に生成AIがコード生成の主役となりつつある現在、この領域ではRustとAIの組み合わせが構造的に非常に相性が良いことが明確になってきています。

クラウドインフラは本質的に「不確実性の上に構築された確実性」を扱う領域です。

ネットワーク遅延、分散システムの一貫性問題、リソース競合など、あらゆる要素が非決定論的に振る舞うため、ソフトウェア側には極めて高い耐障害性が求められます。

この文脈において、AIが生成するコードは強力な補助となる一方で、検証なき導入はリスクを増幅させる要因にもなります。

Rustはこの問題に対して、コンパイル時に多くのリスクを排除する仕組みを持っています。

特にメモリ安全性と並行処理の安全性は、クラウド環境における代表的な障害原因を事前に封じ込める役割を果たします。

これにより、AIが生成したコードであっても、一定の安全基準を満たさなければ実行可能な状態に到達できません。

クラウド領域での典型的なユースケースとしては、APIゲートウェイ、分散ログ処理、コンテナオーケストレーション補助ツールなどが挙げられます。

これらの領域では並行処理が頻繁に発生するため、データ競合の回避が極めて重要になります。

Rustの所有権モデルは、この並行性問題をコンパイル時に制約として扱うため、実行時エラーの発生確率を大幅に低減します。

AIコード生成との関係で特に重要なのは、クラウドインフラコードが「構造的にパターン化されやすい」という点です。

多くのインフラコードはテンプレート化可能であり、AIが生成するコードと非常に相性が良い領域です。

しかしその一方で、些細な設定ミスがシステム全体の障害につながるため、生成後の検証が不可欠になります。

この点においてRustは、AI生成コードの「安全な実行可能性」を保証するフィルタとして機能します。

例えば非同期処理やスレッド間通信において、型システムが競合状態を防ぐことで、生成されたコードの品質を構造的に底上げします。

クラウド領域におけるRustとAIの関係を整理すると、次のような構造になります。

| 要素 | Rust | AIコード生成 | クラウドインフラ |

|---|---|---|---|

| 役割 | 安全性保証 | 実装速度向上 | 実行環境 |

| 強み | コンパイル時検証 | パターン生成能力 | スケーラビリティ |

| リスク抑制 | メモリ・並行性制御 | 仕様曖昧性 | 障害波及 |

さらに重要なのは、クラウド環境ではコードのライフサイクルが短く、頻繁な更新が前提となる点です。

この特性はAI生成コードの迅速な適用と非常に相性が良い一方で、品質保証のコストを増大させる要因でもあります。

Rustはこのトレードオフをコンパイル時検証によって軽減し、デプロイ前に多くの問題を排除する役割を果たします。

また近年では、クラウドネイティブなツールチェーン自体にRustが採用されるケースも増えています。

これは単なる性能理由ではなく、ツールそのものがAI生成コードと連携する前提で設計され始めていることを意味します。

つまり、インフラ層そのものが「生成されたコードを安全に扱うための基盤」へと進化しているのです。

結論として、クラウド・インフラ領域におけるRustの採用は、単なる言語選択ではなく、AI生成コード時代におけるリスク制御戦略の一部です。

Rustは生成されたコードの不確実性を吸収しつつ、システム全体の安定性を維持するための構造的な安全装置として機能しています。

バイブコーディング時代の開発ワークフロー設計と人間の役割

バイブコーディングが一般化した現在の開発環境では、従来の「設計してから実装する」という直線的なワークフローは徐々に崩れつつあります。

代わりに、自然言語による意図の提示とAIによるコード生成が往復しながら、システムが徐々に形作られていく反復的な構造が主流になりつつあります。

この変化は単なるツールの進化ではなく、ソフトウェア開発における認知プロセスそのものの再定義だと捉えるべきです。

この新しいワークフローでは、開発者の役割は「コードを書く人」から「制約と意図を設計する人」へと明確にシフトしています。

AIがコードの詳細を担う以上、人間はその前段階である問題定義と制約設計に集中する必要があります。

特に重要なのは、曖昧な要求をそのままAIに渡すのではなく、検証可能な単位まで分解する能力です。

バイブコーディング時代の典型的な開発フローを抽象化すると、次のような構造になります。

- 人間が目的と制約条件を自然言語で定義する

- AIが複数の実装候補を生成する

- コンパイラやテストが候補の妥当性を検証する

- 結果を基に人間が再度制約を調整する

この循環構造において、人間は中心的な実装者ではなく、システム全体の「意味的な安定性」を維持する役割を担います。

特にRustのような厳密な型システムを持つ言語では、この役割分担がさらに明確になります。

AIが生成したコードはあくまで仮説であり、それを現実的な制約に適合させるのは言語と人間の共同作業になります。

ここで重要なのは、ワークフロー設計そのものがソフトウェア品質に直結するという点です。

従来の開発では、品質は主にコードレビューやテストによって担保されていました。

しかしAI時代では、生成段階で既に多様な実装が存在するため、品質は「生成前の設計」に強く依存するようになります。

この変化を整理すると、人間の役割は次のように再構成されます。

| 領域 | 従来の役割 | バイブコーディング時代の役割 |

|---|---|---|

| 設計 | アーキテクト | 制約設計者 |

| 実装 | コーディング主体 | AI生成の監督 |

| 検証 | テスト設計 | 意味的妥当性の判断 |

特に注目すべきは「意味的妥当性の判断」という役割です。

AIが生成するコードは構文的には正しい場合が多いものの、そのコードが本当にシステムの意図に沿っているかどうかは別問題です。

このギャップを埋めるのが人間の重要な責務になります。

また、ワークフロー設計においてはフィードバックループの設計が極めて重要です。

AIの出力をそのまま受け入れるのではなく、コンパイラエラーやテスト結果を再入力として利用することで、生成プロセスを逐次改善していく構造が求められます。

この点でRustのようなコンパイル時検証を持つ言語は、自然なフィードバック源として機能します。

さらに現実的な観点では、開発速度と品質のバランスをどのように取るかが課題になります。

AIによって速度は飛躍的に向上しますが、その分レビュー対象のコード量も増加します。

そのため人間は「すべてを見る」のではなく、「見るべきポイントを設計する」必要があります。

結論として、バイブコーディング時代の開発ワークフローは、単なる効率化ではなく構造的な役割再編です。

人間はコードの生産者ではなく、意味と制約の設計者として機能し、AIとコンパイラの間に位置する調停者としての役割を担うことになります。

この構造を理解することが、今後のソフトウェア開発において本質的に重要になります。

まとめ:AI生成コード時代におけるRustの立ち位置

AIによるコード生成が開発プロセスの中心に入り込んだ現在、ソフトウェアエンジニアリングの前提そのものが静かに書き換えられています。

かつては「人間が正しく書くこと」が品質の中心でしたが、今では「不確実な生成物をいかに安全に受け入れるか」が本質的な課題になっています。

この変化の中でRustは、単なる高性能言語という枠を超え、AI時代の不確実性を制御するための構造的な基盤として再評価されています。

これまでの議論を整理すると、AI生成コードには明確な特性があります。

それは高速に多様な実装案を提示できる一方で、その正しさや安全性は保証されないという点です。

この性質は開発速度を劇的に向上させる反面、システムの安定性を脅かす要因にもなります。

特に大規模なシステムやクラウドインフラのように影響範囲が広い領域では、この不確実性は無視できないリスクになります。

Rustはこの問題に対して、コンパイル時検証という明確な防御層を提供します。

所有権、借用、型システムといった仕組みにより、実行前の段階で多くの潜在的なバグを排除します。

これは単なる安全機能ではなく、「AIが生成したコードをどのように扱うべきか」という設計思想そのものに関わる構造です。

特に重要なのは、Rustが「正しいコードを書くこと」を前提にしていない点です。

むしろ「誤りを含む可能性のあるコードが常に入力される」という前提に立ち、その上で安全性を保証するよう設計されています。

この考え方は、生成AI時代の現実と非常に一致しています。

また、RustはAIとの相互作用においても独特の位置を占めています。

AIが生成したコードはしばしば曖昧な意図や不完全な設計を含みますが、Rustのコンパイラはそれを形式的なエラーとして明示的に可視化します。

このフィードバックは単なるエラーではなく、次の生成サイクルへの入力として機能し、結果としてAIとコンパイラの間に閉じた改善ループを形成します。

ここで改めて整理すると、AI生成コード時代における各要素の役割は次のように位置付けられます。

| 要素 | 役割 | 特性 |

|---|---|---|

| AI | コード生成 | 高速・非決定論的 |

| Rust | 構造的検証 | 厳密・制約ベース |

| 人間 | 意図設計 | 抽象・判断主体 |

この三者構造において、Rustは単なる実装言語ではなく「制約の実行装置」として機能しています。

AIが生み出す多様な可能性を、実行可能な形に収束させる役割を担っていると言えます。

さらに重要なのは、Rustの役割が今後「防御的な言語」から「生成的な不確実性を前提とした言語」へと拡張されていく可能性です。

これは、AIが生成するコードが前提となる環境において、言語そのものがリスク制御機構として再定義されることを意味します。

結論として、AI生成コード時代におけるRustの立ち位置は明確です。

それは「人間が書くコードの品質を保証する言語」ではなく、「AIが生成する不確実なコードを安全に実行可能な形へ変換するための構造的フィルタ」です。

この役割こそが、今後のソフトウェア開発におけるRustの本質的な価値になると考えられます。

コメント