「昨日まで動いてたのに、今日はなぜか動かない」。

開発現場でも学習中の個人開発でも、何度も繰り返される典型的なトラブルです。

コードを変更していないのにエラーが出る場合、その原因はアプリ本体ではなく、実行環境の変化にあることが少なくありません。

たとえばライブラリの自動更新、Python本体のバージョン差異、OS依存の挙動、別プロジェクトで行った設定変更などが、静かに動作条件を変えてしまいます。

ソフトウェアはソースコードだけで成立しているわけではありません。

コードが依存するパッケージ群、実行するインタプリタ、環境変数、ツールチェーンまで含めて、はじめて同じ結果を再現できます。

つまり「動くコード」を維持するには、「動く環境」を管理しなければならないということです。

そこで有効なのが仮想環境です。

仮想環境を使えば、プロジェクトごとに依存関係を分離し、他の開発作業の影響を受けにくくできます。

さらに、使用しているパッケージのバージョンを記録しておけば、別のPCや将来の自分の環境でも、同じ構成を再現しやすくなります。

本記事では、なぜ環境差分が不具合を生むのかを整理したうえで、仮想環境が再現性の確保にどう役立つのかを、実務でも通用する視点でわかりやすく解説します。

場当たり的にエラーへ対処するのではなく、壊れにくい開発基盤を作る考え方として理解していきましょう。

- 「昨日まで動いてたのに…」が起きる原因とは?環境差分と再現性の基本

- 仮想環境とは?Python開発で再現性を高める仕組みをわかりやすく解説

- Python venvの使い方入門:作成・有効化・削除までの基本手順

- requirements.txtで依存関係を固定し、チーム開発の再現性を上げる方法

- Poetry・uv・pipenv比較:仮想環境ツールはどれを選ぶべきか

- Dockerとの違いは?仮想環境とコンテナを使い分ける判断基準

- VSCode・GitHub連携で効率化する仮想環境運用の実践テクニック

- 仮想環境でよくあるエラー集:activateできない・パッケージが見つからない時の対処法

- まとめ:仮想環境を習慣化すれば「昨日まで動いてたのに…」は防げる

「昨日まで動いてたのに…」が起きる原因とは?環境差分と再現性の基本

開発中に「昨日までは正常に動いていたのに、今日は同じコードで失敗する」という現象は珍しくありません。

直感的にはソースコードだけが動作を決めているように見えますが、実際のソフトウェアはコード単体では成立しません。

プログラムは、実行する言語処理系、外部ライブラリ、OS、環境変数、ファイル配置、文字コード、ネットワーク状態など、多数の要素の上に成り立っています。

したがって、コードが一文字も変わっていなくても、それ以外の条件が変化すれば結果も変わり得ます。

この問題を理解するうえで重要なのが、再現性という考え方です。

再現性とは、いつ、どこで、誰が実行しても、同じ条件なら同じ結果になる性質を指します。

開発効率の高い現場ほど、個人の勘や偶然に依存せず、環境まで含めて再現可能な状態を整えています。

逆に言えば、再現性が低い環境では、不具合の原因調査にも余計な時間がかかります。

たとえば、ある開発者のPCでは成功し、別のPCでは失敗する場合、コードレビューだけでは問題を特定できません。

環境差分を比較しなければならず、調査コストは一気に増大します。

これは個人開発でも同様で、数週間後に過去プロジェクトを開いたとき、当時と同じ環境がなければ再開に時間を奪われます。

ソースコードが同じでも結果が変わる理由

ソースコードが同一でも結果が変わる主因は、プログラムの実行時に参照される外部要素が固定されていないためです。

たとえばPythonであれば、同じ app.py でも、Python 3.10 と 3.12 では文法や標準ライブラリの挙動差が影響する場合があります。

さらに、利用しているライブラリの内部仕様が変われば、呼び出し側のコードがそのままでも例外が発生します。

簡単な例を挙げると、依存パッケージが自動更新され、戻り値の形式が変更されたケースです。

呼び出し元は昨日と同じ処理を書いていても、受け取るデータ構造が変わればエラーになります。

これはコードの誤りというより、前提条件の変化です。

以下のように、同じコードでも周辺条件が異なれば結果は一致しません。

| 要素 | 昨日 | 今日 | 影響 |

|---|---|---|---|

| Python本体 | 3.11 | 3.12 | 一部挙動の差異 |

| requests | 旧版 | 新版 | API仕様変更 |

| 環境変数 | 設定あり | 未設定 | 認証失敗 |

| 実行OS | macOS | Windows | パス処理差異 |

このように、プログラムの出力は「コードだけの関数」ではなく、「コード × 実行環境」の結果です。

ここを見落とすと、原因分析が感覚的になり、再発防止もできません。

ライブラリ更新・OS変更・設定差分が招く不具合

実務で特に多いのは、依存ライブラリの更新による不具合です。

パッケージ管理ツールは便利ですが、バージョンを明示的に固定していない場合、再インストール時に最新版が入ることがあります。

最新版が常に互換性を保つとは限らず、非推奨機能の削除や既定値の変更によって既存コードが壊れることがあります。

OS変更も典型例です。

WindowsとLinuxでは改行コード、ファイルパス区切り、権限管理の仕組みが異なります。

macOSでは動いたスクリプトが、Linuxサーバーでは権限不足で失敗することもあります。

これは環境依存の処理を吸収できていないために起きます。

設定差分も見逃せません。

たとえば .env に保存していたAPIキーが別環境に存在しない、PATH設定が異なりコマンドを認識しない、文字コード設定が異なって日本語が文字化けする、といった問題です。

これらはエラーメッセージだけでは本質が見えにくく、初学者ほど苦戦しやすい領域です。

論理的に対処するには、まず「コードが悪い」と決めつけず、環境要因を切り分ける姿勢が重要です。

使用言語のバージョン、依存パッケージ一覧、OS情報、環境変数、設定ファイルの差分を順に確認すれば、多くの問題は説明可能です。

そして、その確認作業を毎回手作業で行わないために、仮想環境や依存関係の固定が必要になります。

再現性の確保とは、トラブル対応を楽にするための保険ではなく、安定した開発を継続するための基盤設計そのものです。

仮想環境とは?Python開発で再現性を高める仕組みをわかりやすく解説

Python開発で再現性を確保したいなら、最初に理解すべき概念が仮想環境です。

仮想環境とは、1台のPCの中に、プロジェクト専用のPython実行環境を個別に作る仕組みを指します。

OSそのものを仮想化する大掛かりな技術ではなく、Python本体やインストール済みパッケージの参照先を分離する、軽量で実用的な方法です。

多くの不具合は、コードの誤りよりも「どの環境で動かしたか」の違いから発生します。

ある案件では古いライブラリが必要で、別の案件では新しいバージョンが必要になることは珍しくありません。

もし1つの共通環境しか使えなければ、片方を更新した瞬間にもう片方が壊れる可能性があります。

仮想環境は、この衝突を避けるための設計です。

技術的には、仮想環境ごとに専用の site-packages や実行パスが用意されます。

コマンドを実行したとき、そのプロジェクト専用のPythonとパッケージ群が優先的に使われるため、他の作業領域へ影響を与えません。

結果として、昨日動いた構成を今日も維持しやすくなります。

グローバル環境と仮想環境の違い

まず、グローバル環境とは、PC全体で共有されるPython環境です。

pip install を何も考えずに実行すると、この共有領域へパッケージが入ることがあります。

一見便利ですが、複数プロジェクトを並行して扱うと問題が顕在化します。

A案件で必要なライブラリ更新が、B案件の互換性を壊すからです。

一方、仮想環境はプロジェクト単位で独立しています。

たとえばECサイト開発用の環境と、機械学習検証用の環境を別々に持てます。

片方で大幅なアップデートをしても、もう片方には影響しません。

これは共有フォルダに全ファイルを置くのではなく、案件ごとに専用フォルダを分ける感覚に近いものです。

違いを整理すると、次のようになります。

| 項目 | グローバル環境 | 仮想環境 |

|---|---|---|

| 利用範囲 | PC全体で共有 | プロジェクト単位 |

| 依存関係の衝突 | 起きやすい | 起きにくい |

| 再現性 | 低くなりやすい | 高めやすい |

| 保守性 | 長期運用で低下しやすい | 管理しやすい |

初学者の段階では差が見えにくいかもしれません。

しかし、開発対象が2つ、3つと増えた瞬間に、この構造差は大きな生産性の差になります。

プロジェクトごとに依存関係を分離するメリット

依存関係を分離する最大の利点は、変更の影響範囲を限定できることです。

ソフトウェア開発では、問題の切り分けが速いほど品質も速度も向上します。

仮想環境を使えば、ある不具合が発生したとき「このプロジェクト内部の変更か、それとも外部要因か」を判断しやすくなります。

また、チーム開発でも効果的です。

新しいメンバーが参加した際、同じPythonバージョンと同じパッケージ群を用意すれば、既存メンバーと近い状態で作業を始められます。

環境構築で数時間失う現場は少なくありませんが、仮想環境を前提にしていればその損失を抑えられます。

将来の自分を助ける点も重要です。

数か月前に作ったツールを再び開くと、当時の依存ライブラリを忘れていることはよくあります。

仮想環境が残っていれば、当時の実行条件をたどりやすく、調査時間を短縮できます。

これは知識量の問題ではなく、状態管理の問題です。

実際の作業では、プロジェクトディレクトリごとに環境を作成し、その中でパッケージを導入するだけです。

python -m venv .venv

source .venv/bin/activate

pip install requests

この数行で、共有環境を汚さずに専用の開発領域を持てます。

仮想環境は高度なテクニックではありません。

むしろ、再現性を前提にしたPython開発における標準的な基礎習慣です。

コードを書く技術と同じくらい、コードを安定して動かす環境設計にも価値があります。

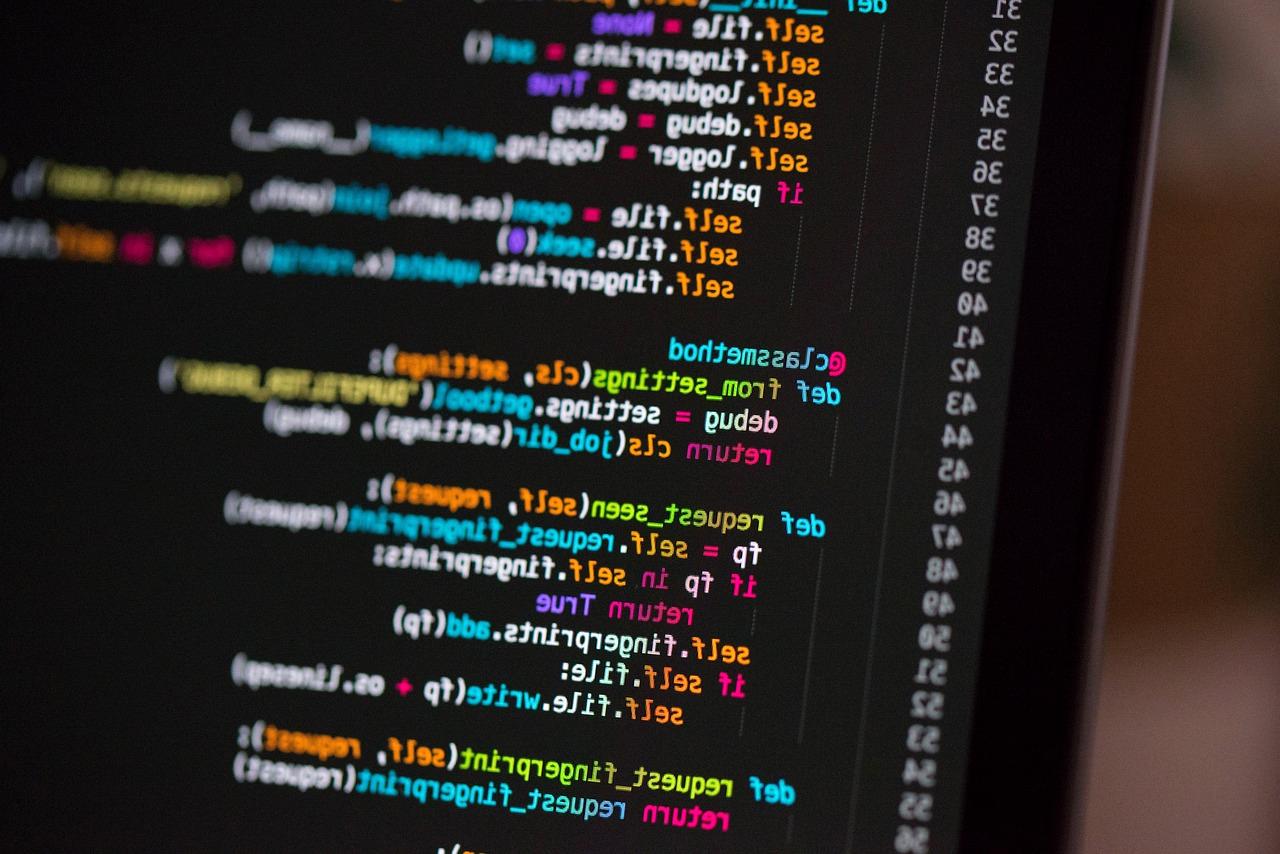

Python venvの使い方入門:作成・有効化・削除までの基本手順

Pythonで仮想環境を実際に運用するうえで、最も基本となる標準機能が venv です。

追加ツールを導入しなくても、Python本体に同梱されているため、学習用途から実務まで幅広く利用されています。

仕組みを理解せずにコマンドだけ覚えることもできますが、長期的には「何が作られ、何が切り替わっているのか」を把握しておくほうが確実です。

venv の役割は、プロジェクト専用のPython実行領域を作ることです。

そこには専用の実行ファイル、パッケージ保存先、設定情報が含まれます。

以後、その環境を有効化している間は、PC全体の共有環境ではなく、そのプロジェクト専用のPythonが使われます。

つまり、同じ pip install という操作でも、どの環境で実行したかによって影響範囲が変わります。

この点を理解していないと、「インストールしたはずのライブラリが見つからない」「別案件まで更新されてしまった」といった混乱が起こります。

逆に言えば、作成、有効化、終了、削除の流れを正しく押さえるだけで、多くの環境トラブルは予防できます。

venv作成コマンドとディレクトリ構成

仮想環境の作成は非常にシンプルです。

対象プロジェクトのディレクトリへ移動し、次のコマンドを実行します。

python -m venv .venv

ここで .venv は作成される仮想環境フォルダ名です。

名前は任意ですが、プロジェクト直下に .venv とする運用は広く使われています。

エディタや各種ツールが自動認識しやすく、隠しフォルダとして扱いやすいからです。

作成後には、内部に複数のファイルとフォルダが生成されます。

OSにより細部は異なりますが、概念的には次のような構成です。

| フォルダ/ファイル | 役割 | 補足 |

|---|---|---|

bin または Scripts |

Python実行ファイルや起動用コマンド | OSごとに名称が異なる |

lib |

インストール済みパッケージ群 | 実体の保存先 |

pyvenv.cfg |

仮想環境の設定情報 | ベースPythonの情報を保持 |

重要なのは、この中に「その環境専用のPython」が存在する点です。

普段ターミナルで python と入力したとき、常に同じPythonが起動しているわけではありません。

有効化状態によって参照先が変わります。

これが仮想環境の本質です。

また、仮想環境フォルダ自体は再生成可能です。

ソースコード本体ではないため、通常はGit管理の対象から除外します。

環境は作り直せる状態にし、コードと依存情報を別で管理するのが合理的です。

activateとdeactivateの使い分け

仮想環境を作っただけでは、自動的には使われません。

明示的に有効化して、現在のシェルがその環境を使うよう切り替える必要があります。

代表例は次のとおりです。

# macOS / Linux

source .venv/bin/activate

# Windows

.venv\Scripts\activate

有効化されると、ターミナルの先頭に (.venv) のような表示が付きます。

これは見た目の変化にすぎませんが、実際にはPATHが一時的に変更され、仮想環境内の python や pip が優先される状態になっています。

以後のインストールや実行は、その環境に対して行われます。

この状態で pip install flask を実行すれば、共有環境ではなく .venv 内へFlaskが入ります。

プロジェクト専用の依存関係として管理されるため、他案件へ影響しません。

ここがactivateの実務的価値です。

作業が終わったら、環境を終了します。

deactivate

これによりシェル設定が元へ戻り、共有環境へ復帰します。

activateとdeactivateは、単なる開始・終了コマンドではなく、「今どの文脈で操作しているか」を切り替えるスイッチです。

この意識があると、誤った環境へのインストールや実行を避けやすくなります。

なお、仮想環境の削除は特別なコマンドを必要としません。

フォルダごと削除すれば完了です。

なぜなら、仮想環境は再生成可能な作業領域だからです。

壊れたら直すのではなく、作り直せるようにしておく。

この発想こそが、再現性を重視する開発スタイルの基本です。

requirements.txtで依存関係を固定し、チーム開発の再現性を上げる方法

仮想環境を用意しただけでは、再現性はまだ完成しません。

なぜなら、環境の「入れ物」を分離しただけで、中に何のパッケージを、どのバージョンで入れていたかまでは共有されていないからです。

そこで必要になるのが requirements.txt です。

これはPythonプロジェクトで利用する依存ライブラリ一覧を記録し、他者や将来の自分が同じ構成を再現できるようにするためのファイルです。

実務では、コードそのものより環境差分が原因で作業が止まる場面が少なくありません。

開発者AのPCでは正常に起動するのに、開発者BのPCではエラーになるケースです。

その多くは、ライブラリのバージョン違い、導入漏れ、間接依存の差異に起因します。

requirements.txt は、こうした不確実性を減らすための仕様書として機能します。

重要なのは、ライブラリ名だけでなくバージョンまで固定することです。

同じFlaskでも、2系と3系では挙動や依存関係が変わることがあります。

曖昧な指定は、環境再現の観点では不十分です。

開発時点で動作確認した組み合わせを明示しておくことで、他環境でも同じ前提条件を用意しやすくなります。

pip freezeで現在の環境を保存する

現在の仮想環境に入っているパッケージ一覧を保存する最も一般的な方法が pip freeze です。

仮想環境を有効化した状態で次のコマンドを実行します。

pip freeze > requirements.txt

これにより、インストール済みパッケージとそのバージョンが requirements.txt に出力されます。

たとえば、次のような内容になります。

Flask==3.0.2

requests==2.31.0

python-dotenv==1.0.1

このファイルの価値は、単なるメモではありません。

環境の状態を機械的に復元できる点にあります。

人間が「requestsはたしか2系だった」と記憶に頼る運用は、時間が経つほど破綻します。

状態は記録し、再利用できる形式で残すべきです。

ただし、pip freeze は仮想環境内の全パッケージを出力するため、直接使っていない間接依存まで含まれることがあります。

小規模プロジェクトでは問題ありませんが、長期運用では必要パッケージを整理する判断も重要です。

とはいえ、まずは正確に保存することが優先です。

最初の一歩として pip freeze は非常に実用的です。

別PCで同じ環境を再構築する手順

保存した requirements.txt は、別のPCや新しい開発メンバーの環境構築で真価を発揮します。

手順は難しくありません。

新しい環境で仮想環境を作成し、その中へ依存関係を一括導入するだけです。

python -m venv .venv

source .venv/bin/activate

pip install -r requirements.txt

この3ステップで、元の開発環境に近い状態を再現できます。

もし requirements.txt がなければ、必要ライブラリを一つずつ調べて導入し、バージョン差異と戦うことになります。

時間効率の差は明白です。

特にチーム開発では、参加者ごとにPC環境が異なります。

Windows、macOS、Linuxが混在することも珍しくありません。

その中で共通の実行条件を持たせるには、コードだけでなく依存関係の定義ファイルが必要です。

再構築時に意識したい確認点は次のとおりです。

- 仮想環境を有効化してからインストールしているか

- Python本体のバージョンが大きく違わないか

- OS依存の追加設定がREADMEなどに整理されているか

また、CI環境やデプロイ先サーバーでも同じ考え方が使えます。

自動テスト環境で pip install -r requirements.txt を実行すれば、ローカルと近い条件で検証できます。

これは品質保証の観点でも重要です。

requirements.txt は地味なファイルに見えますが、実際には開発体験を大きく左右します。

ソースコードだけ共有しても、動かなければ価値は限定的です。

環境まで含めて共有してこそ、チーム開発の速度と安定性は高まります。

再現性とは高度な理論ではなく、こうした基本的な記録と手順の積み重ねです。

Poetry・uv・pipenv比較:仮想環境ツールはどれを選ぶべきか

Pythonの仮想環境を学び始めると、やがて venv 以外の選択肢にも出会います。

代表的なものが Poetry、uv、pipenv です。

いずれも依存関係の管理、仮想環境の作成、再現性の向上を目的としたツールですが、思想と得意分野は同じではありません。

どれを選んでもPythonは書けますが、運用コストや開発体験には明確な差が生まれます。

まず前提として、ツール選定に唯一の正解はありません。

個人学習、少人数開発、長期保守、CI連携、配布パッケージ作成など、目的が違えば最適解も変わります。

重要なのは、流行しているから選ぶのではなく、自分の要件に対して合理的かどうかで判断することです。

Poetryは、依存関係管理とパッケージ公開まで一体的に扱いやすい設計です。

設定は pyproject.toml に集約され、構成が整理しやすい点が強みです。

ライブラリ開発や中規模以上のプロジェクトで評価されやすく、チームで規律ある運用をしたい場合に向いています。

uvは比較的新しい選択肢ですが、非常に高速なパッケージ管理で注目されています。

環境構築やインストール速度は日々の反復作業に直結するため、開発回数が多い現場ほど恩恵があります。

速度面の優位性は、単なる快適さではなく待機時間の削減です。

pipenvは、pip と virtualenv を統合的に扱う発想で広まりました。

学習コストは比較的低く、従来の requirements.txt ベースの文化から移行しやすい側面があります。

一方で、近年はPoetryやuvを選ぶケースも増え、相対的に検討対象として比較される立場になっています。

全体像を整理すると、次のように捉えられます。

| ツール | 主な特徴 | 向いている場面 |

|---|---|---|

| Poetry | 構成管理が明快、配布にも強い | チーム開発、ライブラリ開発 |

| uv | 高速、軽快、現代的 | 頻繁な構築、効率重視 |

| pipenv | 直感的、従来文化と親和性 | 学習用途、小規模案件 |

この表は絶対評価ではなく、選定の出発点です。

どのツールにも更新状況や周辺エコシステムの変化があります。

したがって、現在の用途に照らして判断する姿勢が重要です。

初学者に向くツールと実務向けツールの違い

初学者にとって最優先なのは、仮想環境の本質を理解することです。

依存関係とは何か、なぜ分離するのか、環境を固定すると何が解決するのか。

この基礎を飛ばして高機能ツールへ進むと、エラー時に内部で何が起きているか判断しづらくなります。

そのため、学習初期は venv あるいは概念が追いやすいツールから始めるのが合理的です。

たとえば、初学者がいきなり複雑な設定ファイルやロック機構に触れると、問題が「Pythonの理解不足」なのか「ツール固有の仕様」なのか切り分けにくくなります。

学習効率の観点では、抽象化レイヤーは段階的に増やすべきです。

一方、実務では個人の理解しやすさだけでなく、再現性、速度、保守性、共同作業のしやすさが重視されます。

開発者が5人いれば、5人全員の環境構築時間がコストになります。

CIで毎回依存関係を解決するなら、インストール速度も無視できません。

設定の一貫性やロックファイルの信頼性も重要です。

たとえば、Poetryは設定と依存関係管理を統一しやすく、長期案件で強みがあります。

uvは高速なセットアップにより、コンテナ再作成やCIの待ち時間短縮で効果を発揮しやすいでしょう。

pipenvは既存の運用文化に合わせやすい場面があります。

結論として、初学者には「理解しやすさ」、実務には「運用全体の最適化」という評価軸があります。

学ぶ段階で使う道具と、組織で成果を出す道具は必ずしも一致しません。

大切なのは、ツール名で優劣を語ることではなく、どの課題を解決したいのかを明確にすることです。

その視点があれば、Poetry・uv・pipenvのどれを選んでも、判断に一貫性が生まれます。

Dockerとの違いは?仮想環境とコンテナを使い分ける判断基準

Pythonの仮想環境を学ぶと、次にしばしば比較対象として挙がるのがDockerです。

どちらも「環境を分ける」ための技術として語られますが、解決している問題の階層は同一ではありません。

仮想環境は主にPython実行環境と依存パッケージを分離する仕組みであり、Dockerはアプリケーションが動くOSレベルの実行環境まで含めてパッケージ化する仕組みです。

似て見えても、守備範囲が異なります。

仮想環境が扱う中心は、どのPythonを使い、どのライブラリを入れるかです。

一方でDockerは、Pythonのバージョンだけでなく、Linuxディストリビューション、システムライブラリ、ミドルウェア、起動コマンドまで定義できます。

つまり、仮想環境は言語レイヤーの再現性、Dockerはシステムレイヤーを含む再現性に強いという整理が適切です。

ただし、範囲が広い技術ほど常に優れているわけではありません。

Dockerには学習コスト、設定ファイル管理、イメージビルド時間、ストレージ消費といった運用負荷があります。

必要十分な手段を選ぶことが、技術選定では重要です。

小さな問題に対して大きすぎる道具を持ち込むと、管理対象だけが増えます。

仮想環境で十分なケース

ローカルでPythonアプリを開発し、依存パッケージの衝突だけ避けたい場合は、仮想環境で十分なことが多いです。

たとえば学習用スクリプト、社内ツール、個人開発のWebアプリ、データ分析用ノートブックなどです。

こうした用途では、OS差異まで厳密に固定しなくても、Pythonとライブラリの管理だけで実用上の問題はかなり解消されます。

仮想環境の利点は軽さです。

作成は数秒で終わり、削除もフォルダを消すだけです。

起動のたびにコンテナを立ち上げる必要もなく、ターミナルで即座に作業へ入れます。

試行回数が多い日常開発では、この軽快さが生産性に直結します。

たとえば次のような条件なら、まず仮想環境を選ぶ判断は合理的です。

| 条件 | 仮想環境との相性 | 理由 |

|---|---|---|

| 個人開発 | 高い | 構成が単純で管理しやすい |

| 学習用途 | 高い | 仕組みを理解しやすい |

| Python中心の処理 | 高い | 依存管理だけで足りることが多い |

| 小規模チーム | 比較的高い | 導入負荷が低い |

重要なのは、将来Dockerへ移行できる余地を残しつつ、現時点で過剰設計しないことです。

技術選定は見栄ではなく、コストと効果の比較で決めるべきです。

Dockerが有効なケース

一方で、仮想環境だけでは不足する場面もあります。

代表例は、開発環境と本番環境の差異が障害要因になりやすいケースです。

ローカルはmacOS、本番はLinux、さらにNginxやPostgreSQLも必要、といった構成ではPythonの依存管理だけでは再現性が不十分です。

OSや周辺サービスまでまとめて揃える必要があります。

Dockerでは、Dockerfile に環境構築手順を記述し、誰がどこで実行しても同じイメージを起動できます。

これは「手順書」より強力です。

手順書は人間が解釈しますが、Dockerfileは機械がそのまま実行します。

再現性の観点では、解釈の余地が少ないほど安定します。

また、複数サービスを同時に扱う構成でもDockerは有効です。

Webアプリ、DB、キャッシュサーバーを別コンテナで動かせば、ローカルでも本番に近い検証ができます。

CI/CDとの相性もよく、同じコンテナでテストからデプロイまで流せる点は大きな利点です。

ただし、Docker導入で自動的にすべて解決するわけではありません。

ネットワーク設定、ボリューム管理、イメージ最適化など、新たな知識も必要です。

したがって、問題がPython依存関係に限定されるなら仮想環境、OSや周辺サービスまで含めて統一したいならDocker、と切り分けるのが現実的です。

結論として、両者は競合ではなく補完関係です。

ローカル開発では仮想環境、本番に近い検証や配布にはDockerという併用も自然です。

重要なのは「どちらが上か」ではなく、「どのレイヤーの差分を消したいのか」を明確にすることです。

その問いに答えられれば、選択はかなり論理的になります。

VSCode・GitHub連携で効率化する仮想環境運用の実践テクニック

仮想環境は作成しただけでは価値を最大化できません。

実務では、エディタ、バージョン管理、レビュー運用と接続してはじめて効果が安定します。

とくにVSCodeとGitHubを組み合わせると、ローカル作業の快適さとチーム共有の再現性を同時に高められます。

個人のPCでは動くのに、プルリクエスト後のCIで失敗する、といった典型的な事故も減らしやすくなります。

多くの開発トラブルは、難解なアルゴリズムではなく「どのPythonで実行したか」「何をGitへ含めたか」という運用上の差異から生まれます。

つまり、日々の設定を標準化することは、コード品質そのものに直結します。

優れた開発者ほど、手作業で頑張るのではなく、ミスしにくい仕組みを先に整えます。

VSCodeはPython拡張機能との連携により、仮想環境の認識、補完、Lint、デバッグまで一貫して扱えます。

GitHubは変更履歴の共有だけでなく、環境定義ファイルや設定ファイルをチームの共通知識として残す場所になります。

この2つを適切に使えば、属人的な「自分のPCだけ特別設定」を減らせます。

エディタでインタプリタを固定する設定

仮想環境運用で最初に行うべきことは、VSCodeがどのPythonを使うか明示することです。

ターミナルで仮想環境を有効化していても、エディタ内部の実行設定が別のPythonを向いていれば、補完結果や実行結果が食い違います。

これは初学者が非常につまずきやすい点です。

たとえば、ターミナルでは .venv を使っているのに、VSCodeのRunボタンではグローバル環境が使われるとします。

その場合、ターミナルでは成功し、エディタ実行では ModuleNotFoundError が出ることがあります。

原因はコードではなく、参照しているインタプリタの不一致です。

VSCodeではコマンドパレットからPythonインタプリタを選択し、プロジェクト内の .venv を指定できます。

すると補完、型チェック、デバッグ実行もその環境を前提に動作しやすくなります。

結果として、開発体験と再現性の両方が改善します。

設定の意味を整理すると、次のようになります。

| 項目 | 未設定時の問題 | 固定した場合の効果 |

|---|---|---|

| 実行環境 | 別Pythonが使われる | 実行結果が安定する |

| 補完候補 | 未導入パッケージが混在 | 現在環境に一致する |

| デバッグ | ローカル差異が出やすい | 調査しやすい |

また、.vscode/settings.json に設定を保存すれば、同じプロジェクトを開く他メンバーにも意図が伝わります。

毎回口頭で説明するより、設定として残すほうがはるかに信頼できます。

Git管理で不要ファイルを除外するポイント

仮想環境そのものをGitへコミットする必要は通常ありません。

理由は明確で、仮想環境は生成物だからです。

数千のファイルを含む環境一式をリポジトリへ入れると、容量が肥大化し、差分確認も困難になります。

さらに、OSごとの差異を含むため、他メンバーにとって不要なノイズにもなります。

Gitで管理すべきなのは、再生成に必要な情報です。

具体的にはソースコード、requirements.txt、pyproject.toml、必要な設定ファイルなどです。

環境本体ではなく、環境を作るための定義を追跡するという発想が重要です。

そのため、.gitignore に仮想環境フォルダを追加します。

.venv/

venv/

__pycache__/

*.pyc

これにより、不要な生成物が誤ってコミットされる事故を防げます。

レビュー時にも本質的なコード変更だけへ集中しやすくなります。

GitHub上で差分が見やすいことは、開発速度だけでなく品質にも影響します。

また、機密情報の混入防止にも注意が必要です。

.env にAPIキーを保存しているなら、それもGit管理から除外すべきです。

仮想環境運用とGit運用は別テーマに見えて、実際には密接に関係しています。

環境をどう再現するか、何を共有し、何を共有しないかという設計思想が共通だからです。

結局のところ、VSCodeとGitHubの連携で重要なのは便利機能の多さではありません。

人間の注意力に頼らず、正しい環境を選び、不要なものを混ぜず、必要な情報だけを残すことです。

その仕組み化こそが、継続的に強い開発体制を作ります。

仮想環境でよくあるエラー集:activateできない・パッケージが見つからない時の対処法

仮想環境は再現性を高める有効な仕組みですが、導入直後は特有のエラーに遭遇しやすいものです。

代表例が「activateできない」「インストールしたはずのパッケージが見つからない」「昨日まで動いた環境で突然失敗する」といった問題です。

こうした場面で重要なのは、焦ってコマンドを乱発することではなく、原因候補を体系的に切り分ける姿勢です。

多くのトラブルは、仮想環境そのものが壊れているわけではありません。

実際には、現在のシェルが正しいPythonを参照していない、実行権限が不足している、別環境へインストールしている、キャッシュされた古い状態が残っている、といった周辺要因で説明できます。

つまり、エラー文面だけを見るのではなく、「今どの環境を使っているか」を確認することが出発点になります。

プログラミング経験が浅い時期ほど、エラーを特別な現象と捉えがちです。

しかし多くの場合、原因は有限で、観測可能です。

パス、権限、インストール先、キャッシュ。

この4領域を順に確認するだけで、かなりの割合の問題は整理できます。

パス設定と権限エラーの確認方法

activateできない場合、最初に疑うべきはパスの誤りです。

仮想環境の起動スクリプトは、OSごとに場所と呼び出し方が異なります。

macOSやLinuxでは bin/activate、Windowsでは Scripts\activate を使うのが一般的です。

フォルダ構成を確認せずに別OS向けのコマンドを実行すると、当然ながら見つかりません。

たとえば、現在のPython参照先を確認するだけでも有益です。

which python

# Windowsなら

where python

ここで .venv 配下の実行ファイルが表示されなければ、仮想環境は有効化されていません。

逆に、システム全体のPythonが表示されるなら、別環境で作業していることになります。

権限エラーも典型例です。

とくにWindowsではPowerShellの実行ポリシーにより、activateスクリプトがブロックされることがあります。

LinuxやmacOSでは、ファイル実行権限や所有者設定が影響することがあります。

これはPythonの問題ではなく、OSのセキュリティ制御です。

確認の優先順位を整理すると、次のようになります。

| 確認項目 | 典型症状 | 着眼点 |

|---|---|---|

| パス | activateが見つからない | フォルダ位置が正しいか |

| 実行先 | パッケージ未認識 | どのPythonを使っているか |

| 権限 | 実行拒否される | OS設定や権限不足 |

| シェル種別 | コマンド差異 | bash / zsh / PowerShell |

このように、現象を抽象化して分類すると、感覚ではなく手順で解決できます。

キャッシュ削除と再インストールの判断基準

パッケージが見つからない、あるいはインストール済みなのに不自然な挙動をする場合、キャッシュや中途半端なインストール状態が原因になることがあります。

pip はダウンロード済みパッケージをキャッシュするため、通常は高速化に役立ちます。

しかし、破損ファイルや古い依存解決結果が残ると、問題の温床になる場合があります。

その際は、まず現在の環境で本当に対象パッケージが入っているか確認します。

pip list

pip show requests

ここで表示されないなら、そもそも別環境へインストールしている可能性があります。

表示されるのに import できないなら、Python実行先と pip 実行先の不一致が疑われます。

キャッシュ起因が疑わしい場合は、キャッシュを使わず再インストールする方法があります。

pip install --no-cache-dir -r requirements.txt

それでも改善しない場合、仮想環境を作り直す判断は合理的です。

仮想環境は修復前提ではなく、再生成しやすい設計だからです。

フォルダを削除し、再度 python -m venv .venv からやり直すほうが、長時間調査するより速いことも少なくありません。

重要なのは、「いつ作り直すか」を感情で決めないことです。

パス確認、実行先確認、インストール状態確認、キャッシュ回避を試しても不整合が残るなら、再作成コストと調査コストを比較します。

環境は資産である一方、再現可能なら消耗品でもあります。

仮想環境のエラー対応で身につけたいのは、個別コマンドの暗記ではなく、状態を観測して仮説検証する習慣です。

その視点があれば、未知のエラーに遭遇しても応用が利きます。

技術力とは、トラブルゼロの状態ではなく、トラブルを構造的に処理できる能力です。

まとめ:仮想環境を習慣化すれば「昨日まで動いてたのに…」は防げる

「昨日まで動いてたのに、今日は動かない」という問題は、開発者であれば誰でも一度は経験します。

そして厄介なのは、エラーメッセージそのものより、原因が見えにくい点です。

コードを変えていないにもかかわらず失敗するため、直感に反し、対処が場当たり的になりやすいのです。

しかし本記事で見てきたように、多くの場合の本質はコードの変化ではなく、実行環境の変化にあります。

ソフトウェアは、ソースコードだけで完結する成果物ではありません。

Python本体のバージョン、依存ライブラリ、OS、環境変数、エディタ設定、実行パスなど、複数の前提条件の上で動作します。

したがって、安定して動くプログラムを作るには、コードを書く技術と同時に、そのコードが置かれる環境を管理する技術が必要です。

仮想環境は、まさにそのための現実的で効果的な手段です。

仮想環境の価値は、単にライブラリを隔離することではありません。

変更の影響範囲を限定し、問題発生時の切り分けを容易にし、別PCや将来の自分の環境でも同じ状態を再現しやすくすることにあります。

これは開発効率だけでなく、心理的負担の軽減にもつながります。

毎回「今回は動くだろうか」と不安を抱えながら作業するより、再現可能な基盤の上で開発するほうが集中力は維持されます。

また、仮想環境は個人開発者だけの道具ではありません。

チーム開発ではさらに重要性が増します。

複数人が同じリポジトリを扱う以上、各自のPC環境差分はそのまま不具合の温床になります。

requirements.txt や pyproject.toml などの定義ファイルと組み合わせれば、誰が参加しても近い条件で作業を始められます。

属人的な「自分のPCだけ動く状態」から脱却できる点は、組織的な開発において極めて大きな意味を持ちます。

さらに視野を広げれば、この考え方はDockerやCI/CDにも通じます。

仮想環境で学ぶ本質は、コマンドの暗記ではなく、状態を明示し、再構築可能にする姿勢です。

環境を手作業の記憶に頼らず、定義として残す。

この発想は、扱うツールが変わっても通用します。

つまり仮想環境は、単発のテクニックではなく、現代的な開発文化への入口でもあります。

もしまだ習慣化できていないなら、最初の一歩は難しくありません。

新しいPythonプロジェクトを作るたびに、最初に python -m venv .venv を実行する。

それだけでも開発の質は着実に変わります。

必要なライブラリを入れ、動作確認が取れたら依存関係を保存する。

この流れを繰り返せば、環境管理は特別な作業ではなく、自然な開発手順になります。

継続的な成果は、派手な裏技よりも、再現可能な基本動作から生まれます。

仮想環境はその典型です。

問題が起きてから慌てて対処するのではなく、問題が起きにくい構造を先に作る。

これはプログラミングに限らず、あらゆる設計に通じる合理的な考え方です。

「昨日まで動いてたのに…」という言葉を減らしたいなら、コードの書き方だけを磨くのでは不十分です。

コードが動く場所まで設計することが必要です。

そして、その最も手軽で効果的な実践が仮想環境の習慣化です。

今日から一つひとつのプロジェクトで環境を分けるだけでも、数か月後にはトラブルの量と調査時間に明確な差が現れるはずです。

コメント