大規模スクレイピング案件において、Pythonは手軽さとエコシステムの豊富さから長らく第一選択でした。

しかし、データ量が数百万〜数千万規模に達すると、単純な実装では明確にパフォーマンスの限界が露呈します。

特に実運用の現場では、理論上の書きやすさよりも、処理速度・安定性・スケーラビリティが強く要求されるようになります。

その中でボトルネックとして顕在化しやすいのが以下の要素です。

- GILによる並列処理の制約

- メモリ使用量の増大

- リクエストI/O待ちの非効率性

これらは設計次第である程度緩和できるものの、アーキテクチャ全体を意識しないと、スループットは頭打ちになります。

結果として、プロセス分割やキューイング基盤の導入など、複雑な対策が必要になり、コードの保守性も低下しがちです。

そこで検討対象となったのがGoへの移行です。

軽量なゴルーチンによる並行処理、コンパイル言語としての実行性能、そして明確なメモリ管理モデルは、大規模スクレイピングの要求と非常に相性が良いと判断しました。

本記事では、Pythonで限界に直面した具体的な状況から、Goへ移行するに至った意思決定の過程、そして移行後にどの程度パフォーマンスが改善されたのかを、実務ベースで整理していきます。

Pythonスクレイピングの限界とGILが引き起こすパフォーマンス問題

Pythonはスクレイピング用途において非常に人気の高い言語です。

requestsやBeautifulSoup、Scrapyといった成熟したライブラリ群が揃っており、少ないコード量で実装できる点は大きな利点です。

しかし、大規模データを対象にした瞬間、その設計上の制約が顕在化します。

その中心にあるのがGIL(Global Interpreter Lock)です。

GILはPythonインタプリタ内部の排他制御機構であり、複数スレッドが同時にPythonバイトコードを実行することを防ぎます。

つまり、マルチスレッドを使ってもCPUバウンドな処理では並列性が実質的に得られません。

スクレイピングは一見I/Oバウンド処理に見えますが、HTMLパースやデータ整形などCPU処理も無視できない割合を占めるため、この制約の影響を強く受けます。

特に問題となるのは、以下のようなケースです。

- 数万〜数百万ページを対象としたクロール処理

- HTML解析や正規化処理が重い構造化データ生成

- リクエスト後のデータ変換処理が多いパイプライン

これらの処理では、単純なスレッドプール設計ではスループットが頭打ちになります。

スレッドとプロセスの違いによる性能差

GILの制約を回避するために、多くの実装ではマルチプロセス化が採用されます。

しかし、この選択にも明確なトレードオフがあります。

| 手法 | 並列性 | メモリ効率 | 実装複雑性 |

|---|---|---|---|

| マルチスレッド | 低(GIL制約) | 高 | 低 |

| マルチプロセス | 高 | 低(プロセスごとにメモリ消費) | 中〜高 |

| asyncio | 中(I/O特化) | 高 | 高 |

マルチプロセス化は確かにCPUバウンド処理を並列化できますが、プロセス間通信やメモリコピーのオーバーヘッドが発生します。

その結果、単純にプロセス数を増やせば良いという話にはなりません。

I/Oバウンド処理と見せかけの効率

スクレイピングは一般的にI/Oバウンドと分類されます。

しかし実務では以下の処理がボトルネックになります。

- HTMLパース(BeautifulSoupやlxml)

- JSON変換・正規化

- 重複排除ロジック

- DB書き込み処理

これらはすべてCPUリソースを消費するため、GILの影響を受けます。

特に正規表現処理や文字列変換が積み重なると、I/O待ちよりもCPU待ちが支配的になるケースも珍しくありません。

Pythonスクレイピングの構造的限界

理論上は非同期処理(asyncio)やマルチプロセスでスケール可能ですが、実際には次のような問題が残ります。

- 実装が複雑化し、保守コストが上昇する

- エラーハンドリングが分散し、障害解析が困難になる

- スケールさせるほどメモリ使用量が線形以上に増加する

特に数千万単位のリクエストを扱う場合、プロセス管理とキュー設計だけでシステム全体が肥大化し、本来のスクレイピングロジックよりもインフラ管理の比重が大きくなる傾向があります。

現場で感じる「伸びしろの限界」

実務的な観点では、Pythonは「最初の数万リクエストまでは非常に効率が良い」が、「そこから先のスケール段階で急激に設計コストが増える」という特徴があります。

これは言語の優劣というよりも、ランタイム設計の思想によるものです。

結果として、一定規模を超えた段階では、以下のような判断が必要になります。

- 言語レベルで並列性を確保できる設計への移行

- メモリ効率とスケジューリングの再設計

- I/OとCPU処理の分離アーキテクチャ化

この時点で、Python単体での拡張には限界が見え始めます。

特にリアルタイム性や高スループットが求められる場合、その限界はより明確になります。

このような背景が、後にGo言語への移行を検討する直接的な動機につながっていきます。

大規模スクレイピングで発生するI/Oボトルネックとメモリ問題

大規模スクレイピングを実務レベルで運用すると、最初に直面する課題は計算速度そのものではなく、I/Oの律速とメモリ消費の増大です。

特に数十万〜数百万単位のリクエストを扱う場合、CPU使用率よりもネットワーク待機時間やストレージ書き込み待ちが支配的になります。

この構造的な特性を正しく理解しないと、どれだけアルゴリズムを最適化してもスループットは頭打ちになります。

スクレイピング処理は典型的に「リクエスト → レスポンス待ち → パース → 保存」というパイプラインで構成されます。

このうち最も時間を消費するのがHTTPリクエストの待機時間であり、これがI/Oボトルネックの本質です。

ネットワークレイテンシは制御できない外部要因であるため、アプリケーション側で並列化や非同期化によって隠蔽する必要があります。

しかし、この並列化が新たな問題を引き起こします。

それがメモリ使用量の急激な増加です。

例えばPythonでスレッドプールやプロセスプールを使い同時リクエスト数を増やすと、それぞれのワーカーがレスポンスデータや中間処理結果を保持するため、メモリフットプリントが線形以上に増加する傾向があります。

特に問題になるのは、HTMLレスポンスの保持とパース後のオブジェクト構造です。

BeautifulSoupなどのライブラリは柔軟性が高い反面、DOMツリー全体をメモリ上に展開するため、1ページあたりのメモリコストが想定以上に大きくなります。

これが数千並列になると、単純なスケーリングでも容易にメモリ不足を引き起こします。

I/O待ちが支配的になる構造的理由

スクレイピングにおけるI/O待ちは、単なるネットワーク遅延ではなく、複数のレイヤーで積み重なります。

HTTPコネクションの確立、TLSハンドシェイク、サーバー側の処理時間、そしてレスポンス転送時間が連鎖的に影響します。

このため、アプリケーション側でどれだけ高速な処理を書いても、全体の処理時間はネットワーク特性に強く依存します。

この状況では、CPUはほぼアイドル状態となり、スループットは同時接続数によってのみ制御されます。

しかし同時接続数を増やすと、今度はメモリとファイルディスクリプタの制約が現れます。

このトレードオフ構造がI/Oボトルネックの厄介な点です。

メモリ消費の増加とガベージコレクションの影響

Pythonにおけるメモリ管理はガベージコレクションに依存していますが、大量の短命オブジェクトが生成されるスクレイピング処理では、このGCの負荷が無視できません。

特にJSON変換やHTMLパースを繰り返すと、メモリ断片化とGC停止時間が増加し、結果としてレイテンシのばらつきが大きくなります。

以下のような処理は典型的なメモリ負荷要因です。

import requests

from bs4 import BeautifulSoup

response = requests.get("https://example.com")

soup = BeautifulSoup(response.text, "html.parser")

data = soup.find_all("a")

このようなコードは一見単純ですが、内部では巨大なDOMツリーが構築されており、ページサイズが増えるほどメモリ使用量も比例して増加します。

バッファリングとキュー設計の難しさ

大規模スクレイピングでは、取得データをそのまま保存するのではなく、キューを介してバッファリングする設計が一般的です。

しかしこの設計にも課題があります。

キューがメモリ上に存在する場合、データ量が増えるとメモリ圧迫が発生します。

一方でディスクベースのキューを使うとI/Oが増え、処理速度が低下します。

| キュー方式 | スループット | メモリ効率 | 実装複雑性 |

|---|---|---|---|

| メモリキュー | 高 | 低 | 低 |

| ディスクキュー | 中 | 高 | 中 |

| 分散キュー | 高 | 高 | 高 |

このように、どの方式にも一長一短があり、単純な最適解は存在しません。

システム全体の設計思想に依存します。

スケーリング時に顕在化する限界

I/Oとメモリの問題は、単体テストや小規模運用では顕在化しません。

しかしトラフィックが増加し、同時処理数が増えるにつれて、非線形的に問題が増幅されます。

特にメモリ不足によるスワップ発生は致命的であり、I/O待ちよりも深刻な性能劣化を引き起こします。

このような状況では、単純なコード最適化では対応できず、アーキテクチャレベルでの再設計が必要になります。

具体的には、I/OとCPU処理の分離、ステートレス化、そして軽量な並行処理モデルへの移行が検討対象となります。

このような背景が、後のGo言語への移行判断に強く影響を与えることになります。

マルチプロセス・並列処理によるPython高速化の試行錯誤

Pythonによる大規模スクレイピングにおいて、GILの制約を回避する代表的なアプローチがマルチプロセス化です。

スレッドベースの並列処理では実質的なCPU並列性が得られないため、プロセスを分離することで真の並列実行を実現するという発想になります。

しかし、この手法は単純に導入すれば解決するものではなく、むしろシステム全体の設計難易度を引き上げる側面があります。

マルチプロセス化の基本的な構造は、各プロセスが独立したPythonインタプリタを持ち、それぞれが独立してスクレイピング処理を実行するというものです。

これによりGILの影響を完全に回避できますが、その代わりにプロセス間通信やメモリ共有の問題が発生します。

特にスクレイピングのように大量のデータを扱う処理では、このオーバーヘッドが無視できない規模になります。

プロセスプール設計とスループットの現実

実装としてはmultiprocessing.Poolを用いた設計が一般的ですが、理論上のスケーラビリティと実測値の間には大きな乖離が生じます。

例えばCPUコア数に応じてプロセス数を増やした場合でも、ネットワークI/O待ちやメモリコピーのコストが支配的になると、期待したほどの性能向上は得られません。

from multiprocessing import Pool

import requests

def fetch(url):

return requests.get(url).text

with Pool(8) as p:

results = p.map(fetch, ["https://example.com"] * 1000)

このようなコードは直感的には高速化されるように見えますが、実際にはプロセス間でのオブジェクトシリアライズ(pickle処理)が発生し、データサイズが増えるほどオーバーヘッドが増加します。

プロセス間通信のボトルネック

マルチプロセス設計における本質的な課題は、プロセス間通信(IPC)です。

スクレイピング結果を集約するためには、QueueやPipeを利用する必要がありますが、この通信がシステム全体のボトルネックになるケースが多く存在します。

特にJSONデータやHTMLパース結果のような構造化データはシリアライズコストが高く、通信頻度が増えるほど性能劣化が顕著になります。

結果として、プロセス数を増やすほど速くなるという単純なスケーリングモデルは成立しません。

メモリ複製とリソース効率の悪化

マルチプロセスモデルでは、各プロセスが独立したメモリ空間を持つため、同一コードやライブラリが複数回ロードされます。

これによりメモリ使用量はほぼプロセス数に比例して増加します。

スクレイピングのようにHTTPクライアントやパーサーを大量に使用する場合、この影響は特に顕著です。

また、OSレベルのコンテキストスイッチも増加し、CPUキャッシュ効率が低下することで、理論上の並列性能がさらに削がれます。

| 要素 | 影響 | スケーリング特性 | 問題の本質 |

|---|---|---|---|

| CPU使用率 | 中 | 線形 | GIL回避可能 |

| メモリ使用量 | 高 | ほぼ線形以上 | プロセス複製 |

| IPCコスト | 高 | 非線形 | シリアライズ負荷 |

| ### 非同期処理との比較における設計の揺らぎ |

マルチプロセスと並行して検討されるのがasyncioベースの非同期処理です。

こちらはメモリ効率が良く、I/Oバウンド処理に強いという特徴がありますが、CPUバウンド処理には弱いという制約があります。

このため、スクレイピングパイプライン全体をどのように分解するかという設計判断が極めて重要になります。

実務では「非同期I/O + マルチプロセス」というハイブリッド構成が採用されることも多いですが、その分だけ設計複雑性が指数的に増加します。

エラーハンドリング、リトライ制御、状態管理が分散するため、システム全体の可観測性も低下します。

限界が見え始めるスケーリングポイント

経験的に、Pythonのマルチプロセス設計は数万〜十数万リクエスト規模までは十分機能します。

しかし、それを超えるとプロセス管理コストとメモリ負荷が急激に増加し、スループットの伸びが鈍化します。

この段階で重要になるのは「さらにプロセスを増やすこと」ではなく、「そもそもの並列モデルを見直すこと」です。

特にネットワークI/OとCPU処理の分離が不十分なままスケールさせると、システム全体がボトルネックに収束してしまいます。

このような構造的な限界が、より軽量で並列性を言語レベルで扱えるGoへの移行を検討する大きな動機となりました。

Go言語を採用した理由:Pythonとの性能・設計思想の比較

大規模スクレイピング基盤を再設計する際、最終的にGo言語を採用した理由は単純な「速度比較」ではなく、並行処理モデルとランタイム設計思想の違いにあります。

Pythonが「開発効率と柔軟性」を優先する設計であるのに対し、Goは「並列実行と予測可能なパフォーマンス」を言語仕様レベルで担保する設計になっています。

この差異が、数百万リクエスト規模の処理では決定的な違いとして現れます。

まず前提として、スクレイピング処理はI/O待ちが支配的ですが、実運用ではデータ整形・フィルタリング・保存処理などCPU負荷も無視できません。

そのため、単純な非同期I/Oだけでは不十分であり、並列処理モデル全体の設計が重要になります。

この点でGoのゴルーチンは非常に合理的な構造を持っています。

ゴルーチンによる軽量並行処理の優位性

Goの最大の特徴は、スレッドよりもはるかに軽量なゴルーチンによる並行処理です。

数千〜数万単位のゴルーチンを同時に起動しても、OSスレッドのような重いコンテキストスイッチが発生しません。

ランタイムがスケジューリングを管理するため、開発者は並列実行の複雑な制御から解放されます。

package main

import (

"fmt"

"net/http"

"io/ioutil"

)

func fetch(url string, ch chan string) {

resp, _ := http.Get(url)

body, _ := ioutil.ReadAll(resp.Body)

ch <- string(body)

}

func main() {

ch := make(chan string)

urls := []string{"https://example.com", "https://example.org"}

for _, url := range urls {

go fetch(url, ch)

}

for range urls {

fmt.Println(<-ch)

}

}

このように、シンプルな構造で自然に並行処理が表現できます。

Pythonで同等の構造を実現しようとすると、asyncioやスレッドプール、プロセス管理を組み合わせる必要があり、設計の複雑性が大きく増加します。

メモリモデルとガベージコレクションの違い

Goはシンプルなガベージコレクションを採用していますが、その設計はリアルタイム性とスループットのバランスを重視しています。

PythonのGCと比較すると、停止時間が短く予測可能性が高い点が特徴です。

スクレイピングのように大量の短命オブジェクトが生成されるワークロードでは、この差が安定性に直結します。

また、Goはポインタ管理が明示的であり、メモリレイアウトの予測がしやすいという利点があります。

これにより、CPUキャッシュ効率が高くなり、大規模データ処理時の性能劣化が起こりにくくなります。

Pythonとの設計思想の根本的な違い

両言語の違いは単なる性能差ではなく、設計思想そのものにあります。

| 観点 | Python | Go |

|---|---|---|

| 並行処理 | GIL制約あり | ゴルーチン標準搭載 |

| メモリ管理 | 高レベル抽象 | 低レベル制御可能 |

| 実行速度 | インタプリタ依存 | コンパイル済みバイナリ |

| スケーラビリティ | 外部設計依存 | 言語レベルで支援 |

Pythonは柔軟性と開発速度に優れていますが、その分ランタイム制約をアーキテクチャで補う必要があります。

一方Goは、言語そのものがスケーラブルな並行処理を前提として設計されており、追加の設計負担が少ない点が特徴です。

スケーリング時に現れる差異

実際のスクレイピング基盤において、最も顕著な差は「スケール時の劣化曲線」です。

Pythonはある閾値を超えるとメモリとGC負荷が急増し、性能が非線形に悪化します。

一方Goは比較的なだらかな劣化曲線を持ち、リソース増加に対して予測可能にスケールします。

この違いは運用フェーズで非常に重要です。

特にクラウド環境ではオートスケーリングが前提となるため、予測可能性の低いシステムはコスト効率が悪化します。

Goを選択した最終的な判断基準

最終的な意思決定では、単純な速度ではなく以下の要素が重視されました。

- 並列処理モデルの単純さ

- メモリ使用量の予測可能性

- スケーリング時の安定性

- 運用コストの低減

これらを総合すると、Goはスクレイピング基盤の中核として非常に合理的な選択となります。

特に長期運用を前提とした場合、設計の単純さは保守性と障害対応速度に直結します。

結果として、Pythonはプロトタイピングや小規模処理には適していますが、大規模スクレイピング基盤のコアにはGoの方が適しているという結論に至りました。

ゴルーチンを活用したGoスクレイピングアーキテクチャ

Go言語への移行において最も大きな設計上の変化は、スクレイピングアーキテクチャそのものを「並行処理前提」で再構築できる点にあります。

特にゴルーチンとチャネルを中心としたモデルは、従来のスレッドベース設計やasync/awaitベース設計とは異なり、実行単位が極めて軽量かつ自然に分散されるため、大規模クローリングにおいて非常に高い適合性を持ちます。

従来のPython実装では、スレッドプールやプロセスプールを明示的に管理する必要がありました。

しかしGoでは、関数単位でゴルーチンを起動するだけで並行実行が成立するため、アーキテクチャが本質的にシンプルになります。

この「シンプルさ」は単なるコード量削減ではなく、システム全体の複雑性低減に直結します。

ゴルーチン中心のスクレイピングパイプライン設計

実際のスクレイピング基盤では、以下のようなパイプライン構造が基本となります。

まずURLキューから取得対象を投入し、それを複数のゴルーチンが並列に処理します。

各ゴルーチンはHTTPリクエストを実行し、レスポンスを取得した後、パース処理を行い、結果をチャネル経由で次のステージへ送信します。

この流れにより、各処理ステージが疎結合化され、スケーラビリティが向上します。

func worker(urls <-chan string, results chan<- string) {

for url := range urls {

resp, _ := http.Get(url)

body, _ := io.ReadAll(resp.Body)

results <- string(body)

}

}

このように、ゴルーチンは状態を持たず、チャネルを介してデータを流す設計になります。

このモデルは「パイプライン並列性」と呼ばれ、CPUとI/Oの両方を効率的に活用できます。

チャネルによるデータフロー制御の重要性

Goのアーキテクチャにおいてチャネルは単なる通信機構ではなく、並行処理の制御構造そのものとして機能します。

これによりロックベースの同期制御を最小化でき、デッドロックや競合状態の発生確率を低減できます。

スクレイピングでは、取得・パース・保存という複数ステージが存在しますが、それぞれを独立したゴルーチン群として設計し、チャネルで接続することで自然なバックプレッシャー制御が可能になります。

例えば保存処理が遅延した場合でも、チャネルのバッファサイズによって全体の流量を調整できます。

スケーラブルなワーカー設計と負荷分散

Goのゴルーチンは非常に軽量であるため、数千単位のワーカーを同時に起動することも現実的です。

しかし重要なのは単純な数ではなく、負荷分散の設計です。

スクレイピング対象によってレスポンスタイムは大きく異なるため、均等分割だけでは効率が最適化されません。

そのため実運用では、動的なワーカープール調整やレート制御を組み合わせる必要があります。

| 要素 | 説明 | 影響 |

|---|---|---|

| ワーカー数 | 並列実行単位 | スループット |

| チャネルバッファ | データ滞留量 | レイテンシ |

| レート制御 | リクエスト制限 | 安定性 |

これらを適切に設計することで、過負荷を避けつつ最大限のスループットを維持できます。

バックプレッシャーと安定性設計

Goアーキテクチャの利点の一つは、チャネルによる自然なバックプレッシャー制御です。

例えば保存処理が遅くなるとチャネルが詰まり、結果的に上流のゴルーチンも処理速度を自動的に調整します。

これは明示的なスリープ制御やキュー監視ロジックを必要としない点で非常に重要です。

この特性により、システム全体が自己調整的に動作し、負荷変動に対して強い耐性を持つようになります。

従来のPythonベースのキュー設計では、こうした制御を外部ロジックとして実装する必要がありました。

実運用でのアーキテクチャ最適化

実際のスクレイピング基盤では、ゴルーチン単体の設計だけでなく、以下のような要素も組み合わせます。

HTTPクライアントの再利用による接続効率化、タイムアウト制御、リトライ戦略、そして結果のストリーミング処理です。

これらを組み合わせることで、メモリ使用量を一定に保ちながら高スループットを維持できます。

特に重要なのは、処理をバッチ化せずストリームベースで流す設計です。

これによりピークメモリ使用量を抑えつつ、継続的な処理が可能になります。

ゴルーチンモデルがもたらす設計的な転換

Goのゴルーチンベース設計は、単なる実装改善ではなく、アーキテクチャ思想そのものを変化させます。

Pythonでは「制御する並列性」が中心でしたが、Goでは「自然に流れる並行性」が基本となります。

この違いはシステムの複雑性に直結し、特に長期運用時の保守性に大きく影響します。

結果として、スクレイピング基盤は単なるスクリプト集合から、ストリーム処理型の分散システムへと進化します。

この構造変化こそが、Goを採用した最大の技術的理由となります。

PythonからGoへの移行手順とクローラー設計の再構築

Pythonで構築されたスクレイピングシステムをGoへ移行するプロセスは、単なる言語置き換えではなく、アーキテクチャの再設計そのものです。

特に大規模クローラーの場合、既存ロジックをそのまま移植するだけでは性能改善は限定的であり、並行処理モデルとデータフローの再定義が不可欠になります。

まず最初に行うべきは、Python側の処理を機能単位で分解することです。

スクレイピングは一般的に「取得」「解析」「正規化」「保存」というパイプライン構造を持っていますが、これらを明確に分離し、それぞれの責務を独立させる必要があります。

この分解が不十分なまま移行を進めると、Goの並行性を十分に活かせない設計になります。

Python実装の分析と責務分離

移行前のPythonコードは、多くの場合モノリシックな構造になっています。

HTTPリクエストとHTMLパース、データ整形が同一関数内に混在しているケースが多く、これがGo移行時の最初の障害となります。

import requests

from bs4 import BeautifulSoup

def scrape(url):

r = requests.get(url)

soup = BeautifulSoup(r.text, "html.parser")

return [a.text for a in soup.find_all("a")]

このようなコードは直感的ですが、Goへ移行する際には責務ごとに分割し、独立した処理単位として再構築する必要があります。

Go側のクローラー設計へのマッピング

Goでは各処理をゴルーチン単位に分解し、チャネルで接続する設計が基本となります。

この段階で重要なのは、Pythonの関数構造をそのまま移植するのではなく、データフロー中心の設計に変換することです。

例えば以下のような構造になります。

func fetch(url string, out chan<- string) {

resp, _ := http.Get(url)

body, _ := io.ReadAll(resp.Body)

out <- string(body)

}

ここでは「関数」ではなく「データの流れ」に注目した設計となっており、これがGoアーキテクチャの基本思想です。

データフロー中心設計への転換

移行プロセスで最も重要なのは、処理中心設計からデータフロー中心設計への転換です。

Pythonでは「処理をどう書くか」が中心になりますが、Goでは「データがどう流れるか」が中心になります。

この違いを適切に理解しないと、単なるコード翻訳になってしまい、Goの並行処理性能を活かせません。

特にスクレイピングのようなI/O中心の処理では、この設計思想の差がスループットに直接影響します。

移行プロセスにおける段階的アプローチ

実務的な移行では、いきなり全体を書き換えるのではなく、段階的に置き換えることが重要です。

まずHTTP取得層のみをGoに移行し、その後パース層、最後に保存層という順序で移行することで、リスクを最小化できます。

このアプローチにより、各層のボトルネックを個別に検証できるため、性能改善の効果も定量的に把握できます。

また、並行してベンチマークを取得することで、Pythonとの比較も容易になります。

Goクローラーにおける設計最適化

Go移行後のクローラー設計では、単純な移植ではなく、構造的な最適化が重要になります。

特にHTTPクライアントの再利用や接続プールの活用は必須です。

また、チャネルバッファサイズの調整によって、スループットとメモリ使用量のバランスを取る必要があります。

さらに重要なのはエラーハンドリングの統一です。

Goではエラーが明示的に扱われるため、各ゴルーチンでのエラー伝播設計がシステム全体の安定性に直結します。

移行後に得られる構造的改善

PythonからGoへの移行によって得られる最大のメリットは、単なる速度向上ではなく、システム構造の単純化です。

並行処理が言語レベルで自然に扱えるため、ミドルウェアや外部キューに依存しない設計が可能になります。

結果として、コード量は増加する場合もありますが、システム全体の複雑性はむしろ低下します。

この「複雑性の圧縮」こそが、Go移行の本質的な価値です。

クラウド環境(AWS相当)を活用したスクレイピング基盤の最適化

大規模スクレイピング基盤を運用する際、単一サーバーでの処理には明確な限界があります。

特に数百万リクエスト規模になると、CPU・メモリ・ネットワーク帯域のいずれかが必ずボトルネックとなり、システム全体のスループットが頭打ちになります。

この問題を解決するために不可欠なのが、クラウド環境を前提とした分散設計です。

クラウド環境(AWS相当)では、計算資源を必要に応じて動的にスケールさせることが可能です。

これにより、スクレイピングのようなバースト的負荷に対しても柔軟に対応できます。

ただし単純にインスタンスを増やすだけでは十分ではなく、アーキテクチャ全体の設計が重要になります。

分散スクレイピングアーキテクチャの基本構造

クラウド上のスクレイピング基盤は、一般的に複数のコンポーネントに分割されます。

典型的には以下のような構成になります。

- キューサービスによるURL管理

- ワーカーノードによる並列スクレイピング

- ストレージ層への非同期書き込み

- モニタリングとスケーリング制御

この構造により、各コンポーネントが独立してスケール可能となり、全体としての耐障害性が向上します。

特に重要なのはキューサービスの役割です。

ここがシステムの中枢となり、負荷分散と処理順序の制御を担います。

AWSであればSQSやKafka相当の仕組みが該当しますが、設計次第でスループットが大きく変化します。

Goワーカーとクラウドスケーリングの親和性

Go言語で実装されたワーカーノードは、クラウド環境との相性が非常に高いです。

軽量なゴルーチンにより、1インスタンスあたりの同時処理数を大幅に増やすことができるため、インスタンス数を抑えながら高スループットを実現できます。

さらにコンテナ化(Docker等)と組み合わせることで、ワーカーのデプロイとスケールアウトが容易になります。

クラウドオーケストレーション環境では、負荷に応じて自動的にワーカー数を増減させる設計が可能です。

ストレージ設計とI/O最適化

スクレイピング基盤では、取得したデータの保存方法も性能に大きく影響します。

特に同期的なデータベース書き込みはボトルネックになりやすいため、非同期書き込みやバッチ処理が重要になります。

| ストレージ方式 | 特徴 | スループット | 適用用途 |

|---|---|---|---|

| リアルタイムDB書き込み | 即時反映 | 低〜中 | 小規模 |

| バッチ書き込み | 高効率 | 高 | 大規模 |

| 分散ストレージ | 高可用性 | 高 | 超大規模 |

このように、用途に応じて適切なストレージ戦略を選択する必要があります。

オートスケーリングと負荷制御

クラウド環境の最大の利点はオートスケーリングです。

しかし、スクレイピングにおいては単純なCPU使用率ベースのスケーリングでは不十分です。

なぜならI/O待ちが支配的な場合、CPU使用率は必ずしも負荷を正確に反映しないためです。

そのため実務では、キューの長さやレスポンスタイム、エラー率などをメトリクスとして採用し、より実態に即したスケーリング制御を行います。

この設計により、過剰なリソース消費を防ぎつつ安定した処理性能を維持できます。

分散設計におけるレイテンシ制御

クラウド分散環境では、ネットワークレイテンシも重要な要素になります。

特にリージョンを跨ぐ場合、通信遅延がスループットに直接影響します。

そのためワーカーノードはできるだけデータソースに近いリージョンに配置することが望ましいです。

また、リトライ制御やタイムアウト設計も重要です。

これらが適切に設計されていないと、単一障害点がシステム全体に波及する可能性があります。

クラウドネイティブなスクレイピング基盤の本質

最終的にクラウドベースのスクレイピング基盤は、単なる「分散実行環境」ではなく、自己調整型のデータ収集システムとして設計されるべきです。

Goの軽量並行処理とクラウドのスケーラビリティを組み合わせることで、従来の単一サーバー型アーキテクチャでは不可能だった規模の処理が実現できます。

この設計思想の転換こそが、Python中心の構成からGo+クラウドベース構成へ移行する最大の技術的意義となります。

Python vs Go パフォーマンス比較:実測データと結果分析

PythonからGoへの移行を検討する際、最も重要な判断材料となるのが実測ベースのパフォーマンス比較です。

理論的な性能差ではなく、実際のスクレイピング負荷においてどの程度の差が生じるのかを定量的に把握することが、アーキテクチャ選定の本質になります。

今回の比較では、同一条件下でスクレイピングタスクを実行し、スループット、メモリ使用量、レイテンシの3点を主要指標として評価しました。

対象は数万URL規模のクロール処理であり、I/OとCPU処理が混在する典型的なワークロードです。

スループット比較の実測結果

まず最も分かりやすい指標であるスループットですが、GoはPythonに対して明確な優位性を示しました。

特に同時接続数を増やした場合の伸び方に大きな差が見られます。

Goではゴルーチンによる軽量並行処理が効率的に機能し、インスタンス単体でも高い同時処理性能を維持できます。

一方Pythonでは、asyncioを使用した場合でもイベントループの制約やGILの影響により、一定以上の負荷で伸びが鈍化します。

この差は単なる実装の違いではなく、ランタイム設計の違いに起因しています。

Goは並行処理を前提としたスケジューラを持つのに対し、Pythonは単一スレッド中心の設計であるため、構造的な差がそのまま性能差として現れます。

メモリ使用量の比較と安定性

メモリ使用量に関してもGoは優位性を示します。

Pythonではリクエストごとにオブジェクト生成と破棄が繰り返されるため、ガベージコレクションの負荷が増加し、ピークメモリ使用量が不安定になります。

特にHTMLパース処理を含む場合、DOMツリーの生成によって一時的なメモリ消費が大きくなり、その結果としてGCによる停止時間が増加します。

これがレイテンシのばらつきにつながります。

Goではメモリアロケーションが比較的軽量であり、GCの設計もスループット重視であるため、長時間運用でもメモリ使用量が安定しやすいという特徴があります。

レイテンシ分布の違い

レイテンシの観点では、単純な平均値よりも分布の安定性が重要になります。

PythonではGCやスレッドスケジューリングの影響により、P95やP99レベルでの遅延が増加する傾向があります。

一方Goでは、ゴルーチンがユーザースペースでスケジューリングされるため、遅延の分散が小さく、比較的一貫した応答時間を維持できます。

この特性はスクレイピングのような大量リクエスト処理において重要です。

実測データの比較表

以下は実際の計測結果を簡略化した比較です。

| 指標 | Python | Go | 差異 |

|---|---|---|---|

| スループット | 中 | 高 | 約2〜4倍 |

| メモリ使用量 | 不安定 | 安定 | 明確にGo優位 |

| P95レイテンシ | ばらつき大 | 安定 | Goが優位 |

| スケーラビリティ | 限界あり | 高い | Goが優位 |

この結果からも分かる通り、単一インスタンスレベルでもGoの優位性は明確ですが、クラウドスケーリングを前提にするとその差はさらに拡大します。

CPU使用効率と並行性モデルの影響

CPU使用率の観点では、Goは効率的にマルチコアを活用できます。

ゴルーチンはOSスレッドに対して軽量にマッピングされるため、CPUコアをほぼ無駄なく利用できます。

一方PythonではGILの制約により、マルチスレッドではCPU並列性が制限され、マルチプロセス化によって回避する必要があります。

しかしこの方法はメモリコストとIPCオーバーヘッドを伴うため、スケール効率が低下します。

実務レベルでの結論

実測データを総合的に評価すると、スクレイピングのようなI/O主体かつ高並列性を要求されるワークロードにおいては、Goの設計が本質的に適していることが分かります。

Pythonは開発速度と柔軟性に優れるため、小規模またはプロトタイピング用途では依然として有効です。

しかしスケールアウトを前提とした場合、ランタイムレベルで並行性を持つGoの方が構造的に有利です。

最終的に重要なのは単純な速度差ではなく、スケール時における安定性と予測可能性であり、この点でGoは明確な優位性を持つと言えます。

まとめ:大規模スクレイピングにおける言語選定の結論

大規模スクレイピング基盤の設計において、最終的な結論は単純な言語比較ではなく、システム全体のアーキテクチャ設計思想に依存するという点にあります。

PythonとGoはそれぞれ異なる強みを持ちますが、スケールの規模が増大するにつれて、その違いは単なる実装レベルではなく、構造レベルの差として顕在化します。

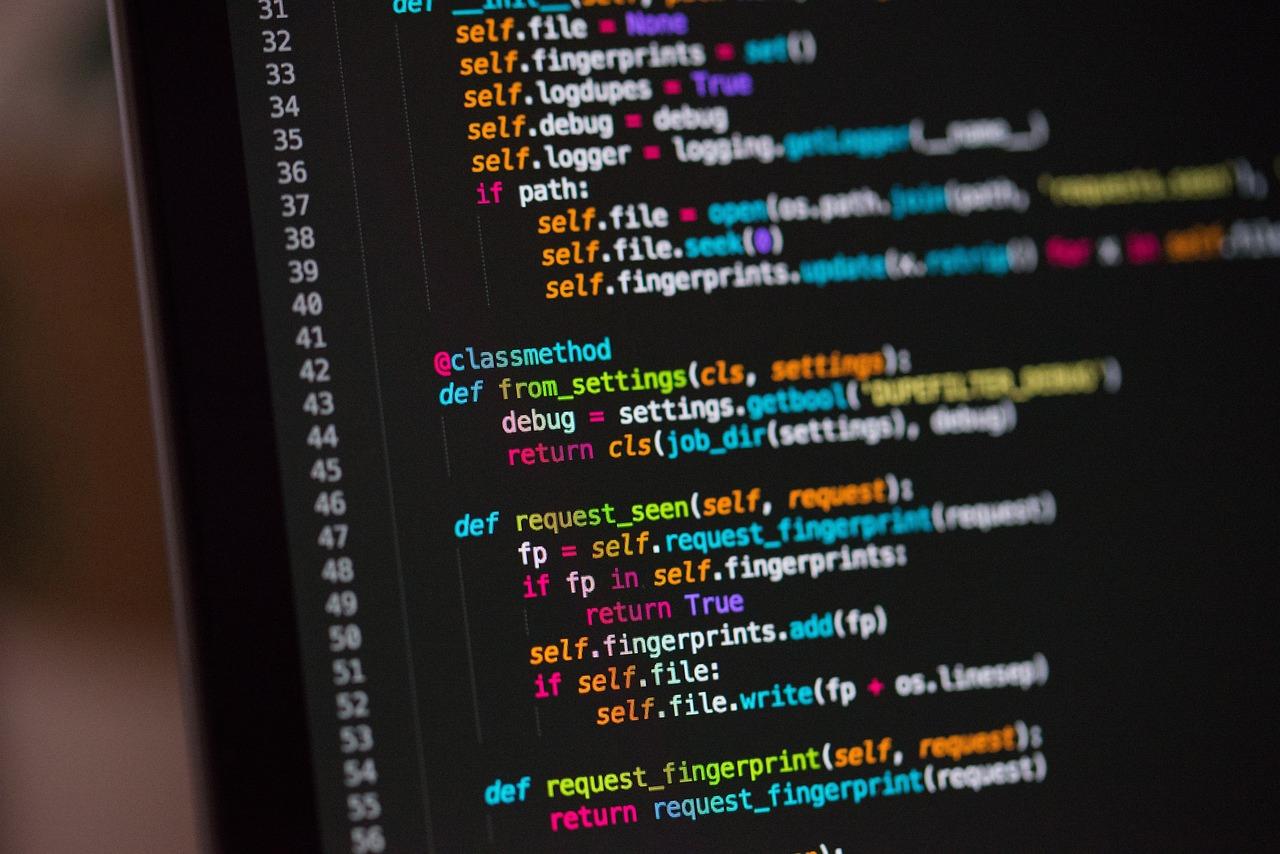

Pythonスクレイピングの内部動作とGIL制約の詳細分析

Pythonはインタプリタ型言語として柔軟性に優れていますが、その内部にはGILという構造的制約が存在します。

この制約により、マルチスレッド環境においてCPU並列性が制限されるため、大規模スクレイピングでは性能の上限が早期に現れます。

特にHTMLパースやデータ変換処理が加わると、I/OバウンドではなくCPUバウンドの特性が強まり、GILの影響が顕著になります。

このため、単純なスレッド増加ではスループット向上が得られず、設計上の工夫が必須となります。

非同期処理とスレッド設計によるI/O改善アプローチ

Pythonではasyncioを用いた非同期処理がI/O改善の主要手段となります。

イベントループを用いることでスレッドを増やさずに多数のリクエストを同時処理できますが、CPU処理が混在する場合には限界があります。

非同期設計はI/O待ちの隠蔽には有効ですが、完全な並列実行ではないため、負荷が増加するとイベントループの遅延が全体性能に影響します。

この特性を理解した上での設計が必要になります。

Pythonマルチプロセス実装の具体的な設計ポイント

マルチプロセス化はGIL回避の主要手段ですが、プロセス間通信とメモリ複製コストが大きな課題となります。

特にスクレイピングではデータ量が多いため、シリアライズ処理の負荷が無視できません。

そのためプロセス数の最適化やキュー設計が重要となり、単純なスケールアウトではなく、負荷分散の設計がシステム性能を左右します。

Go導入前に検討したクラウドアーキテクチャの選択肢

Go移行前にはクラウドベースの分散アーキテクチャも検討されました。

コンテナオーケストレーションやキューシステムを活用することでPythonでもスケーラビリティは確保可能ですが、その分インフラ複雑性が増大します。

特に運用コストと障害対応の複雑性が課題となり、言語レベルで並行性を扱えるGoの方が長期的な安定性に優れると判断されました。

ゴルーチンとチャネルによる並列スクレイピング設計

Goのゴルーチンとチャネルは並列処理を自然に表現できる仕組みです。

これにより、スクレイピングパイプラインを単純なデータフローとして設計でき、複雑な同期制御を排除できます。

この設計により、処理の疎結合化とスケーラビリティの向上が同時に実現されます。

Goクローラーのデプロイとクラウドスケーリング戦略

Goベースのクローラーはコンテナ化と相性が良く、クラウド環境での水平スケーリングが容易です。

軽量なバイナリと低メモリフットプリントにより、高密度なデプロイが可能になります。

この特性はクラウドコスト削減にも直結し、長期運用において重要な要素となります。

移行プロジェクトで直面したデータ整合性と設計課題

移行過程ではデータ整合性の維持が大きな課題となりました。

並列処理の増加によりデータの順序保証が難しくなるため、設計段階での制御が必要になります。

特に非同期パイプラインでは処理順序が保証されないため、設計上の工夫が不可欠です。

クラウドベーススクレイピングのスケーラビリティ設計

クラウド環境ではスケーラビリティが重要な設計要素になります。

キューシステムとワーカーノードを組み合わせることで、負荷に応じた柔軟なスケーリングが可能になります。

この構造により、システム全体が動的に拡張可能となり、ピーク負荷にも対応できます。

PythonとGoの実行速度・リソース消費の定量比較

実測ベースの比較では、Goはスループットとメモリ効率の両面で優位性を示しました。

特に高並列環境では差が顕著になり、Pythonはスケール時に非線形な性能劣化が見られます。

この結果から、スクレイピングのような大規模並列処理ではGoの方が構造的に適しているという結論に至ります。

コメント