2026年になった現在でも、「PHPでスクレイピングを行うのは古いのではないか」という疑問は根強く存在しています。

しかし実務の現場に目を向けると、PHPは依然としてサーバーサイド統合の観点で有力な選択肢であり続けています。

特に既存のWebアプリケーションとの親和性や、レンタルサーバー環境での扱いやすさを考慮すると、その価値は単純に過去の遺物として片付けられるものではありません。

スクレイピング技術そのものはPythonやNode.jsの台頭によって多様化しましたが、PHPにはPHPならではの強みがあります。

例えば、Webアプリケーションのバックエンドとデータ収集処理を同一言語・同一環境で完結できる点は、運用コストの削減や障害時の切り分けの容易さに直結します。

実務的な観点から整理すると、PHPによるスクレイピングは次のような場面で依然として有効です。

- 既存のPHP製CMSや業務システムと直接連携する場合

- 小〜中規模の定期クローリング処理

- 外部ライブラリ依存を最小限に抑えたいレンタルサーバー環境

これらの条件下では、むしろ新しい言語スタックを導入するよりも、PHPで統一した方が設計がシンプルになるケースも少なくありません。

一方で、最新の非同期処理や高度な並列クローリングといった領域では、他言語に分があるのも事実です。

そのため重要なのは「PHPが使えるかどうか」ではなく、「どの要件に対してPHPが最適か」を見極める視点です。

本記事では、単なるレガシー技術としてではなく、サーバーサイド統合の文脈からPHPスクレイピングを再評価し、その実用性と設計上の判断基準について整理していきます。

2026年に再び注目されるPHPスクレイピングの背景

2026年という現在の視点から見ると、PHPによるスクレイピングは一度は「過去の技術」として扱われかけたにもかかわらず、再び実務レベルで注目されつつあります。

その背景には単なる流行ではなく、サーバーサイド開発の現実的な制約と、既存システム資産の蓄積という構造的な要因があります。

まず前提として、スクレイピング技術そのものはこの10年で大きく進化しました。

Pythonの豊富なライブラリ群や、Node.jsの非同期処理能力、さらにはクラウドベースの分散クローリング基盤の登場により、技術的な選択肢は明らかに拡張されています。

しかしそれにもかかわらず、PHPが再評価されている理由は「新しさ」ではなく「統合の容易さ」にあります。

特に多くの企業システムでは、依然としてPHPベースのCMSや業務システムが稼働しています。

こうした環境では、外部データの収集処理を別言語で構築すると、データパイプラインが分断され、保守コストが増大します。

そのため、同一言語で完結する設計が再び合理的な選択肢として浮上しています。

例えば、既存のWebアプリケーションにスクレイピング機能を追加する場合、PHPであればそのままアプリケーション層に組み込むことができます。

これはアーキテクチャの単純化という意味で非常に重要です。

以下は典型的なHTTP取得処理の一例です。

$client = new \GuzzleHttp\Client();

$response = $client->get('https://example.com');

$html = (string) $response->getBody();

このような構造は、外部プロセスを起動せずにWebアプリケーション内部で完結するため、デプロイや監視の複雑性を抑える効果があります。

また、2026年時点ではクラウドネイティブな構成が一般化していますが、それでもレンタルサーバーやオンプレミス環境は完全には消えていません。

むしろ中小規模システムでは依然として重要な基盤であり、そこではPHPの「軽量性」と「即時実行性」が強く効いてきます。

さらに見逃せないのは、レガシー資産の存在です。

長年運用されてきたPHPアプリケーションは数多く存在し、それらを全面的に書き換えるコストは非常に高いものです。

そのため、既存コードの延長線上でスクレイピング機能を追加するニーズはむしろ増加しています。

一方で、最新技術との比較においてPHPが劣る領域があることも事実です。

非同期処理や大規模分散クローリングでは、Node.jsやPythonベースのフレームワークの方が明確に優位です。

しかし重要なのは性能単体ではなく、システム全体としての整合性です。

特に業務システムでは、性能よりも保守性や統合容易性が優先されるケースが多く見られます。

このように、PHPスクレイピングが再評価されている背景は単なる技術的懐古ではなく、現実のシステム制約と運用コストの最適化に基づいています。

結果として、2026年においてもPHPは「選ばれる理由を持つ言語」として一定の地位を維持していると言えます。

PHPスクレイピングの基本構造と動作原理

PHPによるスクレイピングは、一見すると単純なHTTP通信とHTML解析の組み合わせに見えますが、内部的にはいくつかの層に分解して理解する必要があります。

特にサーバーサイドで安定運用する場合、単なる「ページ取得コード」ではなく、リクエスト生成・レスポンス処理・DOM解析という三つの段階を明確に意識することが重要です。

まず基本となるのはHTTPリクエストの生成です。

PHPでは標準関数だけでも取得は可能ですが、実務では柔軟性と保守性の観点からHTTPクライアントライブラリを使用するのが一般的です。

リクエストは単なるURLアクセスではなく、ヘッダー制御やCookie管理、リダイレクト追従といった要素を含むため、ここで設計の品質が大きく左右されます。

次にレスポンス処理ですが、取得したHTMLは単なる文字列として扱うのではなく、構造化データとして解釈する必要があります。

ここでDOM解析が登場します。

PHPではDOMDocumentやSimpleXMLなどが利用されますが、実務ではより柔軟なCSSセレクタベースのライブラリが使われることも多いです。

例えば基本的なDOM解析の流れは以下のようになります。

$dom = new DOMDocument();

libxml_use_internal_errors(true);

$dom->loadHTML($html);

$xpath = new DOMXPath($dom);

$nodes = $xpath->query('//title');

echo $nodes->item(0)->nodeValue;

このように、HTMLをツリー構造として扱い、XPathやCSSセレクタ的な方法で必要な要素を抽出するのが基本構造です。

ここで重要なのは、スクレイピングは単なる「取得」ではなく「変換処理」であるという点です。

取得したHTMLをそのまま保存するケースは少なく、多くの場合は以下のような変換工程を経ます。

| 段階 | 処理内容 | 目的 |

|---|---|---|

| 取得 | HTTPリクエスト送信 | 外部ページの取得 |

| 解析 | DOM構造化 | 情報抽出可能な形に変換 |

| 抽出 | タグ・属性取得 | 必要データの選別 |

| 整形 | JSON化など | システム連携 |

この一連の流れを理解することで、PHPスクレイピングは単なるスクリプトではなく、軽量なETL処理として捉えることができます。

さらに実務では、HTMLの不整合やJavaScript生成コンテンツへの対応も課題となります。

PHP単体ではブラウザエンジンを持たないため、動的コンテンツの取得には限界があります。

この点は設計段階で明確に認識しておく必要があります。

一方で、静的HTMLを対象としたスクレイピングではPHPは非常に安定した選択肢です。

特にレンタルサーバー環境では追加インストール不要で動作することが多く、デプロイの容易さという点で強い利点を持ちます。

また、処理の流れをサーバーサイドで完結できるため、フロントエンドに負荷をかけずにデータ収集が可能です。

これはシステム設計上、責務分離の観点でも合理的です。

このようにPHPスクレイピングの基本構造は、単純なHTTP取得から始まり、解析・抽出・変換へと段階的に発展する設計になっています。

そしてそのシンプルさこそが、2026年においてもなお一定の実用性を維持している理由の一つだと言えます。

Python・JavaScriptと比較する最新スクレイピング技術の潮流

スクレイピング技術の現在地を正しく理解するためには、PHP単体の話に閉じるのではなく、PythonやJavaScriptといった主要言語との比較軸で捉える必要があります。

2026年時点では、スクレイピングは単なるHTTP取得処理ではなく、非同期処理・ブラウザ自動化・分散処理を含む総合的なデータ収集基盤へと進化しています。

まずPythonは、依然としてスクレイピング分野の中心的存在です。

BeautifulSoupやScrapyといった成熟したライブラリ群に加え、SeleniumやPlaywrightによるブラウザ自動操作が標準的な選択肢になっています。

特にPythonの強みは、データ処理まで含めた一気通貫のエコシステムにあります。

取得したデータをそのまま機械学習パイプラインへ流せる点は、他言語と比較しても明確な優位性があります。

一方でJavaScript、特にNode.js環境は、フロントエンドとの親和性を活かしたスクレイピングが強みです。

ブラウザと同じ実行モデルを持つため、動的コンテンツの再現性が高く、PlaywrightやPuppeteerを用いたヘッドレスブラウザ制御は非常に強力です。

JavaScriptは「表示される結果そのものを取得する」アプローチに適しており、SPA構造のサイトでは特に有効です。

ここでPHPと比較すると、構造的な違いが明確になります。

PHPは基本的にリクエスト・レスポンス型の同期処理を前提としているため、ブラウザエミュレーションや高度な非同期制御には本質的に向いていません。

しかしその代わり、Webアプリケーション内部への統合性が極めて高いという特徴があります。

例えば技術特性を整理すると以下のようになります。

| 言語 | 得意領域 | スクレイピング方式 | 強み |

|---|---|---|---|

| PHP | サーバー統合 | 同期HTTP取得 | 軽量・既存CMS統合 |

| Python | データ処理全般 | 非同期+自動化 | 分析・機械学習連携 |

| JavaScript | 動的サイト | ブラウザ自動化 | フロント再現性 |

この比較から分かる通り、スクレイピングの優劣は言語単体では決まりません。

むしろ「どの層に統合するか」によって最適解が変化します。

特に近年の傾向として重要なのは、スクレイピングが単体ツールではなく「データパイプラインの一部」として設計される点です。

そのため、Pythonは後段処理に強く、JavaScriptは前段のブラウザ制御に強く、PHPは中間層として既存Webシステムへの統合に強いという役割分担が明確になっています。

また、非同期処理の観点ではNode.jsやPythonのasync系ライブラリが圧倒的に有利ですが、すべてのプロジェクトが高スループットを必要としているわけではありません。

業務システムの多くはむしろ安定性と保守性を優先するため、PHPのような同期型モデルでも十分に要件を満たします。

さらに、クラウドネイティブ環境の普及により、スクレイピングはサーバーレス関数やコンテナで実行されるケースも増えています。

この場合でも、言語選択は依然として重要ですが、それ以上に「既存システムとの接続性」が評価軸になります。

結論として、2026年のスクレイピング技術は単一言語の競争ではなく、役割分担型のアーキテクチャへと移行しています。

その中でPHPは主役ではないものの、確実に「統合レイヤー」としての価値を維持していると言えます。

サーバーサイド統合におけるPHPの強みと実用性

PHPが2026年においてもスクレイピング用途で一定の評価を維持している最大の理由は、単体の処理性能ではなくサーバーサイド統合における設計適合性にあります。

特に既存のWebアプリケーションやCMSと密接に結びついた環境では、PHPは依然として極めて現実的な選択肢です。

まず理解すべきなのは、PHPが生まれた背景そのものがWebサーバー統合を前提としている点です。

ApacheやNginxといったHTTPサーバーと直接連携し、リクエスト単位でスクリプトを実行するモデルは、スクレイピングのような「短時間で完結するデータ取得処理」と非常に相性が良い構造になっています。

このため、外部プロセスや複雑なランタイムを介さずに処理が完結するという点は、他言語と比較しても明確な利点です。

さらに重要なのは、既存システムへの組み込みやすさです。

多くの企業では長年運用されてきたPHPベースのCMSや業務管理システムが存在しており、それらに新機能としてスクレイピングを追加する場合、同一言語で実装できることは設計上の負担を大幅に軽減します。

異なる言語スタックを導入すると、データ受け渡しのインターフェース設計や運用監視の複雑性が増大し、結果としてシステム全体の可観測性が低下することがあります。

実際の統合例としては、スクレイピング結果をそのままデータベースに保存し、既存のPHPアプリケーションから参照する構成が一般的です。

この場合、追加のミドルウェアを必要とせず、アプリケーション層のみで完結するため、運用コストを最小化できます。

また、レンタルサーバー環境における実用性も見逃せません。

PHPはほぼ標準で利用可能であり、追加のランタイムインストールが不要なケースが多いため、制約のある環境でも即座にスクレイピング機能を実装できます。

この「制約環境で動作すること」は、クラウド前提の設計が主流となった現在でも、レガシーシステムや小規模プロジェクトでは依然として重要な要素です。

ここで、統合の観点を整理すると以下のようになります。

| 観点 | PHPの特徴 | 実務的影響 |

|---|---|---|

| 実行モデル | リクエスト単位の同期処理 | シンプルな設計が可能 |

| 環境依存性 | 低い(標準搭載が多い) | 導入コスト削減 |

| システム統合 | 同一言語で完結 | 保守性向上 |

| 拡張性 | 外部連携は限定的 | 大規模分散には不向き |

この表からも分かる通り、PHPは高性能な分散スクレイピング基盤を構築する用途には適していません。

しかし、業務システム内に組み込まれる軽量なデータ収集モジュールとしては、極めて合理的な設計を実現できます。

さらに、PHPの強みは「既存資産との整合性」にあります。

例えばECサイトや社内管理ツールでは、スクレイピング結果を即座に画面表示やバッチ処理に利用する必要がありますが、その際に異なる言語間でのデータ変換を挟まないことは、バグ発生率の低減にも直結します。

また、運用面ではデバッグの容易さも重要です。

PHPはリクエスト単位で実行されるため、ログ追跡が比較的シンプルであり、問題の切り分けが容易です。

これは長期運用において無視できない要素です。

結論として、PHPのスクレイピングは単なる技術選択ではなく、「既存Webシステムとどの程度密接に統合するか」という設計判断に依存します。

2026年の現在でも、統合性と運用性を重視する環境においては、PHPは依然として現役の実用技術として位置づけられています。

PHPスクレイピング実装とライブラリ活用(Guzzle・DOM操作・Panther)

PHPでスクレイピングを実装する際の本質は、「どのライブラリを使うか」という選択以上に、「どのレイヤーで処理を分担するか」という設計にあります。

特に2026年の実務環境では、単一ライブラリで完結させるというよりも、HTTP通信・HTML解析・ブラウザ自動化を役割分担しながら組み合わせる構成が一般的です。

まずHTTPクライアントとして代表的なのがGuzzleです。

Guzzleは単なるHTTPリクエストライブラリではなく、ミドルウェア的な設計を持っているため、リトライ制御や非同期リクエストにも対応できます。

スクレイピングにおいては、安定したレスポンス取得の基盤として機能します。

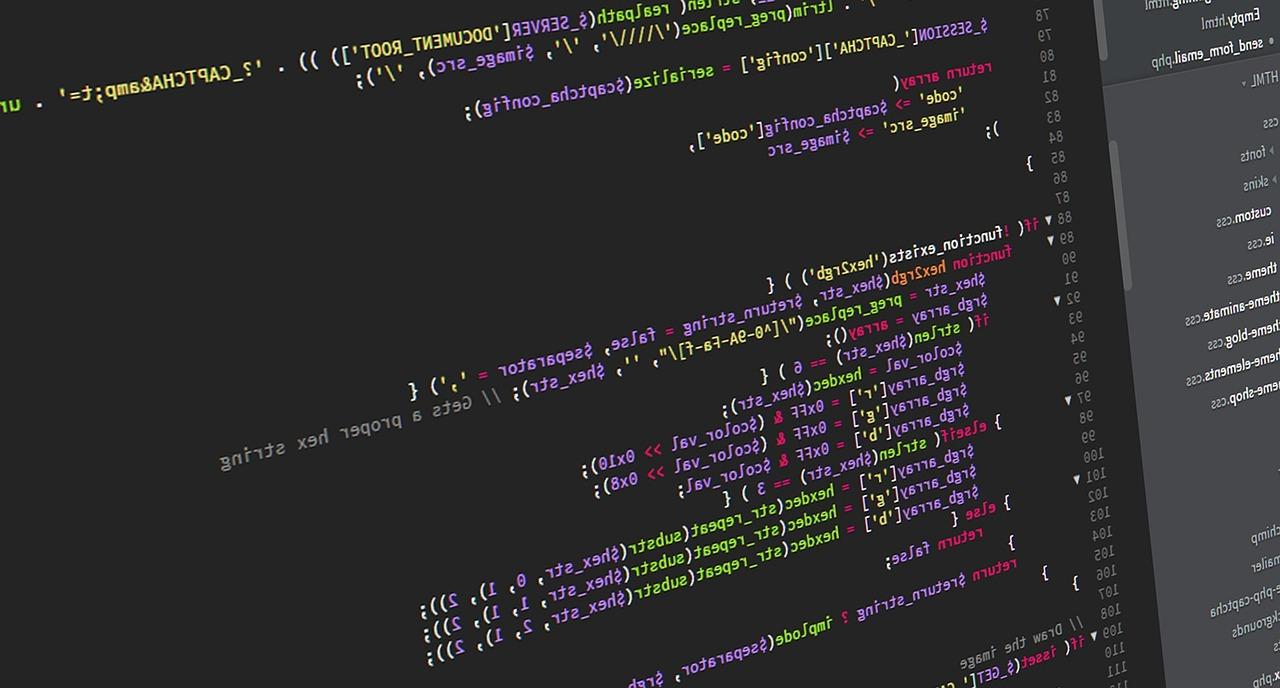

例えば基本的な取得処理は以下のようになります。

$client = new \GuzzleHttp\Client([

'timeout' => 10,

'headers' => [

'User-Agent' => 'Mozilla/5.0'

]

]);

$response = $client->request('GET', 'https://example.com');

$html = (string) $response->getBody();

この段階ではまだ「データ取得」に過ぎず、構造化は行われていません。

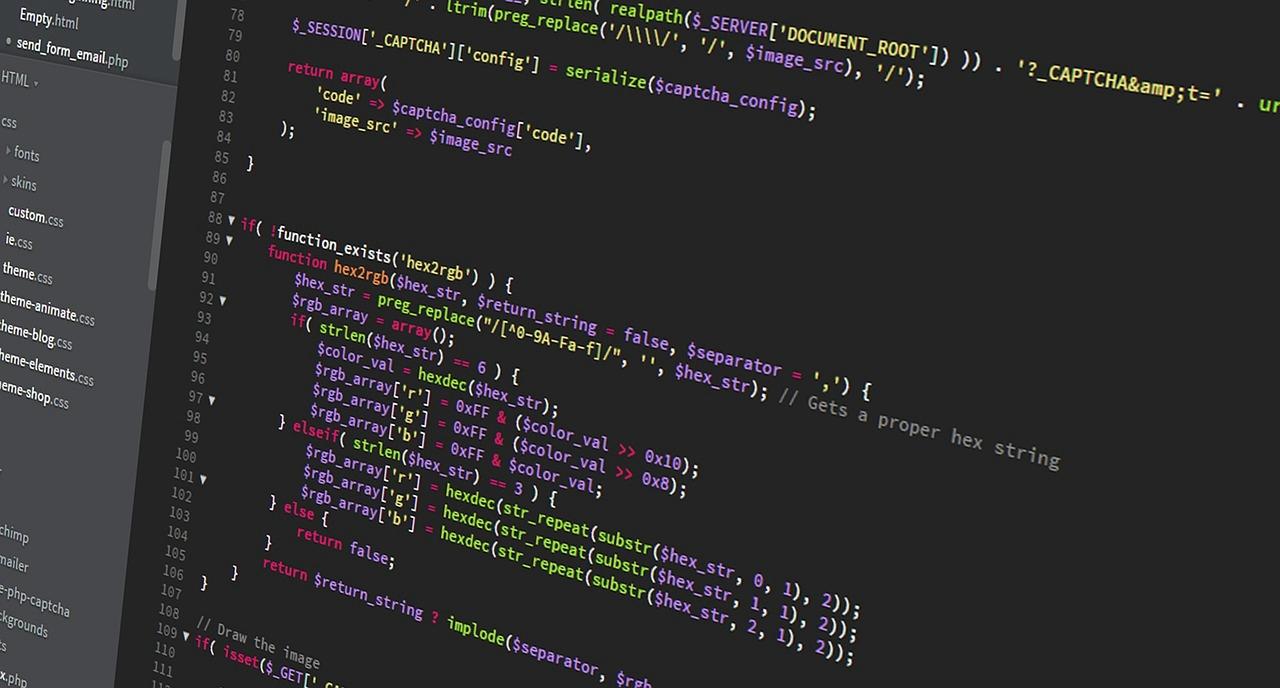

次に重要になるのがDOM操作です。

PHPではDOMDocumentとDOMXPathが標準的な選択肢となりますが、ここではHTMLをツリー構造として解析し、必要なノードを抽出する工程に移ります。

この処理はスクレイピングの中核であり、単なる文字列処理とは明確に区別する必要があります。

例えばタイトル要素の抽出は次のように行われます。

$dom = new DOMDocument();

libxml_use_internal_errors(true);

$dom->loadHTML($html);

$xpath = new DOMXPath($dom);

$titleNodes = $xpath->query('//title');

$title = $titleNodes->length > 0 ? $titleNodes->item(0)->nodeValue : null;

この段階で初めて、非構造データであるHTMLが意味のある情報として扱える状態になります。

しかし現代のWebサイトは静的HTMLだけで構成されているとは限りません。

SPA(Single Page Application)の普及により、JavaScriptによって後からDOMが生成されるケースが増えています。

この問題を解決するために用いられるのがPantherです。

PantherはSymfonyエコシステムの一部として提供されるブラウザ自動化ツールであり、実際のブラウザ環境を起動してレンダリング後のDOMを取得できます。

これにより、JavaScript依存のページでもスクレイピングが可能になります。

例えばPantherを用いた処理は以下のようになります。

use Symfony\Component\Panther\Client;

$client = Client::createChromeClient();

$crawler = $client->request('GET', 'https://example.com');

$content = $crawler->filter('h1')->text();

このアプローチの重要な点は、単なるHTTP取得ではなく「ブラウザとしての振る舞い」を再現している点です。

ここで三つの主要コンポーネントの役割を整理すると、設計の全体像が明確になります。

| コンポーネント | 役割 | 適用領域 |

|---|---|---|

| Guzzle | HTTP通信制御 | 静的ページ取得 |

| DOMDocument | HTML解析 | 構造化データ抽出 |

| Panther | ブラウザ自動化 | 動的サイト対応 |

このように、それぞれが明確な責務を持つことで、PHPスクレイピングは単一機能のスクリプトから、複数レイヤーを持つデータ収集システムへと発展します。

特に実務では、GuzzleとDOM操作だけで十分なケースが多く存在します。

これは多くのWebサイトが依然としてサーバーサイドレンダリングをベースにしているためです。

一方で、フロントエンドが完全に分離されたモダン構成ではPantherのようなブラウザレベルのツールが必要になります。

重要なのは、これらを「どれを使うか」ではなく「どの順序で組み合わせるか」という設計視点です。

まずHTTPで取得し、必要ならDOM解析を行い、それでも不足する場合にブラウザ自動化を導入するという段階的なアプローチが、現実的かつ保守性の高い構成になります。

このようにPHPスクレイピングの実装は、単なるコード記述ではなく、ライブラリの役割分担を前提としたアーキテクチャ設計そのものだと言えます。

スクレイピング性能とスケーラビリティの限界と改善策

スクレイピングを実務システムとして運用する際、最も見落とされがちでありながら本質的に重要なのが性能とスケーラビリティの問題です。

PHPを含む多くの言語でスクレイピングを実装すること自体は比較的容易ですが、それを安定した形で大規模運用に耐えさせる段階になると、設計上の制約が顕著に現れます。

まず理解すべきなのは、スクレイピング処理は本質的にI/Oバウンドであるという点です。

CPU負荷よりもネットワーク待機時間が支配的であり、単純な高速化では解決できない構造を持っています。

そのため、スケーラビリティの議論はアルゴリズム最適化よりも並列化とリクエスト制御に依存します。

PHPの場合、標準的な実行モデルはリクエスト単位の同期処理であるため、大量リクエストを逐次的に処理すると明確にスループットの限界が現れます。

この制約を突破するためには、アーキテクチャレベルでの工夫が必要になります。

代表的な改善アプローチとしては、並列実行の導入、キューイングシステムの利用、そしてキャッシュ戦略の三つが中心となります。

特にキューイングはスケーラビリティの中核であり、リクエスト処理を非同期化することで負荷分散を実現できます。

例えば設計の概念としては以下のような構造になります。

- スクレイピングジョブをキューに投入

- ワーカープロセスが並列で処理

- 結果をデータベースに保存

- フロントエンドはキャッシュから参照

この構造により、リクエストの集中によるボトルネックを回避できます。

また、性能面での制約を整理すると以下のようになります。

| 要因 | PHP単体の制約 | 影響 |

|---|---|---|

| 同期処理 | 並列実行が標準でない | スループット低下 |

| メモリ管理 | プロセス単位で消費 | 大規模処理で負荷増加 |

| ネットワーク待機 | ブロッキング処理 | レイテンシ増大 |

このような制約はPHPに限ったものではありませんが、Node.jsやPythonのasyncモデルと比較すると、設計思想の違いとして顕著に現れます。

一方で、スケーラビリティの改善は必ずしも言語変更を意味しません。

PHPでも工夫次第で十分な拡張性を確保できます。

特に重要なのは「処理を分解する」という設計原則です。

単一スクリプトで全てを処理するのではなく、取得・解析・保存を独立したプロセスとして分離することで、負荷を水平に拡張できます。

さらにキャッシュ戦略も重要な要素です。

同一URLへの重複リクエストを防ぐことで、ネットワークコストと処理時間を大幅に削減できます。

特にスクレイピング対象が定期更新されるサイトである場合、差分取得の設計を導入することが性能改善に直結します。

また、クラウド環境ではコンテナオーケストレーションを用いることでスケーリングが容易になります。

例えばワーカー数を動的に増減させることで、負荷に応じた柔軟な処理能力を確保できます。

ただしこの場合でも、PHPの役割はあくまで「実行単位としての軽量ワーカー」であり、基盤そのものではありません。

重要なのは、スクレイピングの性能問題は単一技術では解決できないという点です。

ネットワーク設計、データ保存方式、ジョブ管理、キャッシュ戦略が統合的に機能する必要があります。

結論として、PHPスクレイピングにおけるスケーラビリティの限界は確かに存在しますが、それは致命的な制約ではありません。

むしろ設計を適切に分割し、非同期的な処理構造を導入することで、多くの実務要件は十分に満たすことができます。

法的リスクとセキュリティを考慮したクローリング設計

スクレイピングやクローリングを実務に組み込む際、性能や実装技術と同等、あるいはそれ以上に重要になるのが法的リスクとセキュリティ設計です。

特に2026年の現在では、Webサービス側の防御機構が高度化しており、単純な技術的可否だけでなく、倫理的・法的な観点を含めた設計判断が求められます。

まず前提として理解すべきなのは、Web上のデータは「自由に取得できるもの」と「取得が制限されているもの」が明確に分かれているという点です。

多くのサイトでは利用規約やrobots.txtによってクローリングポリシーが定義されており、これを無視したアクセスは法的リスクを伴う可能性があります。

特に商用利用を前提とする場合、この境界線の理解は不可欠です。

セキュリティの観点では、スクレイピング処理が外部リソースへの大量アクセスを伴うため、対象サイトに対する負荷攻撃と誤認されるリスクがあります。

そのため、リクエスト頻度の制御やユーザーエージェントの適切な設定は基本的な要件となります。

また、認証が必要なサイトへのアクセスでは、トークン管理やセッション維持の設計が不十分だと情報漏洩の原因となる可能性もあります。

PHPでクローリングを実装する場合でも、単純にHTTPリクエストを送るだけではなく、セキュリティレイヤーを意識した設計が必要です。

例えば、リクエストヘッダーを適切に制御することは、サーバー側に不審なアクセスと判断されるリスクを低減する基本的な手段です。

$client = new \GuzzleHttp\Client([

'headers' => [

'User-Agent' => 'Mozilla/5.0 (compatible; DataCollector/1.0)',

'Accept-Language' => 'ja,en;q=0.8'

],

'timeout' => 10

]);

このような設定は技術的には単純ですが、実運用では重要な意味を持ちます。

特にUser-Agentの明示は、アクセス元の意図を示す一種の「透明性確保」として機能します。

また、セキュリティ設計においては、取得したデータの取り扱いも重要です。

スクレイピング結果には個人情報や機微なデータが含まれる可能性があり、それらを適切に処理しない場合は情報漏洩リスクが発生します。

データ保存時には暗号化やアクセス制御を導入することが望ましく、特にクラウド環境ではIAM設計との連携が不可欠です。

さらに、クローリングの設計において見落とされがちなのがレートリミットの遵守です。

対象サーバーへの過剰なリクエストはサービス拒否状態を引き起こす可能性があり、これは技術的問題ではなく運用上の責任問題に発展する場合があります。

そのため、一定間隔でのリクエスト制御や指数バックオフの導入は、安定運用のための基本設計となります。

法的リスクとセキュリティを整理すると、以下のような観点に分解できます。

| 観点 | 内容 | リスク |

|---|---|---|

| 利用規約 | サイトごとのアクセス制限 | 法的問題 |

| アクセス頻度 | レート制御の有無 | サーバー負荷 |

| データ管理 | 個人情報の扱い | 情報漏洩 |

| 認証管理 | トークン・セッション | 不正アクセス |

このように、クローリング設計は単なる技術実装ではなく、リスクマネジメントの一部として扱う必要があります。

特に重要なのは「取得できるか」ではなく「取得してよいか」という判断軸です。

この視点を欠いた設計は、短期的には動作しても長期的にはシステム全体の信頼性を損なう可能性があります。

結論として、PHPスクレイピングに限らず、すべてのクローリング設計は法的コンプライアンスとセキュリティ制御を前提に構築されるべきです。

技術的な実装力だけでなく、運用責任を含めた設計思考が求められる領域であると言えます。

CMS連携や業務自動化におけるPHPスクレイピング活用事例

PHPスクレイピングの実務的な価値を最も明確に理解できる領域が、CMS連携や業務自動化の文脈です。

特に2026年のWebシステム環境では、コンテンツ管理と外部データ取得を統合するニーズが増加しており、PHPはその中間層として安定した役割を果たしています。

まずCMS連携の観点では、WordPressや独自CMSに対して外部情報を自動的に取り込む用途が典型的です。

例えばニュースサイトや価格比較サイトでは、外部Webサイトから取得した情報を定期的に記事や商品データとして反映する必要があります。

このときPHPを用いることで、CMS内部のデータ構造とスクレイピング処理を同一言語で扱えるため、変換処理が最小化されます。

業務システムにおいても同様に、外部サービスからのデータ収集をPHPで実装するケースは多く存在します。

特にCSV出力やAPI連携が不十分なレガシーシステムに対しては、スクレイピングが事実上のデータ連携手段として機能することがあります。

このような状況では、正式なAPIが存在しないという制約を補完する役割としてPHPスクレイピングが利用されます。

例えば業務自動化の典型例としては、以下のような処理フローが挙げられます。

$client = new \GuzzleHttp\Client();

$response = $client->get('https://example.com/data');

$dom = new DOMDocument();

libxml_use_internal_errors(true);

$dom->loadHTML((string)$response->getBody());

$xpath = new DOMXPath($dom);

$items = $xpath->query('//div[@class="item"]');

foreach ($items as $item) {

$data[] = $item->nodeValue;

}

file_put_contents('cache.json', json_encode($data, JSON_UNESCAPED_UNICODE));

このように、取得から解析、保存までをPHP単体で完結できる点は、業務自動化の観点で非常に重要です。

外部ツールや別言語を介さないため、障害ポイントが少なく、運用の予測可能性が高まります。

CMS連携における構造を整理すると、PHPスクレイピングは単なるデータ取得ではなく「コンテンツ生成パイプラインの一部」として機能します。

具体的には、外部データを取得し、それをCMSの投稿データやカスタムフィールドに変換して登録する役割を担います。

このとき重要なのは、データの正規化とスキーマ変換をPHP側で吸収できる点です。

また、業務自動化の文脈では定期実行との相性も重要です。

cronジョブと組み合わせることで、毎日あるいは毎時間単位でデータ更新を自動化できます。

これにより、人手による更新作業を削減し、人的ミスを排除することが可能になります。

CMS連携と業務自動化の観点を整理すると以下のようになります。

| 領域 | PHPスクレイピングの役割 | 主な効果 |

|---|---|---|

| CMS連携 | 外部データの投稿変換 | コンテンツ自動生成 |

| 業務自動化 | 定期データ収集 | 手作業削減 |

| データ統合 | スキーマ変換処理 | システム統一性向上 |

| バッチ処理 | 定時実行スクリプト | 運用効率化 |

このようにPHPスクレイピングは、単体で完結する技術というよりも、既存システムの延長として機能する点に価値があります。

さらに重要なのは、こうした連携処理ではパフォーマンスよりも安定性が優先されるという点です。

リアルタイム性が求められないケースでは、多少の遅延よりも確実なデータ取得と整合性が重視されます。

この特性はPHPの同期処理モデルと非常に相性が良いと言えます。

結論として、CMS連携や業務自動化の領域においてPHPスクレイピングは依然として実用的な選択肢です。

特に既存システムとの統合を前提とした場合、そのシンプルな構造と運用容易性は、他の複雑な技術スタックでは代替しにくい価値を持っています。

まとめ:PHPスクレイピングは2026年でも現役技術なのか

2026年の現在において、PHPスクレイピングは「古い技術か、それとも現役か」という二項対立で語るべきものではなく、適用領域によって評価が変わる実用技術として位置づけるのが妥当です。

スクレイピング技術そのものはPythonやJavaScriptの発展によって高度化しましたが、その一方でPHPが担う役割はむしろ明確化されています。

本記事で一貫して述べてきたように、PHPの強みは単体の性能や機能の豊富さではなく、既存Webシステムとの統合性にあります。

特にCMSや業務システムがPHPベースで構築されている環境では、スクレイピング機能を追加する際に言語スタックを統一できることは、設計上の大きな利点になります。

これは単なる開発効率の問題ではなく、運用保守や障害対応の容易さに直結する要素です。

また、スクレイピングの本質が「データ取得」ではなく「データ統合」にあることを考えると、PHPの役割はより明確になります。

取得したデータをそのままWebアプリケーションに流し込む構造を持つ場合、PHPは中間変換層として非常に効率的に機能します。

これはETLパイプラインの簡易実装としても捉えることができ、複雑なデータ基盤を必要としない環境では十分な実用性を持ちます。

一方で、技術的限界が存在することも事実です。

非同期処理や大規模分散クローリング、あるいはJavaScriptレンダリング前提の高度な動的サイトに対しては、PHP単体では明らかに不利です。

しかし重要なのは、これらの領域がすべてのプロジェクトで必要とされるわけではないという点です。

むしろ多くの業務システムでは、安定性と保守性の方が優先されます。

技術選定の観点を整理すると、PHPスクレイピングの位置づけは以下のように理解できます。

| 観点 | PHPスクレイピングの評価 | 実務的意味 |

|---|---|---|

| 統合性 | 非常に高い | 既存CMSと直接連携可能 |

| 性能 | 中程度 | 小〜中規模向け |

| 拡張性 | 限定的 | 分散処理には不向き |

| 保守性 | 高い | 単一言語構成が可能 |

この表からも明らかなように、PHPは最先端のスクレイピング基盤を構築するための言語ではなく、既存システムに自然に組み込むための実用言語です。

この役割を正しく理解することが、技術選定において重要になります。

さらに、クラウドネイティブ化が進んだ現在でも、すべてのシステムがマイクロサービス化されているわけではありません。

依然としてモノリシックなPHPアプリケーションは多く存在し、それらを全面的に再構築するコストは現実的ではありません。

この文脈において、スクレイピング機能をPHPで追加することは、合理的な延命戦略として機能します。

結論として、PHPスクレイピングは「最新技術ではないが、現場では依然として必要とされる技術」です。

その価値は性能競争ではなく、統合容易性と運用安定性にあります。

したがって2026年においても、適切な条件下では十分に現役技術として採用され続けると考えるのが合理的です。

コメント