科学や工学の現場において、かつては分野ごとに異なる計算環境やツールが乱立していました。

しかし現在では、Pythonがその境界を越え、「科学の共通言語」として広く受け入れられつつあります。

物理学、機械学習、統計解析、バイオインフォマティクスといった多様な領域で、同じ言語が使われているという状況は、過去には考えにくいものでした。

その背景には、単なるプログラミング言語としてのPythonの使いやすさだけではなく、強力な数値計算ライブラリ群の存在があります。

特にNumPyを起点としたエコシステムは、科学計算の標準的な基盤として機能し始めています。

この流れを理解するためには、次のようなポイントを押さえる必要があります。

- なぜPythonが「書きやすさ」以上の価値を持つようになったのか

- NumPyがもたらした配列計算モデルの革新

- SciPyやPandasなどへの自然な拡張構造

- 研究と産業の境界を溶かしたエコシステム設計

これらは単なるライブラリの寄せ集めではなく、設計思想として一貫性を持っています。

特にNumPyの登場は、従来の低レベルな数値計算から、抽象化された高性能計算への転換点でした。

本記事では、Pythonがどのようにして科学分野の共通基盤へと進化したのかを、ライブラリの系譜とともに論理的に整理していきます。

単なる歴史の紹介ではなく、なぜその設計が受け入れられたのかという観点から解き明かしていきます。

Pythonが科学の共通言語になった背景とその必然性

Pythonが科学分野における共通言語として広く受け入れられるようになった背景には、単なる「書きやすいプログラミング言語」という評価を超えた、構造的な必然性があります。

科学計算の現場では、かつてCやFortranのような低レベル言語が主流でしたが、それらは高性能である一方、抽象化の欠如によって研究者の思考コストを増大させていました。

その状況を大きく変えたのが、Pythonの「表現力」と「拡張性」のバランスです。

特に以下の3点が重要な転換点となっています。

- シンタックスがシンプルで、数式的思考と親和性が高い

- CやC++で実装された高速ライブラリを容易に呼び出せる

- 科学分野ごとのニーズに応じてエコシステムが自然に拡張された

この設計思想は、単なる偶然ではなく「科学者がコードを書く」のではなく「コードが科学的思考を支援する」という方向性に一致していました。

また、Pythonの普及を加速させた要因として、研究現場におけるワークフローの変化があります。

従来の科学計算は以下のような流れでした。

| フェーズ | 従来の手法 | Python導入後 |

|---|---|---|

| 実装 | C/Fortran | Python + NumPy |

| 可視化 | 外部ツール | matplotlib等 |

| 解析 | スクリプト分断 | Notebook統合 |

| 再現性 | 低い | 高い |

この変化により、研究の「実装」「実験」「可視化」が一つの環境に統合され、科学計算そのものの生産性が飛躍的に向上しました。

さらに重要なのは、Pythonが「科学者のために設計された言語ではない」という点です。

むしろ一般用途のスクリプト言語として誕生したにもかかわらず、後付けで科学計算に最適化されていったという逆説的な進化を遂げています。

この点が、RやMATLABのようなドメイン特化型言語との大きな違いです。

例えばNumPyの登場は、その象徴的な出来事です。

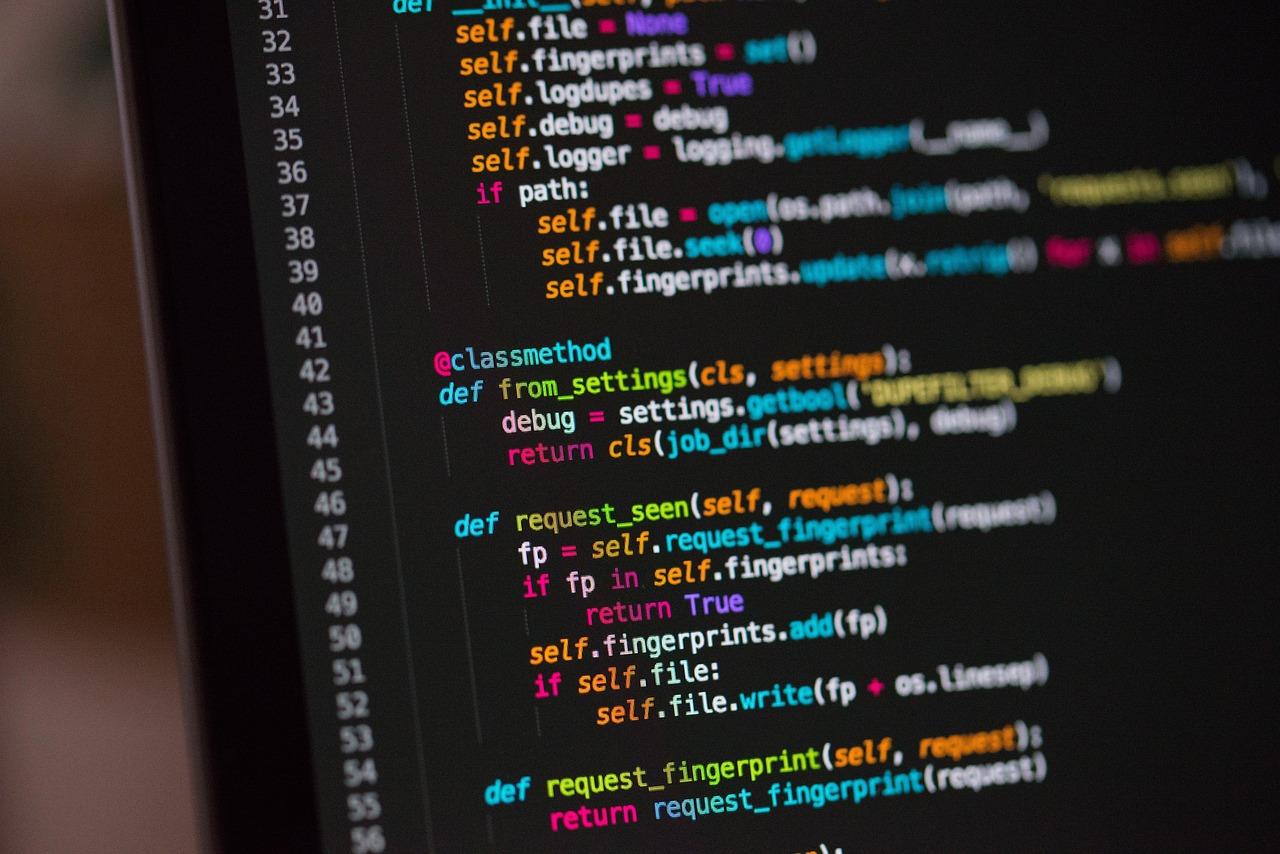

import numpy as np

a = np.array([1, 2, 3])

b = np.array([4, 5, 6])

c = a + b

print(c)

このコードは一見単純ですが、内部ではCレベルの最適化が行われており、Pythonは「制御レイヤー」に徹しています。

この設計により、ユーザーは低レイヤーの実装詳細を意識することなく、高速な数値計算を実行できるようになりました。

また、科学分野では再現性が極めて重要です。

PythonはJupyter Notebookのような環境と組み合わさることで、「実行可能な論文」という新しい形態を生み出しました。

これは単なるコード実行環境ではなく、計算過程そのものをドキュメント化する仕組みです。

結果として、Pythonは次のような性質を持つようになりました。

- 研究者の思考プロセスとコードが一致する

- 実験と記録が同一空間で行われる

- コミュニティ主導でライブラリが進化する

このように、Pythonが科学の共通言語となった理由は「便利だから」という単純な話ではありません。

むしろ、科学計算に必要な抽象度・性能・拡張性のバランスが偶然にも最適点に収束した結果であり、その構造的必然性こそが本質です。

NumPyがもたらした配列計算モデルの革命

NumPyの登場は、Pythonを単なるスクリプト言語から科学計算の中核へと押し上げた決定的な転換点です。

それ以前のPythonは柔軟ではあるものの、数値計算においては性能面で明確な制約を抱えていました。

特にループ処理中心の実装では、CやFortranに対して桁違いに遅いという問題があり、科学技術計算の現場では実用性に限界があったのです。

NumPyが導入した最大の革新は、配列を第一級オブジェクトとして扱う設計思想です。

これは単なるデータ構造の追加ではなく、計算モデルそのものの再定義でした。

従来の「要素ごとに処理する」発想から、「配列全体に対して演算を適用する」というベクトル化された思考へと転換させた点が本質です。

この違いはコードを見ると明確になります。

import numpy as np

a = np.array([1, 2, 3, 4])

b = np.array([10, 20, 30, 40])

c = a * b

print(c)

このわずかなコードの背後では、PythonのループではなくCで最適化された内部処理が動作しています。

つまりNumPyは「Pythonで書くが、実行はCレベルで行う」というハイブリッド構造を確立したのです。

この設計がもたらした影響は極めて大きく、科学計算のパラダイム自体が変化しました。

従来の手続き的な記述から、数学的表現に近い形での記述へと移行したことが重要です。

例えば、行列演算を考えるとその差は顕著です。

| 観点 | 従来の実装 | NumPy |

|---|---|---|

| 記述方法 | ループ中心 | ベクトル演算 |

| 可読性 | 低い | 高い |

| 実行速度 | 遅い | 高速 |

| 抽象度 | 低レベル | 高レベル |

このように、NumPyは単なるライブラリではなく「計算の抽象化レイヤー」として機能しています。

さらに重要なのは、NumPyが提供する「ブロードキャスト」という仕組みです。

これは異なる形状の配列同士でも、暗黙的に拡張して演算を可能にする仕組みであり、科学計算の柔軟性を大幅に向上させました。

この設計は一見すると直感的ですが、内部では非常に厳密なルールに基づいて動作しています。

例えば以下のような操作が可能です。

import numpy as np

a = np.array([[1, 2, 3],

[4, 5, 6]])

b = np.array([10, 20, 30])

c = a + b

print(c)

この場合、bは自動的に各行へ拡張され、行列全体に対して加算が適用されます。

この仕組みにより、コード量を削減しつつも数学的表現に近い記述が可能になっています。

NumPyのもう一つの重要な側面は、メモリレイアウトの最適化です。

Pythonのリストがポインタの集合であるのに対し、NumPy配列は連続したメモリ領域にデータを格納します。

これによりキャッシュ効率が向上し、CPUのベクトル演算機構を最大限に活用できるようになっています。

この設計思想は科学計算において極めて重要であり、大規模データ処理やシミュレーションの性能を根本から改善しました。

単なる高速化ではなく、ハードウェア特性に適合した抽象化である点が本質です。

結果としてNumPyは、Pythonを科学計算の「制御言語」へと変貌させました。

研究者はアルゴリズムの詳細実装ではなく、数理モデルそのものに集中できるようになり、これは科学研究の生産性に直接的な影響を与えています。

NumPyの革新は、単なるライブラリの成功ではなく、計算モデルの再定義そのものだったと言えます。

SciPy・Pandasへと続くPython科学計算ライブラリエコシステム

NumPyが配列計算の基盤を確立した後、Pythonの科学計算エコシステムは急速に拡張されました。

その中心にあるのがSciPyとPandasです。

これらは単体のライブラリというよりも、NumPyを中核とした階層的な設計の上に構築された「科学計算スタック」として理解するのが適切です。

まずSciPyは、NumPyの上に構築された高度な数値解析ライブラリ群です。

線形代数、最適化、信号処理、統計解析など、科学技術計算で頻繁に必要とされるアルゴリズムを体系的に提供しています。

重要なのは、SciPyが独自に低レベル実装を抱えるのではなく、既存のC/FortranライブラリをラップしながらPythonインターフェースを統一している点です。

この設計により、性能と抽象化の両立が実現されています。

一方でPandasは、科学計算というよりも「データ解析」に特化したライブラリですが、その役割は極めて重要です。

特にCSVやSQLのような構造化データを扱う現場において、データフレームという抽象化は革命的でした。

import pandas as pd

data = {

"temperature": [22.1, 23.5, 21.8],

"humidity": [60, 55, 63]

}

df = pd.DataFrame(data)

print(df.describe())

このように、Pandasは表形式データを直感的に扱えるインターフェースを提供し、統計処理や前処理の効率を大幅に向上させました。

SciPyとPandasの登場によって形成されたエコシステムは、単なるライブラリの集合ではなく、明確な階層構造を持っています。

この構造を整理すると以下のようになります。

| レイヤー | 役割 | 主なライブラリ | 特徴 |

|---|---|---|---|

| 基盤層 | 配列計算 | NumPy | 高速なベクトル演算 |

| 数値解析層 | 数学アルゴリズム | SciPy | 最適化・統計・信号処理 |

| データ処理層 | データ操作 | Pandas | 表形式データ処理 |

| 可視化層 | グラフ生成 | Matplotlib等 | 結果の可視化 |

この階層構造の重要な点は、それぞれが独立しながらも密接に連携していることです。

例えばPandasは内部でNumPy配列を利用し、SciPyはNumPyの配列構造を前提にアルゴリズムを実装しています。

この依存関係が、統一された計算基盤としてのPythonを成立させています。

また、このエコシステムの特徴として「再利用性の高さ」が挙げられます。

従来の科学計算環境では、分野ごとに独自のツールチェーンが存在し、コードの再利用は困難でした。

しかしPythonでは共通の基盤が存在するため、異なる分野間でもコード資産が流通します。

例えば機械学習の前処理で作成されたPandasのデータ操作ロジックは、そのまま物理シミュレーションや経済データ分析に転用可能です。

この汎用性は、科学研究の生産性を大きく押し上げています。

さらに重要なのは、これらのライブラリが「個別に設計されたのではなく、コミュニティ主導で進化してきた」という点です。

SciPyやPandasは企業主導のプロダクトではなく、研究者やエンジニアの実務ニーズに基づいて拡張されてきました。

そのため、実際の科学現場で必要とされる機能が優先的に実装されるという特徴があります。

この結果として、Pythonの科学計算エコシステムは次のような性質を持つようになりました。

- 実務と研究の距離が極めて近い

- 新しいアルゴリズムが迅速に実装される

- 分野横断的な利用が容易である

SciPyとPandasの存在は、NumPy単体では達成できなかった「実務レベルの科学計算環境」を完成させました。

特にデータ駆動型科学が主流となった現代において、これらのライブラリは単なる補助ツールではなく、科学そのものの基盤として機能しています。

Pythonエコシステムの強さは、このような階層的かつ協調的な設計にこそ本質があります。

物理・機械学習・バイオインフォマティクスにおけるPython採用事例

Pythonが科学分野で広く採用されている理由を理解するためには、具体的な応用領域における実例を分析することが有効です。

特に物理学、機械学習、バイオインフォマティクスの3分野は、Pythonの汎用性とエコシステムの成熟度を最も明確に示しています。

これらの分野はそれぞれ異なる計算特性を持ちながらも、共通して「大量データの処理」「数値計算の高速化」「再現性の確保」という課題を抱えています。

まず物理学の領域では、数値シミュレーションが中心的な役割を果たします。

例えば流体力学や量子力学の計算では、微分方程式の数値解法が不可欠です。

PythonではSciPyを用いることで、これらの数値解析を比較的高い抽象度で記述できます。

from scipy.integrate import solve_ivp

import numpy as np

def model(t, y):

return -2 * y

sol = solve_ivp(model, [0, 10], [1])

print(sol.y)

このように、物理モデルをそのまま関数として表現できる点は、従来のFortranベースの実装と比較して大きな進歩です。

重要なのは、物理法則の記述と数値計算の実装がほぼ一致する点であり、これが研究の解釈性を高めています。

次に機械学習分野では、Pythonは事実上の標準言語となっています。

特にTensorFlowやPyTorchといったフレームワークがPythonインターフェースを採用したことで、研究と実装の距離が劇的に縮まりました。

この背景には、NumPyベースの配列操作との親和性が強く影響しています。

機械学習におけるデータ処理の流れを簡略化すると以下のようになります。

| フェーズ | 処理内容 | 使用ライブラリ | 特徴 |

|---|---|---|---|

| 前処理 | データ整形 | Pandas | 表形式操作 |

| 数値化 | 配列変換 | NumPy | 高速演算 |

| 学習 | モデル構築 | PyTorch | 自動微分 |

| 評価 | 精度検証 | scikit-learn | 汎用指標 |

このように、各工程がPythonエコシステム内で統一されているため、研究者はアルゴリズム設計に集中できます。

また、PyTorchのようなフレームワークでは、動的計算グラフが採用されており、実験的なモデル設計が容易です。

これは研究段階において非常に重要であり、試行錯誤のコストを大幅に削減します。

バイオインフォマティクスの分野では、Pythonの強みは特に「データ統合能力」に現れます。

DNA配列解析やタンパク質構造予測では、膨大かつ異質なデータを扱う必要があります。

ここでPandasやNumPyが中心的な役割を果たし、さらにBiopythonのような専門ライブラリが補完的に機能します。

例えば配列データの簡易処理は以下のように記述できます。

from Bio.Seq import Seq

dna = Seq("ATGCGTAC")

print(dna.complement())

このような抽象化により、生物学的概念とプログラムコードの距離が縮まり、研究効率が大幅に向上しています。

これら3分野に共通する本質的な特徴は、Pythonが単なる実装言語ではなく「科学的思考を直接表現する媒体」として機能している点です。

物理学では方程式、機械学習ではモデル構造、バイオインフォマティクスでは配列操作が、それぞれPythonの構文と自然に対応しています。

この対応関係を整理すると次のようになります。

| 分野 | Pythonの役割 | 中核概念 |

|---|---|---|

| 物理学 | 数値実装言語 | 微分方程式 |

| 機械学習 | モデル記述言語 | ニューラルネットワーク |

| バイオインフォマティクス | データ解析言語 | 配列・構造解析 |

このように、Pythonは各分野の抽象概念をそのままコードとして記述できるレベルにまで昇華させています。

結果として、Pythonの採用は単なる技術選定ではなく、科学研究の方法論そのものの変化を意味しています。

異なる分野が同一言語で接続されることにより、知識の流通速度が加速し、学際的研究が容易になりました。

これは科学における「共通言語」としてのPythonの本質的な価値を示しています。

Jupyter NotebookとVSCodeが支える再現性の高い研究環境

科学計算において再現性は極めて重要な要件です。

同じデータと同じ手法を用いた場合に、誰が実行しても同一の結果が得られることは、研究の信頼性を担保する基盤になります。

この要件をソフトウェア的に満たすための代表的な環境が、Jupyter NotebookとVSCodeです。

Jupyter Notebookは「計算と記録を一体化する」という点で従来の開発環境とは大きく異なります。

コード、実行結果、可視化、そして説明文が同一ファイル内に共存することで、研究プロセスそのものがドキュメント化されます。

これは単なる利便性ではなく、科学的方法論における透明性の向上に直結しています。

例えば以下のような形で、計算と結果の確認を同時に行えます。

import numpy as np

data = np.random.normal(0, 1, 1000)

print(np.mean(data))

このように、コードの実行結果が即座に確認できる構造は、仮説検証のサイクルを高速化します。

特に統計解析や機械学習の初期段階では、このインタラクティブ性が非常に重要です。

一方でVSCodeは、より大規模なプロジェクトや長期的な研究開発に適した統合開発環境です。

Jupyter Notebookが「思考の可視化」に優れているのに対し、VSCodeは「ソフトウェア工学的な構造化」に強みを持っています。

Python拡張やJupyter連携機能により、両者の境界はほぼ融合しています。

この2つの環境の役割を整理すると次のようになります。

| 環境 | 主な用途 | 特徴 | 強み |

|---|---|---|---|

| Jupyter Notebook | 実験・解析 | 対話的実行 | 可視化・試行錯誤 |

| VSCode | 開発・設計 | プロジェクト管理 | 拡張性・保守性 |

このように、同じPythonコードであっても利用環境によって役割が明確に分かれています。

特に重要なのは、これらの環境が「再現性」を技術的に支援している点です。

Notebookは実行順序を保持し、結果とコードを一体化することで、後からの検証を容易にします。

またVSCodeは仮想環境や依存関係管理と統合することで、環境差異による再現性の崩壊を防ぎます。

例えば仮想環境を用いたPythonプロジェクトは以下のように構成されます。

python -m venv env

source env/bin/activate

pip install numpy pandas scipy

この仕組みにより、依存ライブラリのバージョン差異を排除し、研究環境の統一が可能になります。

さらに近年では、両者の統合が進んでいます。

VSCode上でJupyter Notebookを直接実行できるようになり、研究と開発の境界はさらに曖昧になりました。

この統合は単なる利便性の向上ではなく、「実験から実装へのシームレスな移行」を実現する設計です。

この流れを整理すると、次のような構造が見えてきます。

- Jupyter Notebookは探索的分析を担う

- VSCodeは構造化された実装を担う

- 両者は同一Pythonエコシステム上で連携する

この関係性により、研究初期段階から本番実装までを一貫した環境で扱うことが可能になります。

結論として、Jupyter NotebookとVSCodeは単なるツールではなく、Python科学計算エコシステムにおける「再現性のインフラ」として機能しています。

研究者は環境構築やデータ管理の複雑さから解放され、より本質的な問題、すなわちモデルや仮説の設計に集中できるようになっています。

この構造こそが、現代の科学研究を支える重要な基盤です。

NumPy設計思想から見るPython科学計算スタックの内部構造

Pythonの科学計算スタックを理解するうえで、NumPyの設計思想を起点に内部構造を分解することは本質的に重要です。

NumPyは単なる配列ライブラリではなく、「計算の責務をPythonから切り離し、最適化された低レベル実装へ委譲する」という明確な設計哲学に基づいています。

この思想が後続のSciPyやPandas、さらには機械学習ライブラリ群にまで波及し、現在のエコシステムを形成しています。

まずNumPyの中心概念は「ndarray」です。

これはN次元配列を表すデータ構造であり、Pythonのリストとは根本的に異なります。

リストがポインタの集合であるのに対し、ndarrayは連続したメモリ領域に型付きデータを格納します。

この違いは性能面で決定的な差を生みます。

import numpy as np

a = np.array([1, 2, 3, 4])

print(a.dtype)

print(a.shape)

このように、NumPy配列は「型」と「形状」を明示的に持つことで、コンパイラ的最適化を可能にしています。

この設計が後のエコシステム全体の基盤となっています。

NumPyの設計思想を理解するためには、Python科学計算スタックの階層構造を俯瞰する必要があります。

現在の一般的な構造は以下のように整理できます。

| レイヤー | 役割 | 技術要素 | 特徴 |

|---|---|---|---|

| アプリケーション層 | 分析・研究 | Jupyter, スクリプト | 高レベル操作 |

| ライブラリ層 | 科学計算API | Pandas, SciPy | ドメイン抽象化 |

| 数値基盤層 | 配列演算 | NumPy | ベクトル化処理 |

| ネイティブ層 | 低レベル実装 | C, Fortran | 高速実行 |

この構造においてNumPyは中心的な役割を果たしており、上位層と下位層の橋渡しとして機能しています。

重要な設計原則の一つが「ベクトル化」です。

これはループ処理をPythonレベルで記述するのではなく、配列全体に対して一括で演算を適用する考え方です。

このアプローチにより、Pythonインタプリタのオーバーヘッドを回避し、Cレベルの高速処理を活用できます。

例えば以下のようなコードは典型的な例です。

import numpy as np

x = np.arange(0, 1000000)

y = x * 2 + 1

この処理は内部的にCループで最適化されており、Pythonのforループとは比較にならない速度で実行されます。

さらにNumPyの設計で重要なのは「ユニバーサル関数(ufunc)」です。

これは要素ごとの演算を高速に実行する仕組みであり、加算や乗算だけでなく、三角関数や指数関数なども統一的に扱います。

この設計により、数学的操作をそのままコードとして表現することが可能になります。

また、ブロードキャスト機構も内部構造の理解において欠かせません。

異なる形状の配列同士でも自動的に次元を拡張して演算を成立させるこの仕組みは、科学計算における柔軟性を大きく向上させています。

NumPyの設計思想は単独で完結しているのではなく、他のライブラリとの連携を前提としています。

SciPyはNumPy配列を入力として高度な数値解析を提供し、PandasはNumPy配列をデータフレームという抽象構造に拡張します。

この関係性は階層的でありながら相互依存的です。

特に重要なのは、すべてのライブラリが「NumPy配列を共通インターフェースとして扱う」という暗黙の標準に従っている点です。

この統一性がエコシステム全体の結合度を高めています。

結論として、NumPyの設計思想は単なる効率化技術ではなく、Python科学計算スタック全体のアーキテクチャを規定する基盤です。

配列中心の思考、ベクトル化、Cレベル最適化、そしてライブラリ間の統一インターフェースという要素が組み合わさることで、現在のPythonは単なるスクリプト言語ではなく、科学計算の統合基盤として機能しています。

RやMATLABとの比較で見えるPythonへの移行トレンド

科学計算の歴史を俯瞰すると、長らくRやMATLABが中心的な役割を担ってきました。

これらは特定領域に最適化された設計を持ち、統計解析や数値計算において高い完成度を誇っていました。

しかし近年、その立ち位置は徐々にPythonへと移行しつつあります。

この変化は単なる流行ではなく、計算基盤そのものの構造変化に起因しています。

まずRは統計解析に特化した言語として設計されており、統計モデルの記述力に優れています。

一方で、汎用プログラミング言語としての柔軟性には限界があり、大規模システム開発や他領域との統合には不向きな側面がありました。

MATLABは数値計算環境として非常に洗練されているものの、ライセンスコストや閉じたエコシステムが普及の制約となっていました。

これに対してPythonは、設計段階から科学計算に特化していたわけではありません。

しかし結果として、汎用言語としての柔軟性と科学計算ライブラリの充実が結びつき、独自のポジションを確立しました。

この3言語の特性を整理すると、次のようになります。

| 言語 | 主な用途 | 強み | 制約 |

|---|---|---|---|

| R | 統計解析 | 統計モデル表現力 | 汎用性の低さ |

| MATLAB | 数値計算 | 行列演算・可視化 | ライセンス依存 |

| Python | 汎用計算 | 拡張性・エコシステム | 初期性能は外部依存 |

この比較から明らかなように、Pythonは単体性能ではなく「統合性」で優位性を持っています。

特に重要な転換点は、Pythonが科学計算領域でCやFortran製ライブラリを積極的に取り込んだ点です。

NumPyを中心としたエコシステムにより、低レベルの高速処理と高レベルの記述性を両立する構造が実現されました。

これにより、従来RやMATLABが担っていた領域を徐々に侵食していきました。

例えば行列演算においては、Pythonでは以下のように記述されます。

import numpy as np

A = np.array([[1, 2], [3, 4]])

B = np.array([[5, 6], [7, 8]])

C = np.dot(A, B)

print(C)

このような記述はMATLABと非常に近い表現性を持ちながら、Pythonのエコシステム全体と連携できる点が決定的に異なります。

また移行トレンドを加速させた要因として、機械学習とデータサイエンスの台頭があります。

特にTensorFlowやPyTorchといったフレームワークがPythonベースで構築されたことで、研究と実装の中心がPythonに集約されました。

これにより、従来RやMATLABで行われていた分析業務もPythonへと吸収される流れが生まれました。

さらにクラウド環境との親和性も重要な要素です。

PythonはDockerやJupyter環境と容易に統合でき、スケーラブルな計算環境を構築しやすいという特徴があります。

これはローカル環境中心だったMATLABやRに対する大きな優位性です。

もう一つの本質的な違いは「エコシステムの開放性」です。

RはCRAN、MATLABは公式ツールボックス中心の管理構造ですが、PythonはGitHubを中心とした分散的なOSSエコシステムによって成長しています。

この違いは開発速度と適応力に直結します。

結果として、科学計算の現場では次のような変化が起きています。

- 統計解析はRからPython(Pandas, SciPy)へ移行

- 数値シミュレーションはMATLABからNumPy/SciPyへ移行

- 機械学習はPythonが完全に主流化

結論として、Pythonへの移行トレンドは単なる技術選好の問題ではなく、科学計算の構造そのものの変化を反映しています。

言語単体の性能ではなく、エコシステム全体の統合性と拡張性が評価軸となった結果、Pythonが中心的な位置を占めるようになったと理解するのが適切です。

この流れは今後も継続し、科学計算の標準基盤としてのPythonの地位はさらに強固なものになっていくと考えられます。

OSSとGitHubコミュニティが支えるPythonエコシステムの進化

Pythonが科学計算やデータサイエンスの中核言語として定着した背景には、言語仕様そのものの優秀さだけではなく、OSS(オープンソースソフトウェア)文化とGitHubコミュニティの強い相互作用があります。

特にNumPyやPandas、SciPyといった基盤ライブラリは、単一企業の製品ではなく、世界中の開発者による共同作業の産物として進化してきました。

この構造を理解するうえで重要なのは、Pythonのエコシステムが「中央集権的な開発モデル」ではなく「分散協調型の開発モデル」で成り立っているという点です。

つまり特定の組織が仕様を一方的に決定するのではなく、現場の研究者やエンジニアが必要とする機能がコミュニティ駆動で実装されていきます。

GitHubの登場はこの流れを加速させました。

プルリクエストによるコードレビュー、Issueによる議論、CIによる自動テストといった仕組みは、科学計算ライブラリの品質と進化速度を大きく向上させています。

特にNumPyやPandasのようなプロジェクトでは、世界中の研究者が実際のユースケースを基に改善提案を行うため、実用性が極めて高い状態で維持されています。

例えばNumPyの開発では、単なる機能追加ではなく「数値計算におけるエッジケースの精密な議論」が日常的に行われています。

これは企業プロダクトとは異なる性質であり、科学的厳密性がそのままソフトウェア品質に直結する構造です。

Pythonエコシステムの特徴を整理すると、以下のような構造になります。

| 要素 | 役割 | 特徴 |

|---|---|---|

| GitHub | 開発基盤 | 分散型コラボレーション |

| OSSコミュニティ | 改善主体 | 実務駆動の機能追加 |

| パッケージ管理 | 配布基盤 | pipによる統一 |

| 科学ライブラリ群 | 実装層 | NumPy中心の依存構造 |

このように、Pythonの科学計算環境は単一の設計者によるものではなく、層状に積み重なった共同構築物として成立しています。

特に重要なのは「実務からのフィードバックループ」です。

研究者やデータサイエンティストが日常的にライブラリを使用し、その過程で見つかった問題点や改善案が即座にIssueとして報告されます。

そしてそれがGitHub上で議論され、コードとして反映されるという循環が成立しています。

このサイクルの速さが、Pythonエコシステムの進化速度を支えています。

例えばPandasでは、データフレーム操作の最適化やメモリ効率改善などが継続的に行われていますが、その多くは実際の大規模データ処理の現場からの要求に基づいています。

また、PythonのOSS文化は教育的側面も持っています。

ソースコードが完全に公開されているため、研究者や学生は実装の内部構造を学ぶことができます。

これは単なる利用者ではなく「貢献者としての参加」を促す構造であり、結果としてエコシステム全体の知識レベルを底上げしています。

さらに、PEP(Python Enhancement Proposal)の仕組みも重要です。

これは言語仕様やライブラリ設計に関する提案を公開議論する制度であり、透明性の高い意思決定プロセスを実現しています。

この仕組みにより、Pythonは後方互換性と進化のバランスを保ちながら発展しています。

結論として、Pythonエコシステムの進化は技術的要因だけでなく、OSS文化とGitHubを中心とした社会的・組織的構造によって支えられています。

個々のライブラリの優秀さ以上に重要なのは、それらが開かれた協調環境の中で継続的に改善される仕組みそのものです。

この構造こそが、Pythonを科学計算の中心言語へと押し上げた本質的な要因です。

Pythonが科学の標準となった理由の総括

Pythonが科学計算の標準言語として位置付けられるようになった背景には、単一の技術的優位性ではなく、複数の要因が重層的に作用した結果があります。

言語設計、ライブラリエコシステム、コミュニティ構造、そして研究現場の実務要件が相互に影響し合い、結果として「科学の共通基盤」としての地位を確立しました。

まず第一に重要なのは、Pythonが持つ抽象化能力と実装容易性のバランスです。

低レベル言語のような性能制約を意識しながらも、高レベルな記述によってアルゴリズムを直感的に表現できる点は、科学者にとって極めて大きな利点です。

特にNumPyやSciPyの存在により、Pythonは単なるスクリプト言語から実用的な数値計算基盤へと進化しました。

次に、エコシステムの統一性が挙げられます。

科学計算においては、単一のツールではなく複数のライブラリが連携して機能する必要があります。

Pythonはこの点で非常に優れており、NumPyを中心とした配列計算基盤の上に、PandasやSciPy、scikit-learnといったライブラリが有機的に接続されています。

この構造は以下のように整理できます。

| レイヤー | 機能 | 代表技術 |

|---|---|---|

| 基盤層 | 数値演算 | NumPy |

| 解析層 | 数学処理 | SciPy |

| データ層 | 構造化処理 | Pandas |

| 応用層 | 機械学習 | scikit-learn |

この階層構造は、科学計算に必要な機能を過不足なく提供するだけでなく、各層が独立しながらも統一的に動作するという点で非常に合理的です。

さらに重要なのは、Pythonが「研究と実装の境界を消した」という点です。

Jupyter Notebookのような環境により、コード、可視化、説明文が統合され、研究プロセスそのものが再現可能な形で記録されるようになりました。

これにより、科学的再現性の問題がソフトウェア的に解決される方向へ進みました。

例えば以下のような構造は、従来の研究フローとは大きく異なります。

import numpy as np

import matplotlib.pyplot as plt

x = np.linspace(0, 10, 100)

y = np.sin(x)

plt.plot(x, y)

plt.show()

このように、計算と可視化が同一環境で完結することは、研究効率と理解度の両方を大きく向上させています。

また、Pythonの標準化を支えたもう一つの要因は、OSSコミュニティによる継続的な改善です。

GitHubを中心とした開発体制により、実務からのフィードバックが直接ライブラリに反映される構造が成立しています。

これにより、Pythonは理論的設計だけでなく実用的要求にも迅速に対応できる柔軟性を獲得しました。

さらに、機械学習やデータサイエンスの爆発的な発展もPythonの地位を決定づけました。

TensorFlowやPyTorchといった主要フレームワークがPythonを前提として設計されたことで、研究分野全体がPythonへと収束していきました。

最終的にPythonが科学の標準となった理由は、単一の革新ではなく次の要素の総和です。

- 高い抽象化能力と実装性能の両立

- NumPyを中心とした統一されたエコシステム

- 再現性を支える開発・実行環境の成熟

- OSSコミュニティによる継続的進化

- 機械学習分野の標準化による強制的普及

結論として、Pythonは「科学のために設計された言語」ではなく、「科学に適応し続けた結果として標準になった言語」です。

この適応性こそが本質であり、今後も新しい科学分野が登場するたびに、その中心的な計算基盤としてPythonは拡張され続けると考えられます。

コメント