データサイエンスの分野において、なぜPythonがこれほどまでに圧倒的な支持を集めているのかは、多くの開発者や研究者が一度は直面する疑問です。

統計解析や機械学習、データ可視化といった領域には多様な選択肢が存在するにもかかわらず、Pythonは事実上の標準言語として広く定着しています。

その背景には、単なる文法のシンプルさだけではなく、実務での生産性を飛躍的に高めるライブラリの豊富さという明確な理由があります。

特にデータサイエンス領域では、以下のような専用ライブラリが成熟している点が大きな強みです。

- 数値計算を効率化するNumPyやSciPy

- データ操作を直感的に行えるpandas

- 機械学習を容易に実装できるscikit-learn

- 高度な可視化を実現するMatplotlibやSeaborn

これらが統合的に利用できることで、データ取得から前処理、分析、モデル構築、可視化までを一貫して同一言語内で完結できます。

この点は、他のプログラミング言語と比較した際に大きな優位性となっています。

また、単にライブラリが多いというだけでなく、それぞれがコミュニティ主導で継続的に改善されている点も見逃せません。

研究レベルのアルゴリズムが比較的早い段階で実装として利用可能になるため、実務と学術の距離が近いのもPythonの特徴です。

本記事では、データサイエンスの現場においてPythonが選ばれ続ける理由を、技術的観点から体系的に整理していきます。

Pythonがデータサイエンスの標準言語になった理由と背景

データサイエンスの分野においてPythonが事実上の標準言語として定着した背景には、単なる流行ではなく明確な技術的合理性があります。

特にコンピューターサイエンスの観点から見ると、Pythonは「学習コストの低さ」と「実務適用の高さ」を同時に満たす希少な言語です。

このバランスが、研究者からエンジニア、ビジネスアナリストまで幅広い層に支持される理由になっています。

まず重要なのは、Pythonの文法が非常にシンプルである点です。

C++やJavaのように厳密な型宣言や冗長な記述を必要としないため、アルゴリズムやデータ処理の本質に集中できます。

これは特にデータサイエンスにおいて重要で、複雑な数学モデルや統計処理を素早く検証する際に大きなアドバンテージとなります。

また、Pythonは「書いたコードがそのまま実行される」動的型付け言語であるため、試行錯誤のサイクルが非常に短いという特徴があります。

データ分析では仮説検証の繰り返しが基本となるため、この特性は実務効率に直結します。

さらに、Pythonが標準言語としての地位を確立した最大の要因は、エコシステムの成熟度にあります。

特に以下のような要素が揃っている点は他言語と比較しても圧倒的です。

- 数値計算のNumPy

- データ操作のpandas

- 機械学習のscikit-learn

- 深層学習のTensorFlowやPyTorch

これらが統一されたインターフェース思想のもとで利用できるため、異なる目的の処理でもコードの一貫性を保つことができます。

次に、Pythonが研究領域と産業領域の橋渡しをしている点も重要です。

もともと統計解析や機械学習の多くはRやMATLABなど特定用途の言語で発展してきましたが、Pythonは汎用性の高さによってそれらを統合する役割を果たしました。

以下は代表的な言語の特徴比較です。

| 言語 | 特徴 | データサイエンス適性 |

|---|---|---|

| Python | 汎用性・ライブラリ豊富 | 非常に高い |

| R | 統計特化 | 高いが限定的 |

| Java | 安定性・企業向け | 中程度 |

このようにPythonは、専門性と汎用性のバランスにおいて最も実務に適した位置にあります。

また、クラウド環境やJupyter Notebookの普及もPythonの地位を押し上げました。

コードと結果を同時に記述・可視化できる環境は、データ分析の説明性を大幅に向上させています。

これはビジネス現場での意思決定速度にも直結します。

総合的に見ると、Pythonがデータサイエンスの標準言語になった理由は単一の要素ではなく、以下の複合的要因によるものです。

- 学習コストの低さ

- ライブラリの圧倒的な豊富さ

- 研究と実務の統合性

- クラウド・ノートブック環境との親和性

これらが相互に作用し、現在の地位を形成しています。

結果としてPythonは単なるプログラミング言語ではなく、データサイエンスのための「基盤技術」として扱われるようになっています。

NumPyとpandasが支えるデータ分析基盤の実力

データサイエンスにおいてPythonが強力な地位を確立している理由の一つは、低レイヤーの数値計算から高レベルのデータ操作までを統一的に扱えるエコシステムの存在です。

その中核を担っているのがNumPyとpandasであり、この2つのライブラリは実務におけるデータ分析基盤そのものと言えます。

特にコンピューターサイエンスの観点では、これらは単なる便利ツールではなく、効率的な計算モデルを抽象化した重要なレイヤーです。

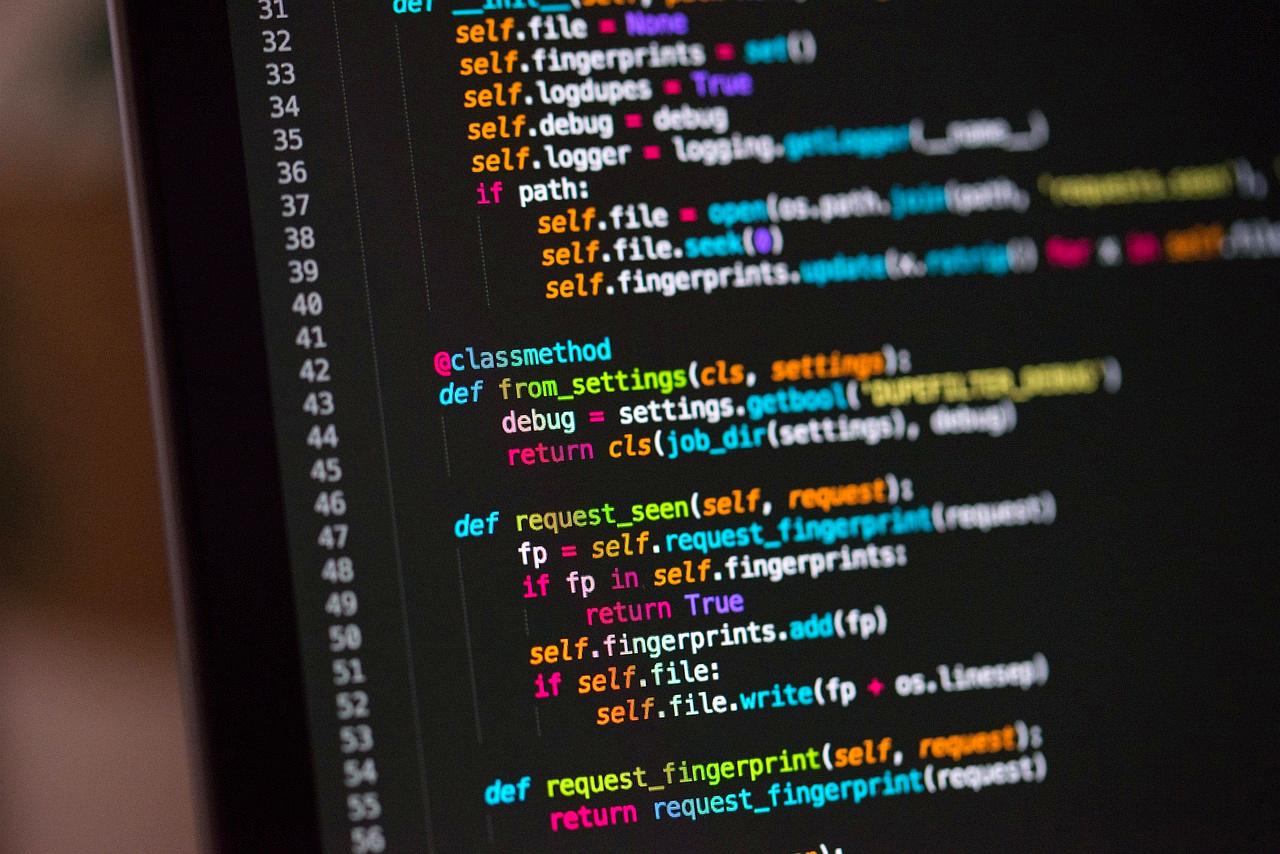

配列計算を高速化するNumPyの役割

NumPyはPythonにおける数値計算の基盤であり、多次元配列(ndarray)を効率的に扱うために設計されています。

Python標準のリストでは要素ごとの処理にオーバーヘッドが発生しますが、NumPyは内部的にC言語ベースの実装を持つため、ベクトル化された演算が可能です。

この設計により、ループ処理を明示的に書かずとも高速な計算が実現されます。

例えば単純な加算処理でも違いは明確です。

import numpy as np

a = np.array([1, 2, 3])

b = np.array([4, 5, 6])

result = a + b

このように演算子オーバーロードを活用することで、直感的なコードと高い実行性能を両立しています。

また、行列演算や線形代数処理も標準でサポートされており、機械学習アルゴリズムの多くがNumPyを前提として構築されています。

さらにNumPyの設計思想は「メモリ効率」と「計算の一括処理」にあります。

これはCPUキャッシュの利用効率を最大化する方向に最適化されており、データサイエンスのような大量データ処理において重要な役割を果たします。

データフレーム操作を可能にするpandasの強み

pandasはNumPyを基盤としながら、より高レベルなデータ構造であるDataFrameを提供します。

これは表形式データを直感的に扱うための抽象化であり、SQLやスプレッドシートに近い操作性を持ちながら、プログラム的な柔軟性を維持しています。

特に現実のデータは欠損値や型の不一致を含むことが多いため、pandasのデータ整形能力は実務上非常に重要です。

以下のような操作が容易に行えます。

import pandas as pd

df = pd.DataFrame({

"name": ["A", "B", "C"],

"value": [10, 20, 30]

})

filtered = df[df["value"] > 15]

このように条件抽出や集計処理が直感的に記述できるため、分析プロセスの可読性が大きく向上します。

またpandasは時系列データ処理にも強く、金融データやセンサーデータなどの解析にも適しています。

内部的にはNumPy配列を利用しつつも、ラベル付きインデックスを導入することで、単なる数値配列以上の意味構造を持たせています。

NumPyとpandasを組み合わせることで、低レベルな高速計算と高レベルなデータ操作がシームレスに統合され、Pythonは実務的なデータ分析環境として完成度の高い体系を形成しています。

機械学習ライブラリscikit-learnが実務で選ばれる理由

機械学習の実務導入においてscikit-learnが高い採用率を維持している理由は、単なる使いやすさにとどまりません。

設計思想そのものが「再現性」「一貫性」「拡張性」を重視しており、データサイエンスのワークフローに非常に適合している点が重要です。

特にコンピューターサイエンスの観点から見ると、scikit-learnはアルゴリズムの抽象化と統一インターフェース設計の成功例といえます。

機械学習の現場では、データ前処理からモデル構築、評価、チューニングまで多段階の工程が存在します。

この各ステップを別々のツールで扱うと複雑性が増大しますが、scikit-learnはそれらを一貫したAPI設計で統合しています。

その結果、学習コストを抑えながらプロトタイピング速度を大幅に向上させることが可能です。

特に重要なのは、Estimatorという統一インターフェースの存在です。

この設計により、異なるアルゴリズムであっても同じ操作体系で扱うことができます。

from sklearn.linear_model import LogisticRegression

from sklearn.ensemble import RandomForestClassifier

model = LogisticRegression()

model.fit(X_train, y_train)

pred = model.predict(X_test)

このようにfitとpredictという共通メソッドにより、モデルの種類に依存しないコード設計が可能になります。

これはソフトウェア工学的にも非常に重要であり、保守性の高いシステム構築につながります。

またscikit-learnはアルゴリズムの実装だけでなく、データ分割やクロスバリデーション、評価指標といった周辺機能も標準で提供しています。

これにより機械学習の実験環境を一つのライブラリ内で完結させることができます。

以下は代表的な機能の整理です。

| 機能領域 | 内容 | 実務での役割 |

|---|---|---|

| 前処理 | 標準化・欠損値処理 | データ品質の均一化 |

| モデル | 分類・回帰・クラスタリング | 予測アルゴリズム実装 |

| 評価 | 精度・再現率・F1スコア | モデル性能の検証 |

さらにscikit-learnの設計はNumPyおよびpandasとの親和性を前提としており、データ形式の変換コストが非常に低い点も実務的な利点です。

この統合性は、実験から本番環境への移行をスムーズにする要因になっています。

もう一つ重要な点として、scikit-learnは過度に複雑な抽象化を避けている点が挙げられます。

深層学習フレームワークのようにブラックボックス化が進んでいないため、アルゴリズムの挙動を理解しながら利用できる設計になっています。

これは特に教育用途やプロトタイピング段階で大きな利点となります。

結果としてscikit-learnは、以下のような条件を満たす稀有なライブラリとなっています。

- 一貫したAPI設計による学習コストの低減

- 豊富なアルゴリズムと評価機能の標準搭載

- NumPy・pandasとの高い統合性

- 実務と研究の両方に対応できる透明性

このような特徴により、scikit-learnは単なる機械学習ライブラリではなく、Pythonにおける実務的AI開発の標準基盤として広く利用されています。

MatplotlibとSeabornによるデータ可視化の重要性

データサイエンスにおいて、数値そのものの解析と同等に重要なのがデータ可視化です。

人間の認知能力は抽象的な数値列よりも視覚情報の方が圧倒的に理解しやすいため、適切な可視化は分析結果の解釈精度を大きく左右します。

その中心的な役割を担うのがPythonのMatplotlibとSeabornです。

これらは単なる描画ライブラリではなく、データの構造や分布、相関関係を直感的に把握するための分析ツールとして機能します。

特に機械学習の前処理やモデル評価の段階では、可視化による洞察がアルゴリズム選択の精度に直結します。

MatplotlibはPythonにおける最も基礎的な可視化ライブラリであり、低レベルな描画制御が可能です。

一方でSeabornはMatplotlibを基盤にしながら統計的可視化を簡略化した上位レイヤーとして設計されています。

この役割分担が、実務における柔軟性と生産性の両立を実現しています。

例えばMatplotlibでは細かな制御が可能です。

import matplotlib.pyplot as plt

x = [1, 2, 3, 4]

y = [10, 15, 13, 17]

plt.plot(x, y)

plt.title("Simple Line Plot")

plt.show()

このように細部まで制御できる一方で、複雑な統計的可視化ではコード量が増加しやすいという特徴があります。

そこでSeabornが重要になります。

Seabornは統計データの可視化に特化しており、DataFrameとの親和性が高い設計になっています。

これにより、分布や相関の可視化を短いコードで実現できます。

import seaborn as sns

import pandas as pd

df = pd.DataFrame({

"x": [1, 2, 3, 4],

"y": [10, 15, 13, 17]

})

sns.scatterplot(data=df, x="x", y="y")

このようにSeabornは、統計的意味を持つグラフを簡潔に生成できる点が特徴です。

両者の違いを整理すると以下のようになります。

| ライブラリ | 特徴 | 適用場面 | 抽象レベル |

|---|---|---|---|

| Matplotlib | 低レベル描画制御 | カスタム可視化 | 低 |

| Seaborn | 統計可視化特化 | データ分析全般 | 中 |

この構造により、開発者は目的に応じて適切な抽象度を選択できます。

特にデータサイエンスでは「探索的データ解析(EDA)」の段階でSeabornが頻繁に使用され、その後の詳細なレポーティングや可視化調整でMatplotlibが利用されるという分業が一般的です。

さらに重要なのは、可視化が単なる結果表示ではなく、仮説生成のプロセスそのものになっている点です。

例えばデータの分布をヒストグラムで確認することで外れ値の存在に気付き、次の分析方針を修正するという流れは実務で頻繁に発生します。

このようにMatplotlibとSeabornは、単なる描画ツールではなくデータ理解のための認知拡張ツールとして機能しています。

Pythonがデータサイエンスにおいて強力である理由の一つは、こうした可視化エコシステムが標準で整備されている点にあります。

Google ColabとJupyterが変えるクラウド型データ分析環境

データサイエンスの実務環境は、ここ数年で大きく変化しています。

その中心にあるのが、Jupyter NotebookとGoogle Colabに代表されるクラウド型実行環境です。

従来はローカル環境にPythonや各種ライブラリを構築する必要がありましたが、現在ではブラウザさえあれば即座に分析環境を構築できるようになっています。

この変化は単なる利便性の向上ではなく、開発プロセスそのものを再定義しています。

特にJupyter Notebookは、コード・実行結果・ドキュメントを一体化したインタラクティブな実行環境として設計されています。

この構造により、データ分析の「試行錯誤」と「記録」が同時に行えるため、再現性の高い研究や実務レポートの作成が容易になります。

一方でGoogle Colabは、このJupyterの思想をクラウドへ拡張したサービスです。

ローカル環境構築を不要にし、GPUやTPUといった計算リソースを手軽に利用できる点が大きな特徴です。

これは特に機械学習や深層学習の分野において大きな意味を持ちます。

まずJupyter Notebookの本質的な価値は、コード実行の透明性にあります。

セル単位で処理が実行されるため、各ステップの結果を即座に確認できます。

これにより、データ前処理からモデル構築までの各段階を可視化しながら進めることが可能です。

import pandas as pd

df = pd.read_csv("data.csv")

df.head()

このように結果が即座に表示されることで、データの構造把握が迅速に行えます。

Google Colabはこの仕組みをクラウド化し、さらに共有性を強化しています。

特にチーム開発や教育用途において、環境構築の差異によるトラブルを排除できる点は非常に重要です。

環境差異は再現性を損なう主要因の一つであり、それをクラウド側で統一できることは実務上大きな利点です。

両者の特徴を整理すると以下のようになります。

| 環境 | 特徴 | 主な用途 | 計算資源 |

|---|---|---|---|

| Jupyter Notebook | ローカル中心・柔軟性高い | 研究・開発 | ローカルPC |

| Google Colab | クラウド・共有性高い | 学習・機械学習実験 | クラウドGPU/TPU |

またGoogle Colabの大きな利点は、Pythonライブラリのインストールや環境構築がほぼ不要である点です。

必要なライブラリはセル単位でインストールできるため、実験の開始までの時間が極めて短くなります。

!pip install scikit-learn

このような簡易的なコマンドで環境を拡張できる点は、従来のローカル開発環境と比較して圧倒的に効率的です。

さらにクラウド環境のもう一つの重要な価値は「共有性」です。

Notebookファイルはリンク一つで共有可能であり、同じコードと実行結果を複数人で確認できます。

これはデータサイエンスにおけるレビュー文化や教育プロセスを大きく変えています。

結果として、JupyterとGoogle Colabは単なる実行環境ではなく、以下のような役割を担っています。

- 再現性の高い分析環境

- 迅速なプロトタイピング基盤

- 教育・研究の共有プラットフォーム

- クラウドGPUによる計算資源の民主化

このようにクラウド型データ分析環境は、Pythonエコシステムと強く結びつきながら、データサイエンスの開発スタイルそのものを根本から変革しています。

AI・機械学習時代におけるPythonの圧倒的優位性

AIおよび機械学習が実務レベルで広く普及した現在、Pythonはその中心的な開発言語として確固たる地位を築いています。

この優位性は単なる人気や歴史的経緯によるものではなく、言語設計とエコシステムの両面から論理的に説明できるものです。

特にコンピューターサイエンスの観点では、Pythonは「研究から実装への距離が最も短い言語」として評価されています。

まず前提として、AIや機械学習の開発には大量の数値計算、統計処理、最適化アルゴリズムの実装が必要になります。

これらの処理は低レベルではCやC++で記述されることもありますが、開発効率や実験速度の観点から直接扱うのは非効率です。

そのため、高水準言語としてのPythonが中間層として機能し、内部的には高速なネイティブ実装を呼び出す構造が一般的になっています。

この構造を支えているのが、NumPyやPyTorch、TensorFlowといったライブラリ群です。

これらは内部的に最適化されたC/C++コードを持ちつつ、Pythonインターフェースを提供することで高い抽象性と性能を両立しています。

特に機械学習フレームワークの多くがPython APIを第一級インターフェースとして採用している点は重要です。

これにより、研究者やエンジニアは複雑な内部実装を意識することなくモデル構築に集中できます。

import torch

import torch.nn as nn

model = nn.Linear(10, 1)

x = torch.randn(5, 10)

output = model(x)

このように数行のコードでニューラルネットワークを構築できる点は、従来のプログラミングパラダイムと比較して圧倒的に抽象度が高いと言えます。

また、Pythonの優位性はライブラリの多さだけではなく、その統合的なエコシステム設計にもあります。

データ前処理からモデル構築、評価、デプロイまでを同一言語で完結できる点は、開発フローの分断を防ぎます。

以下はAI開発における主要領域とPythonエコシステムの対応関係です。

| 領域 | 主なライブラリ | 役割 |

|---|---|---|

| データ処理 | pandas, NumPy | 前処理・変換 |

| 機械学習 | scikit-learn | 伝統的モデル構築 |

| 深層学習 | PyTorch, TensorFlow | ニューラルネット構築 |

| 可視化 | Matplotlib, Seaborn | 結果分析 |

このように各層が有機的に連携しているため、学習コストを抑えながら高度なシステム開発が可能になります。

さらに重要なのは、Pythonが研究コミュニティと産業界の両方で標準化されている点です。

新しい論文で提案されたアルゴリズムの多くは、まずPython実装として公開される傾向があります。

これにより、最新技術へのアクセス速度が他言語よりも圧倒的に速くなっています。

また、AI分野では実験の再現性が重要ですが、PythonはJupyter NotebookやColabと組み合わせることで実験ログとコードを一体化できます。

これは研究からプロダクションへの移行をスムーズにする要因でもあります。

総合的に見ると、Pythonの優位性は以下の要素に集約されます。

- 高水準な抽象化による開発効率の向上

- 強力なライブラリ群による機能統合

- 研究と実務の統一的な言語基盤

- クラウド・Notebook環境との高い親和性

これらが相互に作用することで、PythonはAI・機械学習時代において単なるプログラミング言語ではなく、標準的な開発プラットフォームとして機能しています。

JavaScriptなど他言語と比較してわかるPythonの強み

プログラミング言語の選定において重要なのは、単なる人気や流行ではなく、解決したい問題領域との適合性です。

データサイエンスや機械学習の文脈においてPythonが優位性を持つ理由は、JavaScriptやJavaなどの他言語と比較することでより明確になります。

特にコンピューターサイエンスの観点では、言語設計思想とエコシステムの成熟度が大きく影響します。

まずJavaScriptは本来フロントエンド開発を主目的として設計されており、ブラウザ上での動的UI制御に最適化されています。

そのため非同期処理やイベント駆動型の設計には強みがありますが、数値計算や科学技術計算の領域では標準ライブラリの充実度に課題があります。

一方でPythonは初期から汎用計算および科学技術計算を意識した設計がされており、データ処理を中心とした用途に自然に適合しています。

例えば同じデータ処理でも、PythonとJavaScriptではアプローチが異なります。

# Python(pandas)

import pandas as pd

df = pd.DataFrame({"a": [1, 2, 3]})

print(df.mean())

// JavaScript(基本配列操作)

const arr = [1, 2, 3];

const mean = arr.reduce((a, b) => a + b, 0) / arr.length;

console.log(mean);

このように、Pythonでは統計的操作が自然に表現できる一方で、JavaScriptでは低レベルな実装に近くなり、データ分析という観点では抽象度が不足する場面が多くなります。

またJavaとの比較も重要です。

Javaはエンタープライズシステムにおける堅牢性とスケーラビリティに優れていますが、その代償としてコード量が多くなり、試行錯誤の速度が低下します。

データサイエンスのように仮説検証を高速に繰り返す領域では、このオーバーヘッドは大きな制約となります。

| 言語 | 得意領域 | データサイエンス適性 | 開発速度 |

|---|---|---|---|

| Python | AI・データ分析 | 非常に高い | 高速 |

| JavaScript | Webフロントエンド | 中程度 | 中速 |

| Java | 大規模システム | 低〜中 | 低速 |

さらに重要なのは、Pythonが持つライブラリ中心の設計思想です。

他言語では機能ごとに個別の実装が必要になる場合でも、Pythonでは統一されたエコシステム内で処理が完結します。

これによりコードの再利用性と可読性が大幅に向上します。

また、機械学習や統計解析の多くの最新実装はPythonを中心に公開される傾向があります。

これは研究コミュニティがPythonを事実上の標準言語として採用しているためであり、結果として技術の移行速度にも差が生まれます。

さらに、開発体験の観点でもPythonは優れています。

インタラクティブ実行環境であるJupyterやColabと組み合わせることで、コード実行と結果確認を即座に繰り返すことが可能です。

この点はJavaScriptのNode.js環境やJavaのコンパイル型開発と比較しても、試行錯誤の効率において明確な差があります。

総合的に見ると、Pythonの強みは単一の技術要素ではなく、以下の複合的な構造にあります。

- データサイエンス向けに最適化されたライブラリ群

- 高い抽象度による短い開発サイクル

- 研究と実務を統一する言語基盤

- インタラクティブな開発環境との親和性

これらの要素が組み合わさることで、Pythonは他言語と比較してデータサイエンス領域において圧倒的に合理的な選択肢となっています。

データサイエンス現場でのPython活用事例と実務フロー

データサイエンスの現場においてPythonがどのように活用されているかを理解するためには、単なるライブラリの知識だけでは不十分です。

実務では「データ取得から意思決定までの一連の流れ」をどれだけ効率的に設計できるかが重要であり、Pythonはその全工程を一貫して支える言語として機能しています。

まず現場の基本的なフローは、データ収集、前処理、探索的データ分析、モデル構築、評価、そして運用という段階に分かれます。

Pythonはこれらすべての工程に対応するライブラリが揃っているため、ツールを切り替える必要がほとんどありません。

この一貫性が実務効率を大きく向上させています。

例えばデータ収集の段階では、API経由で外部データを取得するケースが一般的です。

requestsライブラリを用いることで簡潔にデータ取得処理を記述できます。

import requests

response = requests.get("https://api.example.com/data")

data = response.json()

取得したデータはそのままでは分析に適さないため、次に前処理が必要になります。

この段階ではpandasが中心的な役割を果たします。

欠損値処理やデータ型変換など、現実データ特有の問題に対処します。

import pandas as pd

df = pd.DataFrame(data)

df = df.dropna()

df["value"] = df["value"].astype(float)

このような前処理を経て、ようやくデータは分析可能な状態になります。

次に探索的データ分析(EDA)の段階では、MatplotlibやSeabornを用いてデータの傾向を可視化します。

この工程は単なるグラフ作成ではなく、仮説構築のための重要なステップです。

例えば異常値の検出や変数間の相関関係の把握などがここで行われます。

その後、機械学習モデルの構築に移行します。

この段階ではscikit-learnが標準的に使用されます。

モデル選択から学習、評価まで一貫したAPIで実行できるため、実務の複雑性を大幅に削減できます。

| 工程 | 使用ライブラリ | 主な目的 |

|---|---|---|

| データ収集 | requests | 外部データ取得 |

| 前処理 | pandas | データ整形 |

| 可視化 | matplotlib / seaborn | 傾向分析 |

| モデル構築 | scikit-learn | 予測モデル生成 |

さらに実務では、単にモデルを作成するだけではなく、その結果をビジネス上の意思決定に接続する必要があります。

このため、結果の可視化やレポーティングもPython内で完結することが重要です。

また近年では、Jupyter NotebookやGoogle Colabを用いた分析共有が一般的になっています。

これにより、分析結果をコードとともにそのまま共有できるため、レビューや再現性の確保が容易になっています。

特にチーム開発環境では、この透明性が非常に重要です。

さらに実務フローの中で見落とされがちですが、モデルの改善サイクルもPythonによって高速化されています。

仮説設定、検証、再学習のループが短い時間で回ることにより、分析精度の向上速度が大きく変わります。

総合的に見ると、Pythonは単なるプログラミング言語ではなく、データサイエンスの業務プロセス全体を支える統合プラットフォームとして機能しています。

この統合性こそが、現場でPythonが選ばれ続ける最大の理由です。

まとめ:ライブラリの豊富さがPythonをデータサイエンスの中心にした

データサイエンスの発展を俯瞰すると、Pythonが中心的な役割を担うようになった理由は非常に明確です。

それは言語そのものの設計思想と、それを取り巻くライブラリ群の成熟度が相互に強化し合った結果であり、単なる人気投票のような現象ではありません。

コンピューターサイエンスの観点から見ると、Pythonは「抽象化レイヤーの設計が最も実務に適応した汎用言語」として位置づけられます。

特に重要なのは、Pythonが単体で完結しているのではなく、巨大なエコシステムによって価値を拡張している点です。

NumPyによる数値計算の高速化、pandasによるデータ操作の抽象化、scikit-learnによる機械学習の標準化、さらにTensorFlowやPyTorchによる深層学習の実装基盤など、各領域が独立しながらも統一されたインターフェース思想で結びついています。

この構造が、学習コストを抑えながら高度な分析を可能にしています。

またPythonの強みは、単にライブラリが多いことではなく、それらが相互運用可能な設計になっている点にあります。

異なる目的のライブラリが同一のデータ構造(特にNumPy配列やpandas DataFrame)を中心に設計されているため、データの変換コストが極めて低く抑えられています。

この点は他の言語と比較しても大きな優位性です。

例えばデータサイエンスの基本的な流れは、以下のようにPython内で完結します。

import pandas as pd

from sklearn.linear_model import LinearRegression

df = pd.read_csv("data.csv")

X = df[["feature"]]

y = df["target"]

model = LinearRegression()

model.fit(X, y)

このようにデータ取得からモデル構築までが一つの言語でシームレスに実行できることは、開発効率の観点で極めて重要です。

さらにPythonは研究と実務の境界を曖昧にする役割も果たしています。

最新の論文で提案されたアルゴリズムの多くがPython実装として公開されるため、研究成果をそのままプロダクション環境に近い形で再現できる点も強みです。

これにより技術移転の速度が加速し、ビジネスへの応用までの時間が短縮されています。

以下はPythonがデータサイエンスの中心となった要因を整理したものです。

| 要因 | 内容 | 影響 |

|---|---|---|

| ライブラリの豊富さ | 数値計算・機械学習・可視化の統合 | 開発効率向上 |

| 統一データ構造 | NumPy・DataFrame中心設計 | 互換性向上 |

| エコシステム成熟 | OSSコミュニティの活発さ | 技術進化の加速 |

| クラウド連携 | Colab・Jupyter対応 | 再現性向上 |

このような要素が相互に作用することで、Pythonは単なるプログラミング言語ではなく、データサイエンスのための統合的な基盤として成立しています。

最終的に重要なのは、Pythonの価値が言語仕様そのものではなく、周辺エコシステムとの相互作用によって生まれているという点です。

ライブラリの豊富さは結果であり、その背後にはコミュニティ主導の開発文化と、実務ニーズに適応し続ける柔軟な設計思想があります。

この構造こそが、Pythonをデータサイエンスの中心に押し上げた本質的な理由です。

コメント